تطبيقات الذكاء الاصطناعي تخرج عن السيطرة “الديمقراطية”

لا بدّ لنا من بذل المزيد من الاهتمام وتوفير القوة العاملة والتمويل، لإنشاء نظم حوكمة للذكاء الاصطناعي مماثلة لتلك المستخدمة في صناعات الطيران والأدوية والأغذية.

في 29 مارس، تم نشر رسالة مفتوحة تطالب بـ “تعليق تجارب الذكاء الاصطناعي الضخمة”، وقّع عليها حتى الآن حوالي 3000 شخص من الأكاديميين والروّاد التقنيين. هذا النداء الذي جاء متأخّراً كان ينبغي أن يحصل منذ فترة طويلة.

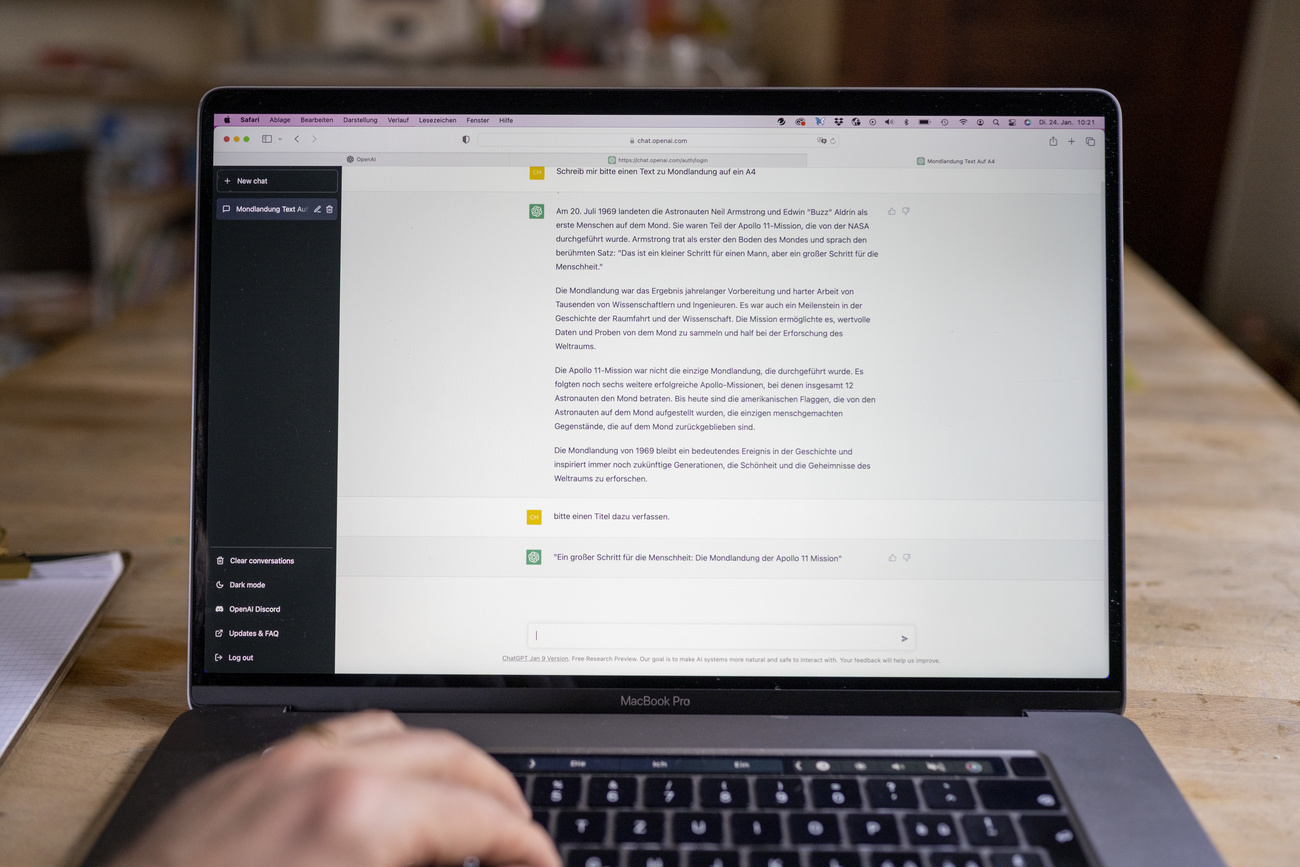

خلال العقد الماضي، تم تطوير خوارزميات مثيرة للإعجاب، مثل “تشات جي بي تي” و “ميد جورني”، بشكل سريع وتم نشرها على نطاق واسع. كما انتشر استخدام العديد من تطبيقات الذكاء الاصطناعي المماثلة بشكل كبير، لا سيّما تلك المتعلّقة بالكشف عن عمليات الغش والاحتيال أو تلك التي تعمل على غربلة وتصفية السير الذاتية، أو المتعلقة بأشرطة كاميرات المراقبة وبآليات خدمة العملاء (غالباً على الرغم من أوجه القصور والتحيز المعروفة لهذه التطبيقات). ولكن يمكن القول إن استخدامها الرئيسي كان في مجال التسويق؛ فالعديد من عمالقة شركات التكنولوجيا الحديثة مثل “غوغل” و “تيك توك” و”ميتا” تحقق معظم أرباحها من خلال استهداف الإعلانات، أو مثل شركة كوكا كولا التي كانت أول عميل لـ”تشات جي بي تي” ChatGPT. هذه الأمور كلها ينبغي أن تكون بمثابة علامة تنبيه وتحذير.

وبالإضافة إلى ذلك، فقد تبيّن أن الخوارزميات المتعلّقة بهذه التطبيقات يمكنها أن تنشر الأخبار المضللة، وتوصي بالأدوية الزائفة، وتعرّض الصحة النفسية للخطررابط خارجي، كما يتم استخدامها أيضاً لتنسيق الأسواق غير القانونية (حتى تجارة الرقيق).رابط خارجي وهي أيضاً تؤدي إلى المزيد من الكراهية، وتساعد على تقويض الديمقراطيات، بل وتتسبب في الإبادة الجماعيةرابط خارجي، حسب تأكيد الأمم المتحدة ومنظمة العفو الدولية. لقد صار معلوماً أن هذه الخوارزميات باتت تشكل تهديداً للأمن القومي.

وناهيك عن أن تطويرها يتم بطريقة مبهمة جداً وغير شفافة؛ فمن الصعب على أي جهة خارجية الاطلاع على خوارزميات “غوغل” أو “ميتا” أو “أوبن أي” OpenAI، حتى وصل الأمر إلى إزالة القوى العاملة الداخلية المعارضة: فقد أقالت “غوغل” فريق الأخلاقيات الخاص بها، وفككت “ميتا” فريق الابتكار المسؤول، وأقالت “ميكروسوفت” فريقاً أخلاقياً بعد أن دقّ أعضاؤه ناقوس الخطر حول عملية نشر غير أخلاقي وغير آمن ومتسرع لهذه الخوارزميات. ونجحت الشركات الربحية القوية في صياغة دولتها العالمية حيث يمكنها تصميم خوارزمياتها مع عدم وجود أية مساءلة تُذكر.

المزيد

الحكومات والشركات لن تتوقف عن سباق الذكاء الاصطناعي

الحاجة ماسّة لحوكمة فعالة للذكاء الاصطناعي

تُعتبر صناعة البرمجيات بعيدة كل البعد عن أن تكون أول صناعة خارجة عن السيطرة؛ فلعقود من الزمن، تسببت صناعات مثل الطيران والسيارات والصيدلة والغذاء والتبغ والإنشاءات والطاقة، بين العديد من الصناعات الأخرى، في تسويق منتجات غير مراقبة. وقد كلّفت هذه الممارسات ملايين الأرواح. وفي نهاية المطاف، بدأت المجتمعات العامة تقف بوجه هذا العجز المرعب في المساءلة. واليوم، أضحت الأنظمة الديمقراطية، من خلال القوانين الصارمة والجهات الرقابية القوية والمموّلة بشكل جيد تفرض سيطرتها الديمقراطية على هذه الأسواق. ومن الواضح أن صناعة البرمجيات بحاجة إلى الخضوع إلى رقابة مماثلة.

نحن بحاجة للتحرّك سريعاً، من أجل التوصّل إلى تقنيات آمنة وأخلاقية، بدلاً من المطالبة بأن تنخرط بلداننا في قيادة هذا السباق الجذّاب في مجال الذكاء الاصطناعي. وعلى وجه التحديد، ينبغي ألا يكون انبهارنا بالخوارزميات التي تشغل شبكاتنا الذكية وسياراتنا وطائراتنا ومحطات الطاقة والبنوك ومراكز البيانات وشبكات التواصل الاجتماعي والهواتف الذكية أقل بكثير من اهتمامنا بأمنها السيبراني. ولقد سبق وأن حذرنا أنا وزميلي في كتاب صدر عام 2019رابط خارجي، حيث قلنا إنه إذا كانت هذه الخوارزميات هشة أو ضعيفة أمام الاختراق أو مفتوحة للاستغلال أو تم تفويض العمل بها لمزوّد غير موثوق به، أو إذا انتٌهكت حقوق الإنسان – والتي هي الحالة المألوفةرابط خارجي – فسنكون جميعاً في خطر كبير.

ومع ذلك، فإن صناعة البرمجيات والأوساط الأكاديمية، بالإضافة إلى الحوافز القانونية والاقتصادية الحالية، هي التي تعوق بشكل أساسي التفكير في إيجاد الحلول لمشكلة الأمن السيبراني. وفي كثير من الأحيان، نرى أن الشركات الأكثر نجاحاً، والباحثين الأكثر شهرةً والأكثر حفاوةً والأكثر تمويلاً، الذين يحصلون على أفضل وظائف البرمجيات دخلاً، هم أولئك الذين لا يعيرون اهتماماً للأمن السيبراني ولا للقيَم الأخلاقية. وكما يعتقد عدد متزايد من الخبراء، لا بد من التحرّك سريعاً من أجل تغيير هذا الواقع.

ربما لن يكون بمقدور أنظمتنا الديمقراطية تحمل العقود التي تطلّبتها عمليات إنشاء القوانين والجهات التفتيشية في صناعات أخرى. ونظراً للسرعة التي يتم بها تطوير الخوارزميات الأكثر حداثة ونشرها، لدينا فترة زمنية صغيرة جداً للقيام بما يجب علينا القيام به. والرسالة المفتوحة التي وقعناها أنا والعديد من الباحثين في مجال الذكاء الاصطناعي تهدف إلى إعطائنا فسحة من الزمن نلتقط فيها أنفاسنا، لنتمكن من إيجاد الحلول في هذا المضمار.

ما الذي يُمكننا أنتم ومنظماتكم ومؤسساتنا فعله

إنّ إنشاء آليات الرقابة الديمقراطية على خوارزميات التطبيقات الحرجة في الوقت الحاضر هو بدون شك مسعى ملحّ ورائع، ويتطلب جهوداً هائلة، ولكن تحقيقه لن يتم في الوقت المناسب بدون مشاركة عدد كبير من المعنيين من ذوي المواهب والخبرات والمسؤوليات المتنوعة.

التحدي الأول يكمن في تحفيز الاهتمام بمسألة الأمن السيبراني. ينبغي علينا جميعاً الاستثمار حالاً في بذل المزيد من الوقت والطاقة والتمويل للتأكد من أن زملاءنا ومؤسساتنا يولون مزيداً من الاهتمام لهذه المسألة. كما ينبغي العمل على عدم السماح بدعوة موظفي التكنولوجيا الكبيرة والاحتفاء بهم، وخاصة في الجامعات ووسائل الإعلام، دون التطرّق إلى مسألة الأمن السيبراني والقيم الأخلاقية التي ترعى المنتجات التي تموّل نشاطهم. وبصورة أعمّ، خلال كل المناقشات المتعلقة بالتكنولوجيا، ينبغي طرح السؤال التالي : “ما هي المشكلات التي يمكن أن تنشأ؟”.

التحدي الثاني هو تحدّي مؤسساتي. ففي الوقت الذي تبرز فيه الحاجة إلى سنّ قوانين جديدة، فإن احتمال قيام الخوارزميات المستخدمة اليوم على نطاق واسع بانتهاك القوانين الحالية هو احتمال وارد، كالربح مثلاً من الإعلانات الاحتيالية رابط خارجي. ولكن الانعدام الحالي الكامل للرقابة الخارجية يقف عائقاً أمام تحقيق العدالة. لذا ينبغي علينا المطالبة بإنشاء هيئات تنظيمية مموّلة بطريقة كافية بحيث تكون قادرة على إنفاذ القانون على شبكة الإنترنت.

وقد لعبت سويسرا دوراً رياديّاً في وضع المعايير الديمقراطية في شتّى المجالات. وهذه المسألة هي بمثابة فرصة لها للاستمرار في هذا التقليد النبيل. أضف إلى ذلك أن المعنيين بالمنطقة المحيطة ببحيرة جنيف قد قاموا مؤخّراً ببذل جهود ترمي إلى تحويل هذه المنطقة إلى مركز متميّز في مجال الثقة الرقمية والأمن السيبراني بإنشاء منصة “تراست فالي”Trust Valleyرابط خارجي . ومن المرجح أن يكون تحفيز قدرات المنظمات الرقابية والأمنية، مفتاحاً للتميز على هذا الصعيد، في جميع أنحاء العالم.

أما التحدي الثالث، فيتمثل في تصميم بدائل آمنة تتمتع بالحوكمة الديمقراطية للخوارزميات الأكثر تأثيراً في الوقت الحالي. هذا ما قضيت معظم وقتي خلال الخمس سنوات الماضية في العمل عليه، حيث أسست مع زملائي في العمل مشروع جمعية “تورنسولرابط خارجي” غير الربحية. ويعمل هذا المشروع البحثي على إيجاد بدائل للخوارزميات من خلال تصويت آمن وعادل يقوم به المساهمون في جمعية “تورنسول” لاختيار السلوك المفضل الذي ينبغي للخوارزمية انتهاجه. وترحب الجمعية بانضمام أي شخص إليها.

وكلما ركزنا جميعاً بشكل أسرع على أمان بيئات المعلومات لدينا، كلما كانت لدينا فرصة أكبر لحماية مجتمعاتنا من الثغرات الأمنية الضخمة الحالية في مجال الأمن السيبراني.

المزيد

تقوم SWI swissinfo.ch بنشر آراء حول مواضيع مختلفة، سواء حول قضايا سويسرية أو مواضيع لها تأثير على سويسرا. يرمي اختيار المقالات إلى تقديم آراء متنوعة بهدف إثراء النقاش حول القضايا المطروحة. تعبّر الأفكار الواردة في هذه المقالات عن آراء مؤلفيها فقط ولا تعكس بالضرورة وجهات نظر SWI swissinfo.ch.

تحرير: صابرينا فايس

ترجمة: جيلان ندا

متوافق مع معايير الصحافة الموثوقة

المزيد: SWI swissinfo.ch تحصل على الاعتماد من طرف "مبادرة الثقة في الصحافة"

يمكنك العثور على نظرة عامة على المناقشات الجارية مع صحفيينا هنا . ارجو أن تنضم الينا!

إذا كنت ترغب في بدء محادثة حول موضوع أثير في هذه المقالة أو تريد الإبلاغ عن أخطاء واقعية ، راسلنا عبر البريد الإلكتروني على arabic@swissinfo.ch.