استخدام “الروبوتات المستقلة القاتلة” يُثير إشكالات قانونية

أطلقت منظمة الأمم المتحدة في جنيف نقاشا حول تطوير أسلحة قادرة على اتخاذ قرار القتل، بعيدا عن التدخل الإنساني أو ما يُعرف بـ "الروبوتات المستقلة القاتلة"، مُطالبة بالإلتزام بمهلة. أما منظمات المجتمع المدني، فتدعو إلى فرض حظر شامل عليها.

“وكأن الإنسانية لا يكفيها ما يجري من تدمير وقتل وانتهاكات، بسبب استخدام أسلحة مُعترف بها دوليا، كي تواجه تحدي تطوير أسلحة جديدة، ليست فتاكة فحسب، بل هي قادرة على اتخاذ قرار القتل بعيدا عن تدخل العنصر البشري”.

هذا هو جوهر الإشكالية التي أثارها كريستوف هاينز، المُقرّر الأممي الخاص المعني بحالات الإعدام خارج نطاق القضاء يوم الخميس 30 مايو 2013 أمام مجلس حقوق الإنسان في جنيف، لدى تطرقه لموضوع “الروبوتات المستقلة القاتلة”، المعروفة اختصارا باسم “لارس”.

وفي هذه المناسبة، طرح المقرر الجنوب إفريقي عدة تساؤلات، لا وجود لأجوبة عنها لحد الآن من بينها: ما مدى مطابقة استخدام أسلحة من هذا القبيل للقانون الإنساني الدولي الحالي؟ ومَـن يتحمل المسؤولية، أهو المصنع أم المُبرمج لنظام التشغيل أو الدولة المُستخدمة له؟ وهل سيُـشجع استخدام هذه الوسائل على الدخول بسهولة في حروب مستقبلية؟

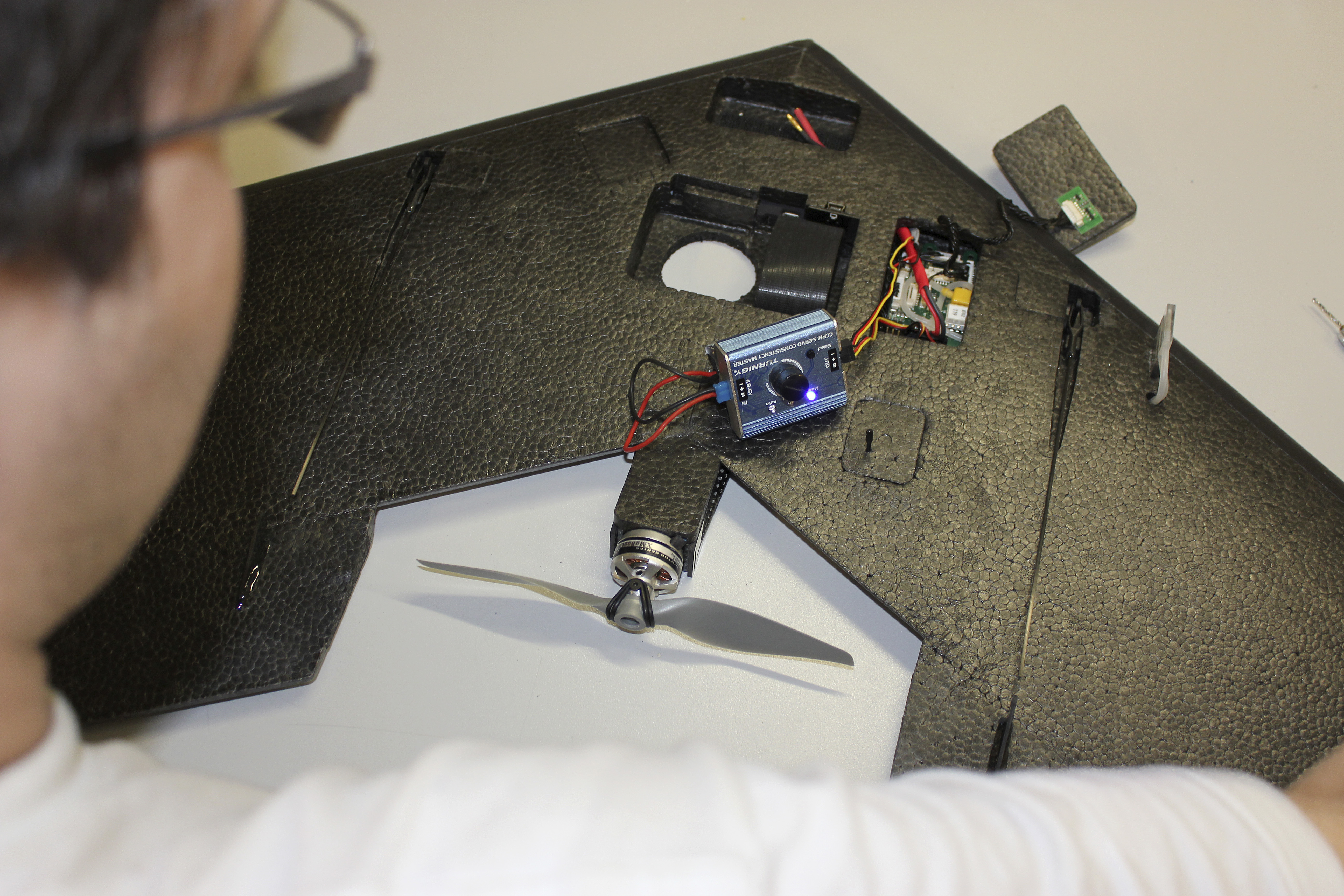

تكنولوجيا غير مستعملة حاليا، لكنها متوفرة

المقرر الخاص أوضح في مداخلته أمام مجلس حقوق الإنسان أنه “لا توجد في الوقت الحالي أي دولة تستخدم أسلحة مستقلة، يمكن تصنيفها ضمن فئة الروبوتات المستقلة القاتلة”، لكنه أورد في تقريره عددا من النماذج التي يتم تطويرها في سرية تامة، من قبل بعض الدول أو المؤسسات الحربية ومن ضمنها:

نظام فالانكس الأمريكي المستخدم في الطرادات من الفئة إيجيز والقادر على الإكتشاف التلقائي لمخاطر أسلحة الدفاع الجوي كالطائرات والقذائف المضادة للسفن وتعقبها والإشتباك القتالي معها.

النظام الأمريكي المضاد للقذائف الصاروخية وقذائف الهاون والقادر على تدميرها بصورة تلقائية.

طائرة هاري الإسرائيلية، التي تعمل وِفق مبدإ “أطلق وانس” والمخصصة لكشف بواعث الرادار ومهاجمتها وتدميرها.

النموذج الأولي لطائرة “تارانيس” القتالية الصاروخية، التي تعمل بدون طيار والقادرة على البحث بشكل مستقل عن العدو والتعرف عليه وتحديد مكانه، لكنها لا تستطيع الإشتباك معه، إلا بإذن من القيادة، وهي طائرة قادرة على الدفاع عن نفسها ضد الطائرات المعادية.

طائرة X-47B التي تُـعد نموذجا أوليا لطائرة مقاتلة بحجم طائرة بدون طيار، تقوم بصنعها شركة “نورثروب غرومان” بتكليف من البحرية الأمريكية، ولتطوير القدرة على الإقلاع والهبوط بشكل مستقل على متن حاملات الطائرات، وهي قادرة على المطاردة المستقلة.

روبوتات المراقبة والحراسة التي صنعتها شركة “سامسونغ تيكوين” والمنتشرة في المنطقة المنزوعة السلاح بين كوريا الشمالية وكوريا الجنوبية، والقادرة على اكتشاف الأهداف عبر أجهزة استشعار تعمل بالأشعة ما تحت الحمراء. ومع أنها تعمل حاليا بتوجيه بشري، إلا أنها تملك خاصية التشغيل التلقائي.

تُعرّفها الأمم المتحدة بمنظومات سلاح قادرة على أن تختار، حال تشغيلها، أهدافا معينة وتشتبك معها دون الحاجة إلى تدخل إضافي من العنصر البشري.

هي آلات ومنظومات تكنولوجية مصنوعة وفق النموذج الإدراكي القائم على الشعور والتفكير والفعل، وهي مُزودة بأجهزة استشعار تسمح لها بقدر من إدراك الظرف، وبواسطة المعالجة أو الذكاء الإصطناعي تقرير الإستجابة لحافز مُعيّن، والشروع في تنفيذ القرارات.

إذا كان استخدام المركبات الجوية الحربية بلا طيار المعروفة بـ “درونس” Drones يسمح بإبقاء العنصر البشري ضمن دائرة القرار، ولو عن بعد، فإن العنصر البشري خارج تماما عن دائرة القرار في حال استخدام الروبوتات المستقلة القاتلة.

جدل ما بين مُـناصر ومُـعارض

تطوير أسلحة جديدة على شكل روبوتات مستقلة قاتلة، أمر إيجابي في نظر البعض، حيث أنه قد يعمل وفق ما جاء في تقرير المقرر الخاص، على “الحد من عدد القتلى في المعارك” و”إنجاز مهام قتالية أكثر بعدد أقل من الجنود” والقدرة “على توسيع ساحة القتال واختراق حدود العدو بسهولة، مما يوفّر الموارد المالية والبشرية”.

وإذا كان الهاجس اليوم يتمثل في الحدّ من تعريض الجنود للأسر، فإن التقرير يتنبَّـأ بإمكانية استخدام الروبوتات لأغراض إنسانية، مثل “ظهور روبوتات مستقلة قاتلة في المستقبل، تستخدم القوة المُميتة بقدر أقل، مما قد يحدّ من وقوع وفيات لا لزوم لها”.

وهناك من يذهب إلى حدّ التكهّـن بالقدرة على تطوير منظومات قادرة على “شل حركة الهدف أو نزع سلاحه” وتطويرها بشكل “يسمح بترك أثر رقمي، مما يتيح تتبّع أفعاله على نحو أفضل، مقارنة بالجنود لتسهل عملية المساءلة”. وبما أن الأمر يتعلق بروبوتات، فمن المتوقّـع أنها لن تتصرف بشكل انفعالي أو انتقامي، على النقيض من البشر، وبالتالي، يُـنتظر أن لا تتعرض للمدنيين ولا تقوم بأعمال انتقامية، إلا إذا تمّت برمجتها لذلك.

في المقابل، يرى المعارضون لتطوير الروبوتات المستقلة القاتلة بأن هذه الآلات، إذا ما قورنت بالبشر، رغم قابليته للخطأ، تفتقر للقُـدرة على التقييم والحس السليم والنظر إلى الأمور من زاوية أوسع، وهي مزايا يجب اللجوء إليها عندما يتعلّق الأمر بقرارات لها علاقة بالحياة أو الموت.

وظل معروفا بأنه من العوامل الرادعة للدخول بسهولة في حرب، نفور الإنسان من التعرّض للقتل أو تعريض أحبابه للقتل أو قتل الغير. ويعتبر المعارضون أن هذا سيختفي بمجرد الاستعانة بالروبوتات في الحروب وسيشجع على الدخول بسهولة في حروب، كان يحسب لها ألف حساب من قبل.

ويرى المعارضون أيضا أن تخفيض التكلفة المالية والبشرية في حرب تقوم بها دولة تستخدم الروبوتات، سيُضعف من قدرة السياسيين على التأثير في القرارات بخصوص مجرى الحرب ومن ضغط الرأي العام.

ومن التساؤلات التي طرحها المقرر الخاص إلى جانب عدد من منتقدي إمكانية استخدام روبوتات قاتلة مستقلة، مدى إمكانية احترامها لمبادئ القانون الانساني الدولي والتفريق بين المدني والمقاتل والتمييز في استخدام القوة أو لجوء بعض الدول إلى استخدامها في قمع الاحتجاجات الداخلية.

وما يشير إليه المقرر الخاص بوجه الخصوص، هو عدم وجود نظام محاسبة قانوني، إذ يتساءل من سيتحمل مسؤولية ذهاب هذه الأسلحة إلى أبعد مما هو مسموح به في القانون الإنساني الدولي: هل الشركة المنتجة أو الشخص الساهر على البرمجة أم الدولة المُستخدمة؟

في إطار النقاش الذي تلى عرض تقرير السيد هاينز حول موضوع الروبوتات المستقلة القاتلة، صدرت ردود فعل عن عدة دول في مجلس حقوق الإنسان.

ألمانيا طالبت، على سبيل المثال، بـ “التزام الشفافية قدر الإمكان في مجال تقييم أنواع الأسلحة الجديدة”. في حين أقرت الولايات المتحدة الأمريكية بأن الروبوتات المستقلة القاتلة تطرح مشاكل قانونية وأخلاقية وسياسية، ولكنها لا تعتبرها جديدة بالنظر إلى بعض الصواريخ المُستخدمة بشكل مُستقل منذ سنوات، كما ترى بأن حجم المشكلة يتعدى إطار المناقشة داخل مجلس حقوق الإنسان (في إشارة إلى ضرورة طرحها في مؤتمر نزع السلاح).

من جانبها، حذّرت روسيا من مخاطر وضع النظام القانوني الدولي في موقف حرج بسبب استخدام الروبوتات المستقلة القاتلة، مُشدّدة على ضرورة مراعاة القانون الإنساني الدولي بجدية في هذا الإطار.

أما سويسرا، فقد أعربت عن قلقها من استخدام الروبوتات المستقلة القاتلة، مُذكّرة بأنه من واجب أيّ دولة عدم التخلي عن المسؤولية في استخدام القوة القاتلة. واقترحت سويسرا تشكيل فريق عمل رفيع المستوى يتولى مناقشة الموضوع وإدارة النقاش بشكل يضمن احترام مبادئ القانون الانساني الدولي عند استخدام التكنولوجيا الجديدة.

المهلة أم الحظر؟

بما أن النقاش لا زال في بداياته، ونظرا لكثرة التساؤلات المطروحة حول حقيقة هذه الأسلحة التي تكتنفها الكثير من السرية، وحول تأثيراتها السلبية والإيجابية، اقترح المقرر الخاص المعني بحالات الإعدام خارج نطاق القضاء كريستوفر هاينز، أن تلتزم الأطراف المعنية بـ “مهلة فيما يتعلق بتطويرها”.

يجدر التذكير بأن موضوع الحدّ من الأسلحة في العالم، من مشمولات مؤتمر الأمم المتحدة لنزع السلاح، إلا أنه وبالنظر إلى أن العالم دخل مرحلة جديدة تحوّلت فيها الأدوار وأصبح قرار القتل بيد الآلة، يرى هاينز أن من واجب مجلس حقوق الإنسان أن “لا يبقى صامتا بهذا الخصوص”.

لكن منظمات المجتمع المدني المُنضوية تحت راية “الحملة الدولية ضد الروبوتات القاتلة”، والتي تم إطلاقها يوم الثلاثاء 28 مايو 2013 بقيادة منظمة هيومان رايتس ووتش، فترغب في التوصل بشكل من الأشكال إلى فرض حظر شامل على تطوير وصناعة وتسويق واستخدام هذا النوع من الأسلحة.

وقال ستيف غوس، مدير قسم الأسلحة بالمنظمة أمام الصحافة في جنيف: “إن منظمة هيومان رايتس ووتش ترغب في فرض حظر وقائي، لأنه إذا ما تم ترك المجال مفتوحا أمام تطوير هذه الأسلحة باستثمارات هائلة، فإنه قد يصعب وضع حدّ لذلك بعدُ لاستخدامها”.

ومن أجل توضيح الإطار القانوني لاستخدام مثل هذه الأسلحة، تسعى الحملة التي تضم عددا من المنظمات الإنسانية الدولية، ومن ضمنها بعض المنظمات المدنية العربية، إلى جر الدول نحو إبرام معاهدة دولية، لكن ذلك سوف لن يكون في الغد القريب.

متوافق مع معايير الصحافة الموثوقة

المزيد: SWI swissinfo.ch تحصل على الاعتماد من طرف "مبادرة الثقة في الصحافة"

يمكنك العثور على نظرة عامة على المناقشات الجارية مع صحفيينا هنا . ارجو أن تنضم الينا!

إذا كنت ترغب في بدء محادثة حول موضوع أثير في هذه المقالة أو تريد الإبلاغ عن أخطاء واقعية ، راسلنا عبر البريد الإلكتروني على arabic@swissinfo.ch.