瑞士科学家是如何设法识别深伪换脸的?

由于使用人工智能伪造视频变得日益复杂,瑞士的专家正在重新评估其恶意使用对社会所造成的风险。同时,专家也正在寻找新的途径阻止视频背后的制作者。

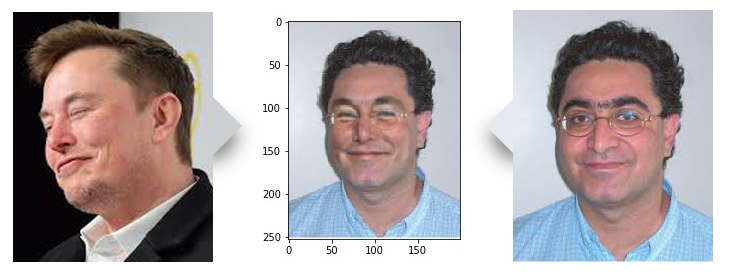

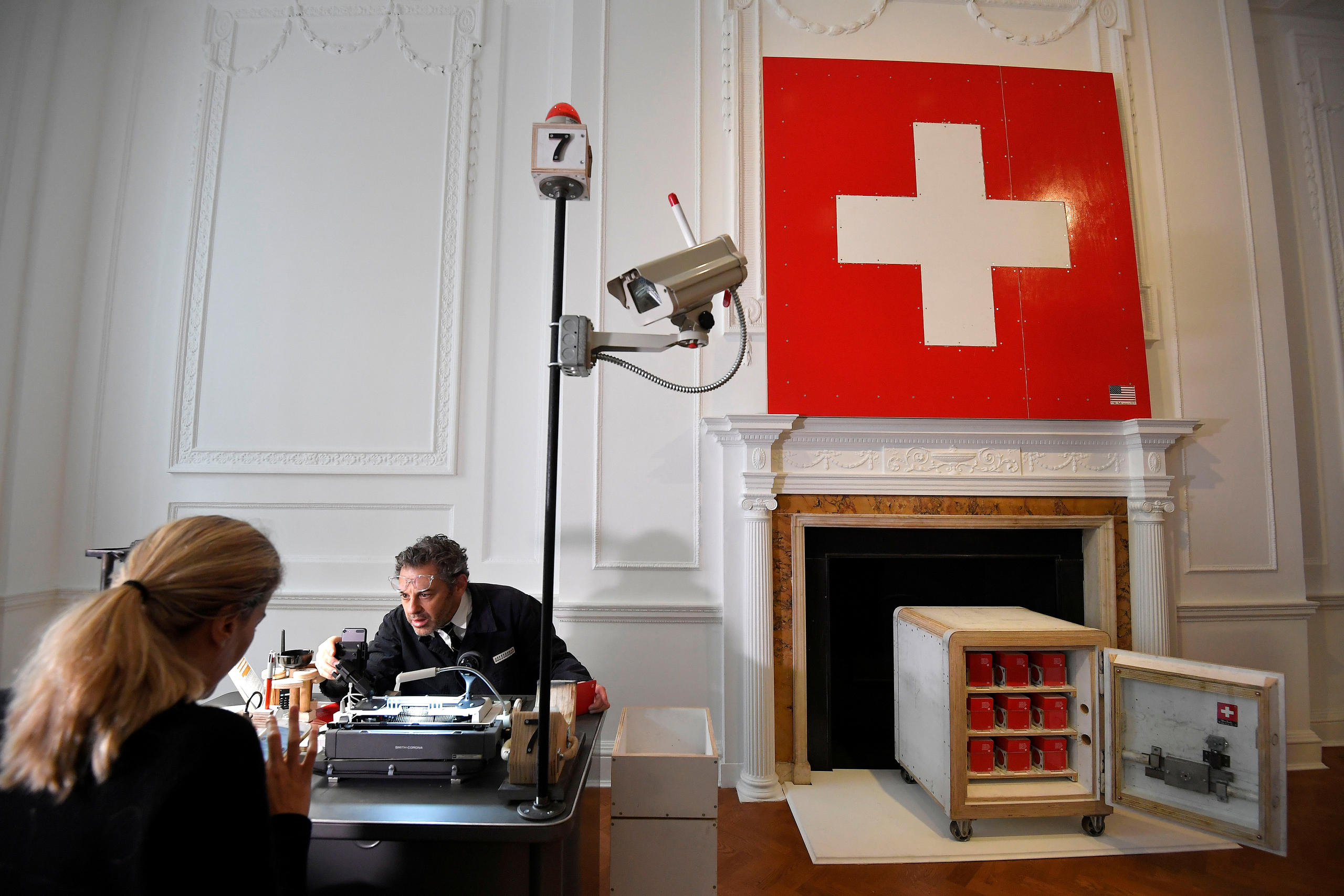

在洛桑联邦理工学院(EPFL)的广阔校区内的一个电脑实验室中,一小队工程师正盯着着一张照片,上面是一个微笑并带着眼镜的男人,他面色红润,有着乌黑的卷发。

首席研究员妥拉第·伊布拉西米(Touradj Ebrahimi)看着屏幕上的照片评论说:“这个不错。”照片上的这个男的长的和他有点相像。小组成员熟练地将他的头像照片与网上特斯拉的总裁埃隆·马斯克(Elon Musk)组合,创造了一个深度伪造的作品—即通过人工智能伪造的数码图像以及视频。

Quantum Integrity(英)外部链接是一家可以识别包括深度伪造等修改图片的网络安全公司。伊布拉西米的团队正与其合作开发软件。这是他们在此过程中所创造的图像之一—其中有一些显得更为真实。

这一软件运用了深度伪造背后的机器学习技术,它正学习如何区分真图片与假图片。 “创造者”将图像输入软件,而“识别者”则试图识别出这个图像。

伊布拉西米解释说“经过大量的训练,机器就可以像人一样识别修改过的图像。使用它的次数越多,它就变得愈加精确。”

修改照片与视频这一现象,自从人们对多媒体产生依赖就一直存在。但是直到最近,人工智能技术才使得伪造者能够更换一个视频中的面部,或者让这个人看起来在说一些他从未说过的话。在过去几年中,深度伪造技术的传播速度,已远超许多专家的预计。

得益于网上那些宜于使用的软件工具以及有偿服务,制作深度伪造视频已经日益变得“快速、方便以及廉价”,洛桑联邦理工学院的国际风险治理中心(International Risk Governance Center 英)外部链接如此评论道。

国际风险治理中心中的副主任安格斯·柯林斯(Aengus Collins)指出:“正是由于这项技术发展得非常迅速,因此,我们需要摸清它的方向,弄清将会有哪些行业、团体以及国家可能会受到影响。”

虽说恶意深度伪造视频的绝大多数问题,都涉及它们在色情行业中的应用,但是现在,人们正在加紧防范同样的技术被用于操纵公共意见。

一个快速发展的领域

当伊布拉西米的团队三年前第一次与Quantum Integrity合作研究识别软件时,深度伪造这项技术并未引起大部分研究者的注意。彼时,Quantum Integrity的客户担心的,是经修改的照片会被用于车辆保险或者房屋保险欺诈之中。

Quantum Integrity的总裁安东尼·萨哈齐亚(Anthony Sahakian)说道:“我非常惊讶,因为我没有料到这一技术发展得如此之快。”

萨哈齐亚亲眼见证了深度伪造技术长远的发展历程,以至于现如今能够实现逼真的效果。最近,这一技术使得人们得以在不破坏各种文件印章的前提下,更换护照上的照片。

让萨哈齐亚这样的专家担心的,不仅仅是修改技术上的提升。根据荷兰网络安全公司Deeptrace统计(英)外部链接,截至2019年9月的短短9个月时间内,网上深度伪造视频的数量几乎翻倍,达到了14678个。

风险区域

深度伪造技术所创造出的内容如果是为了伤害别人,其目标大部分会是女性。她们的面部被挪到一些色情影片或者图像上。根据Deeptrace的调查,深度伪造视频中96%的视频与此相关。有一些视频出现在专门的深度伪造色情网站,而另外一些则是为了羞辱受害人名声的所谓“报复性色情”。

柯林斯说:“网络骚扰以及欺凌,是反复出现的主题。”

相反,很少有深度伪造技术被用于欺诈。大部分的欺诈,则是通过声音模仿技术,欺骗受害人汇钱给犯罪者。

不过业界仍然注意到了这一技术。苏黎世保险(Zurich Insurance)、瑞士再保险公司(Swiss Re)以及法国巴黎银行(BNP Paribas)等公司都派出代表,参加了最近在国际风险治理中心所举办的有关深度伪造技术风险的工作坊。Quantum Integrity的萨哈齐亚表示,与他合作的保险商担心,深度伪造视频可能会被用在意外理赔中。

他说:“这一技术使得企业崇尚的‘了解你的顾客’这一原则变得过时。”这一原则指的是,通过验证顾客的身份以及他们的意图,从而排除一些潜在的欺诈风险。

相关内容

在幼稚園教數據安全與隱私,揭開瑞士政府的「護民主」藍圖

在一段经修改的视频中,美国众议院议长南希·佩洛西(Nancy Pelosi)正在演讲中说脏话。这一视频证实了人们的担忧。它的修改技术含量比较低,被称为是“浅改”。但是伊布拉西米指出:“这是一个信号,表明了这一技术的可能性以及其背后的意图。”

不过,风险专家柯林斯仍提醒人们,在政治中使用合成媒体的实例,需要放在一个大背景中进行评价。

他提醒道:“深度伪造技术确实可能干扰选举,但是我不太同意过度强调这一风险,否则人们将看不到整体情况。”

他表示,深度伪造技术确实向人们传达了一个信号:“数字信息系统发展迅速,社会对此缺乏适应。”

深度伪造技术也能够助长各种活动散布虚假消息,这样会更进一步侵蚀事实与信任之间的链条。

人工智能的创造与识别

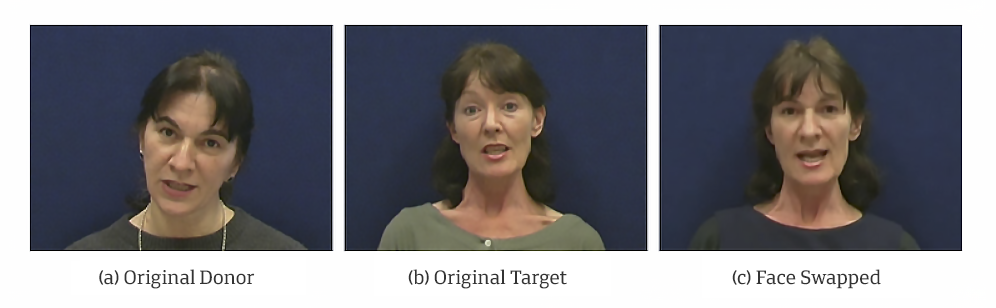

这项技术可能让有些人忧心忡忡,但并非所有人都认为,深度伪造的视频能真实到欺骗大多数的用户。专家认为,现在深度伪造视频的质量大多仍取决于制作者的技术。生物特征识别专家塞巴斯蒂安·马塞尔(Sebastien Marcel)解释说,在视频中换脸,将不可避免地导致图像出现一些不完善的地方。

他补充说道:“(深度伪造)视频的质量会很不稳定,具体稳定程度,则取决于为了改良视频所投入的人力。”他指出,如果制作者花费了大量时间精力去调整视频,那么它可能会变得非常难以识别。

马塞尔和他在马尔蒂尼镇(位于瑞士的西南部)的达尔摩尔感知人工智能感应研究所(Idiap Research Institute)的同事正在研究他们自己开发的识别软件。这一项目的目的,在于帮助识别视频中的脸部以及声音的变换。该研究所准备长期研究这一领域。

马塞尔表示:“这个问题不会在今天就得到解决,这是一个在不断的进步的研究主题,所以我们计划在这一领域投入更多资源。”

但是识别技术究竟能有多少影响,目前还不得而知。

马塞尔说:“很难提供一个万能的解决方法。无论使用哪种识别技术,对手总能找到方法去绕过它。”

伊布拉西米与马塞尔都认同,他们的目标并非发明一个款自动纠正的软件。识别软件的部分目标,是预测修改者可能会采用的手段,而他们就能因此调整应对策略。

在达尔摩尔感知人工智能感应研究所工作的马塞尔,预计在未来,创作者不仅仅能够修改视频的一个方面,而且能修改整段图像。

他表示:“深度伪造技术的质量将会提高,因此我们需要对识别软件不断进行改良。”

社交媒体平台 vs 深度伪造

推特(Twitter)在2020年3月引入一项新的政策,反对合成或修改过的多媒体内容,原因是,这些内容被分享时会造成伤害。它将采取多项行动,其中之一是将这些视频贴上标签,并且给予用户提前警告。而谷歌(Google)所拥有的YouTube,则承诺它不会容忍旨在误导公众的那些针对2020年总统选举与人口普查的深度伪造视频。脸书(Facebook)与谷歌已经发布了与深度伪造相关的一些图像,以帮助研究者开发识别软件。

符合JTI标准

您可以在这里找到读者与我们记者团队正在讨论交流的话题。

请加入我们!如果您想就本文涉及的话题展开新的讨论,或者想向我们反映您发现的事实错误,请发邮件给我们:chinese@swissinfo.ch。