美国虚假信息激增给瑞士直接民主敲响警钟

在美国总统大选临近之际,人工智能生成的虚假内容如洪水般席卷美国。专家警告称瑞士也难以置身事外,相反,瑞士特别容易受那些威胁全球选民的虚假信息策略的影响。

閱讀本文繁體字版本請 點擊此處

相关内容

我们的民主时事简讯

瑞士洛桑联邦理工学院教授、深度伪造专家图拉杰·易卜拉希米(Touradj Ebrahimi)表示:“瑞士非常容易受到影响,因为如果民众接收到错误的信息,他们可能会做出错误的决定。”

这位专家指出,直接民主赋予公民在政策制定中举足轻重的地位,因此将最容易受到人工智能生成的虚假信息和深度伪造的影响。这一情况适用于瑞士,也适用于美国的大多数州(多语),在这些地方,不仅民选代表,普通民众也参与重大决策。

pic.twitter.com/CaH0yXMO0k外部链接

— Donald J. Trump (@realDonaldTrump) August 15, 2024外部链接

美国正在进行的总统竞选活动生动展示了人工智能如何在政治辩论中搅局。最近几周,我们看到和听到了各种匪夷所思的内容:卡玛拉·哈里斯(Kamala Harris)以独裁者形象现身共产主义大会的图片、乔·拜登(Joe Biden)呼吁选民不要投票的音频信息、埃隆·马斯克(Elon Musk)和唐纳德·特朗普(Donald Trump)身着酷炫服装在70年代的音乐中精彩起舞的视频。这些只是X(前Twitter)等社交平台上流传的部分深度伪造内容–利用人工智能(AI)生成的虚假视听内容。

深度伪造目的是制造虚假信息,以极小的代价操纵公众舆论,造成巨大的影响。事实上,已有数百万人观看、点赞并转发了这些深伪内容。美国的情况令人担忧,至少有20个州通过了打击深伪内容的法规,国土安全部也提示了人工智能对总统选举构成的风险。近日,加利福尼亚州通过了一项美国最严厉的打击政治深伪内容的法案。

相比之下,瑞士在立法方面有所滞后。尽管欧盟在《欧盟人工智能法案》中对深度伪造进行了监管,但瑞士政府去年表示,没有必要针对人工智能生成和操纵的内容进行具体的监管。

然而,尽管有这些立法努力,无论是美国还是其它世界上最大的民主国家,都未能在这一年免于虚假视频、照片和新闻的侵扰–这一年,有史以来最多的人(至少40亿)参加了投票。

易卜拉希米表示,人工智能生成的虚假信息越来越多,目前尚未达到顶峰:未来我们将看到越来越多人工合成的媒体内容。随着技术的日益成熟,区分这些内容与真实信息将变得越来越困难。其他接受瑞士资讯swissinfo.ch采访的专家也同意这一观点。

以下是瑞士民主不应该低估人工智能生成的虚假信息之危险的三个主要原因:

1. 搜索引擎和聊天机器人显示有偏见和不正确的信息

非营利组织和研究团体已经警告过人工智能软件和算法会给瑞士民主带来危险和束缚。瑞士非政府组织“算法观察”(Algorithm Watch CH)分析了微软必应搜索引擎中的聊天机器人在2023年10月瑞士联邦选举前给出的回复,发现三分之一与选举有关的回复包含事实错误,人工智能甚至编造了关于某些政治人物的丑闻。“算法观察”的负责人主任安吉拉·穆勒(Angela Müller)指出:“集成到搜索引擎中的生成式人工智能聊天机器人可能会产生误导,因为人们依赖于通过搜索引擎收集到的信息。”

然而,网络搜索引擎本身也可能产生误导。伯尔尼大学和苏黎世大学发布的一份白皮书指出,瑞士最常用的搜索引擎谷歌(Google)对某些信息来源的曝光度并不均衡,而且根据搜索语言(德语、法语或意大利语)的不同,对某个主题的批评性观点数量也有差异。例如,在2023年6月对《气候保护法》进行全民公投之前,研究人员发现,与意大利语和法语查询相比,谷歌在回答德语查询时更倾向于展示对该法案持批评态度的政党的信息。

相关内容

经合组织的研究表明,瑞士人识别假新闻的能力相对较弱

编写白皮书的研究人员之一米科拉·马科尔蒂赫(Mykola Makhortykh)说:“在瑞士这样一个多语言、民意两极分化的民主国家,这些结果理应引起我们的担忧。”他对以下事实敲响了警钟:搜索算法和人工智能软件的运作方式缺乏透明度;大型科技公司尽管做出了承诺,却未能建立有效的系统来打击虚假新闻并解决民意分化问题。

2. 人工智能生成的虚假信息正在削弱媒体的可靠度

马科尔蒂赫说,如今的人工智能系统还能更快、更容易地制造和传播虚假信息。越来越多的新闻网站模仿权威媒体或传统媒体,但实际上却充斥着人工智能自动生成的内容,这些内容往往错误百出,有时甚至完全凭空捏造。这些新闻充斥着主要社交媒体平台的页面,根据fög开展的一项调查,在瑞士流传的虚假信息中,60%以上都是由这些平台发布的。

即使只有一小部分人会阅读人工智能生成的新闻,其制作之精良也可能使人们更难识别和避开假新闻。经合组织(OECD)最近的一项调查将瑞士人列为最不善于识别虚假信息的群体之一。

苏黎世大学政治行为与数字媒体教授卡斯滕·唐奈(Karsten Donnay)表示:“如果现实生活中的记者报道和人工智能生成的新闻看起来很像,那就真的很危险了。”他补充道,人们可能会觉得上当受骗,并对整个媒体系统失去信心。

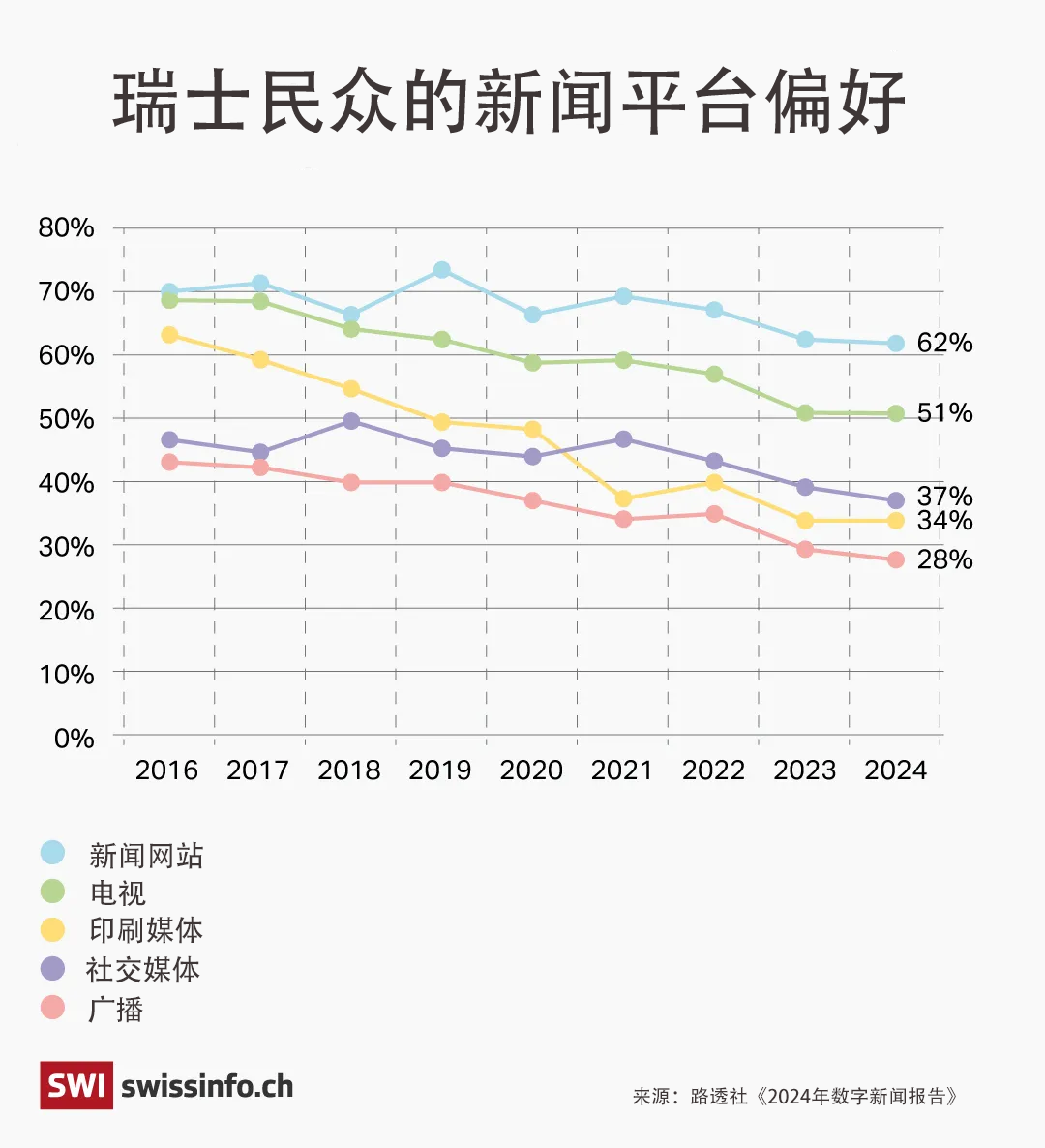

这种生态系统已经促使瑞士人改变信息获取方式。路透社《数字新闻报告》公布的最新数据显示,瑞士的主要信息来源是在线新闻网站。电视、印刷媒体和广播等传统且更为可靠的渠道仍然很重要,但自2016年以来受众数量大幅下降。

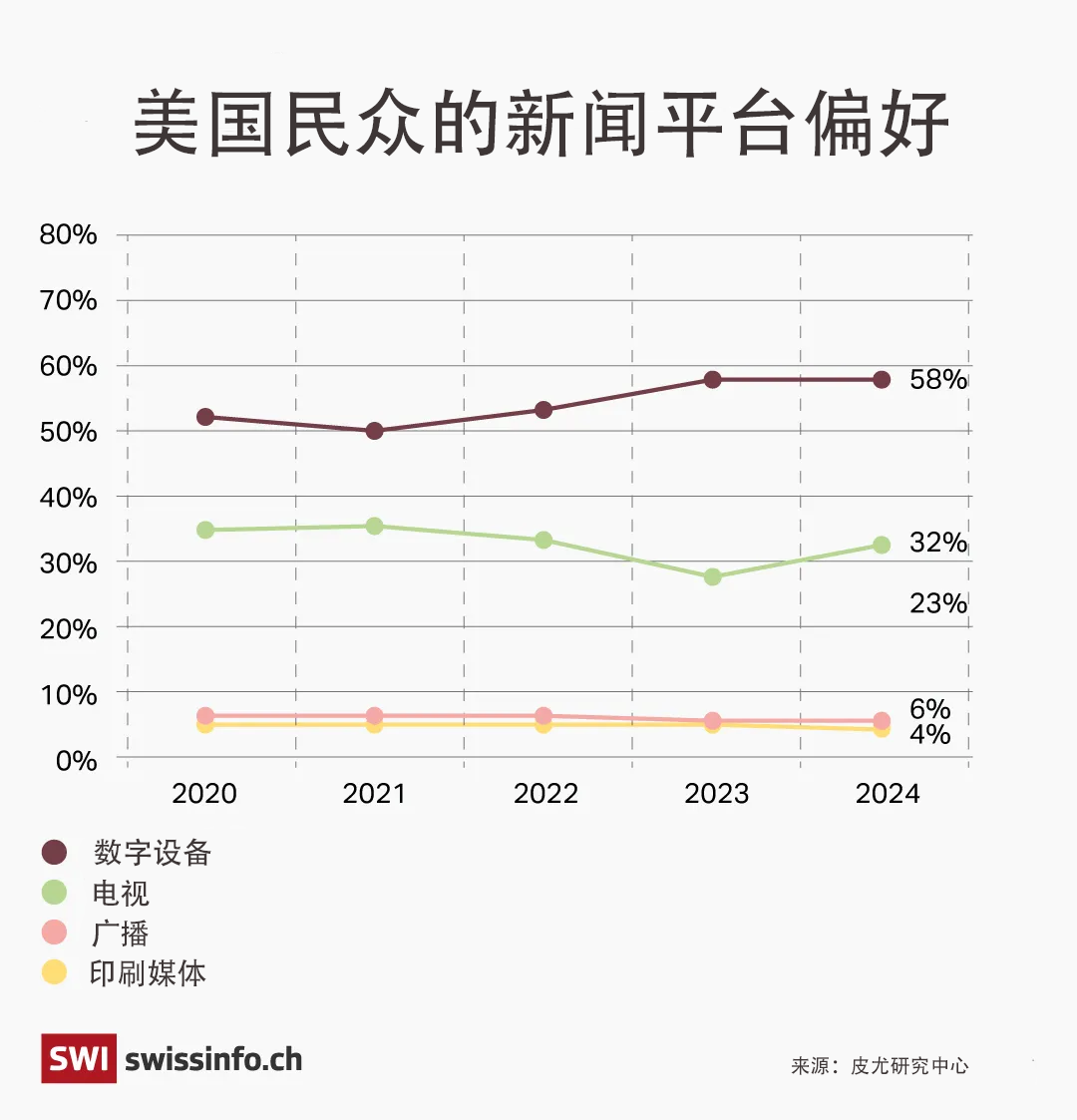

报告指出,传统媒体消费下滑的原因之一是人们被大量新闻轰炸,从而心生倦怠。因此,瑞士人普遍失去了获取信息的兴趣,全球大趋势也是如此。与其他一些民主国家(如美国)相比,瑞士的转变并不那么极端。在美国,民众几乎已经完全放弃传统媒体平台。

唐奈表示,但这并不意味着瑞士更有可能将人工智能的风险降到最低。他认为,搜索引擎和聊天机器人将继续作为信息来源且势头不减。

这位教授指出:“人们会越来越多地使用它们,我们并不知道这会导致什么后果。”不过,他认为现在还为时不晚,可以设立一些防护措施,确保非新闻类信息源也遵守一定的标准。

3. 生成式人工智能技术具有极强的说服力

到目前为止,还很难证明人工智能生成的虚假信息对民众的影响。“这并非一种大众现象,虚假信息只是在小范围内传播,”苏黎世大学政治分析教授法布里齐奥·吉拉尔迪(Fabrizio Gilardi)说。他指出,虚假信息一直存在,最有力的研究表明,它的影响比人们想象的要小得多。吉拉尔迪说:“人工智能不会大幅改变现状。”

在2020年美国总统大选期间,与Meta(Facebook的母公司)合作进行的独立研究证明,社交媒体上流传的虚假信息对人们的态度和行为没有显著影响,也没有加剧民意分化。

但随着ChatGPT等交互式人工智能平台的出现,这种情况可能会发生改变。瑞士洛桑联邦理工学院(EPFL)在美国对约900人进行的研究表明,ChatGPT非常善于引导我们的观点。

相关内容

瑞士人为什么不易受到虚假信息的干扰?

这项研究的作者之一弗朗切斯科·萨尔维(Francesco Salvi)说:“生成式人工智能模型的说服力之强大,足以影响选举。”萨尔维及其团队的研究表明,ChatGPT-4改变一个人想法的几率比人类高出82%。

在掌握用户个人信息后,ChatGPT-4可以生成个性化且更具说服力的信息。即使在其他备受瞩目的虚假信息案件中,如2018年曝光的剑桥分析公司(Cambridge Analytica)非法利用数百万Facebook用户的个人数据施加政治影响,这也是前所未有的。萨尔维认为:“我们可能又会看到类似于剑桥分析案件的事件,不过其影响会是剑桥分析案件的N次方。而且我确信这已经在发生了。”

(编辑:本杰明·冯·维尔、维罗妮卡·德沃尔,编译自英文:瑞士资讯中文部/dh)

相关内容

通讯订阅

符合JTI标准

您可以在这里找到读者与我们记者团队正在讨论交流的话题。

请加入我们!如果您想就本文涉及的话题展开新的讨论,或者想向我们反映您发现的事实错误,请发邮件给我们:chinese@swissinfo.ch。