Qui écrit le code? L’intégration de l’IA dans un monde post humanitaire

Avec la réduction sans précédent des budgets octroyés à l’aide humanitaire, l’intelligence artificielle peut aider à optimiser des ressources limitées. Néanmoins, l’adoption de l’IA comporte ses propres risques.

La récente décision du gouvernement américain de mettre fin à l’aide humanitaire internationale (USAID) a entraîné de lourds déficits de financements dans les programmes d’aide humanitaire à travers le monde. À la lumière de ces défis urgents, il s’avère crucial d’explorer les solutions technologiques à notre portée afin d’en limiter les effets.

L’intelligence artificielle (IA) pourrait être l’une de ces solutions. L’IA peut gérer des budgets d’aide limités avec plus d’efficacité, en prédisant correctement les crises humanitaires avant qu’elles se produisent, en analysant rapidement les besoins humanitaires sur le terrain, et en augmentant la rapidité et l’efficacité logistique de l’aide fournie. Néanmoins, l’adoption de l’IA ne va pas sans risques. Et qu’il s’agisse des entreprises de technologie, des gouvernements ou du secteur humanitaire, leur manière d’aborder ces risques sera déterminante pour l’avenir de l’utilisation de l’IA dans l’action humanitaire.

Plus

Notre newsletter sur la politique extérieure de la Suisse

En 2024, l’USAID a fourni plus de 40%Lien externe du financement de 4.8 milliards de dollars de l’Agence des Nations unies pour les réfugiés. Son retrait soudain a laissé les camps de réfugiés, l’aide humanitaire dans les zones de conflit et les déploiements rapides dans les zones touchées par les catastrophes dangereusement sous-financés.

Selon le New York TimesLien externe, cette mise à l’arrêt a également affecté des programmes de santé internationaux, mettant en péril l’accès à des traitements contre le VIH et des services à destination de plus de 20 millions de personnes, dont 500’000 enfants. Résultat, l’Organisation mondiale de la santé a annoncé la suspension de traitements dans 50 pays.

De leur côté, un changement de priorités économiques et la décision d’augmenter les dépenses en matière de défense ont amené des pays comme l’Allemagne, la France et le Royaume-Uni à faire des coupes dans leurs budgets d’assistance internationale.Lien externe De la même manière, le Parlement suisse a réduit le budget consacré au développement international, au point de menacer de fermeture de nombreux programmes pilotés par l’Agence suisse pour le développement et la coopération (DDC).

>> Lisez cette série d’articles sur la façon dont la Suisse, comme d’autres pays riches, diminue son budget d’aide étrangère:

Plus

Comment la Suisse gère l’aide internationale en cette période de bouleversements mondiaux

En réponse à ces coupes budgétaires, l’IA pourrait contribuer à améliorer les rendements et optimiser l’allocation de ressources dans le secteur humanitaire. De la même manière que cette technologie bouleverse l’industrie en réalisant des économies d’échelle, elle pourrait éventuellement permettre de rationaliser la fourniture de l’aideLien externe et renforcer la surveillance des droits humains.

Un exemple caractéristique du potentiel transformateur de l’IA, c’est le Famine Action Mechanism (FAM)Lien externe, un dispositif propulsé par la Banque mondiale en collaboration avec Microsoft, Google et Amazon Web Services (AWS), une division d’Amazon spécialisée dans le cloud. Lancée en 2018, l’initiative permet d’utiliser des algorithmes d’IA pour lancer l’alerte à un niveau précoce à propos de pénuries alimentaires à venir, permettant une intervention en amont afin de limiter les crises humanitaires.

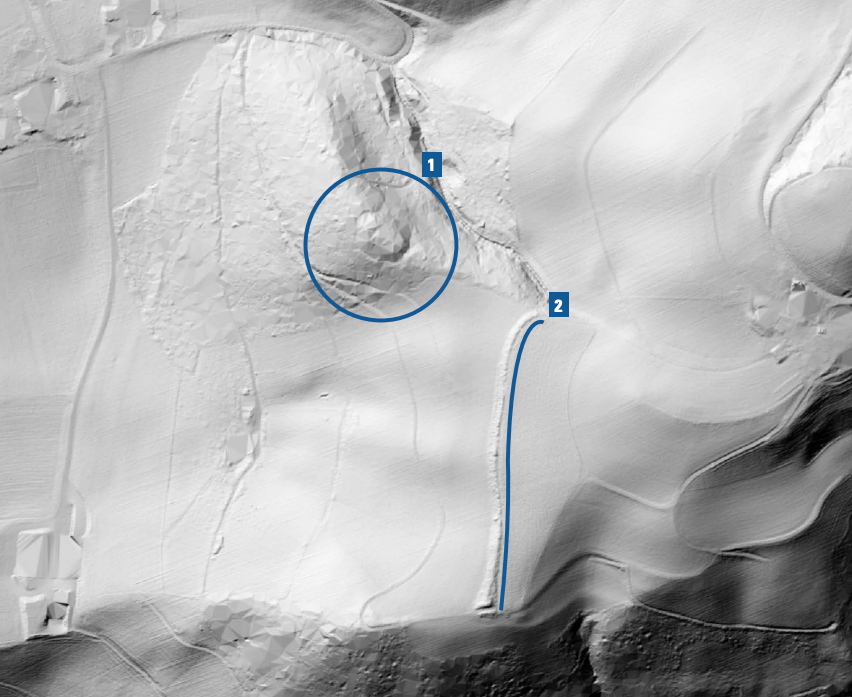

L’IA sert également à optimiser la surveillance et la gestion de droits humains. Par exemple, en 2021, le Danish Refugee Council (DRC) a utilisé l’IA pour prévoir des mouvements de population en analysant des données issues de schémas de déplacementsLien externe des années précédentes, ainsi que des données au sujet de conflits passés, de modèles climatiques et de précédentes initiatives concernant les droits humains.

Le déploiement de l’IA pour des scénarios de prises de décisions cruciales, qui ont un impact sur les vies humaines, ne va pas sans risques. Au-delà des inquiétudes sur la vie privée et la transparence des modèles appliqués, l’un des risques les plus importants concerne les biais inhérents aux algorithmes. Bien que ces algorithmes soient testés et mis à jour en continu pour tenter de limiter leurs biais, l’usage de l’IA dans des circonstances qui impliquent des groupes marginalisés ou en situation vulnérable, comme des femmes ou des minorités ethniques, nécessite une prudence extrême afin d’éviter de causer des préjudices involontaires. Par exemple, la négligence systématique des données d’apprentissage sur le plan historique pourrait conduire à mal évaluer la quantité d’aide à allouer à des communautés indigènes rurales.

Les biais dans l’IA proviennent non seulement des données utilisées pour entraîner les modèles, mais aussi des choix de design et de codage par ses créateurs, qui sont à même d’implanter des normes, des valeurs et des perspectives au sein des systèmes. Comme bien d’autres industries, l’IA est un champ de compétition géopolitique. Son développement est largement dominé par des multinationales et des entités issues de pays développés sur le plan industriel. Cette dominationLien externe implique des défis considérables pour le Sud global, souvent en manque d’infrastructures, de ressources et d’expertise pour créer des solutions d’IA indépendantes. Plus important encore, ces pays peinent à produire des données représentatives de bonne qualitéLien externe, nécessaires à l’entraînement des algorithmes de l’IA.

Cette domination d’entreprises et d’organisations d’IA étrangères présente le risque d’imposer des normes, des valeurs et des perspectives susceptibles de négliger ou d’échouer à respecter les cultures locales et les particularités régionales. Les entreprises issues de démocraties libérales, surtout celles sous l’influence de ce qu’on appelle communément les «valeurs occidentales», ont souvent tendance à intégrer implicitement des cadres dits «WEIRD» Lien externe(sigle qu’on peut traduire par occidentaux, éduqués, industrialisés, riches et démocratiques) au sein des IA qu’elles développent. Par contraste, les sociétés chinoises ont tendance à concevoir des systèmes d’IA qui reflètent les priorités de l’État central en matière de droits, de gouvernance et de relations internationales.

>> Lisez cet article sur la façon dont la Suisse regarde avec intérêt la Chine, qui vise à devenir un pont entre l’Est et l’Ouest dans la course mondiale à l’IA:

Plus

Pourquoi l’approche de la Chine en matière d’IA séduit la Suisse

Le secteur de l’aide humanitaire s’avère particulièrement exposé à l’adoption de solutions d’IA qui renforcent les déséquilibres géopolitiques des pouvoirs. L’arrêt de l’USAID a montré de manière éclatante le degré de dépendance des structures humanitaires envers le financement américain et autres pays donateurs. Cette dépendance financière a souvent été utilisée pour promouvoir les priorités politiques et les normes culturelles des nations donatrices dans le Sud global.

Au moment où les nations occidentales réduisent leur aide humanitaire, la Chine et d’autres acteurs mondiauxLien externe pourraient saisir l’opportunité d’étendre leur présence dans les zones en développement. L’IA constitue un outil potentiellement utile aux efforts d’expansion de l’influence de la Chine. En plus de fournir une aide humanitaire traditionnelle, le pays pourrait remodeler les politiques dans le Sud global par le biais de l’exportation de ses solutions d’IA.

Pour échapper à cette dynamique géopolitique, il faut probablement concevoir des modèles d’IA avec une sensibilité culturelle, et la prise en compte de valeurs locales, de normes et de cadres éthiques, et les développer au sein même du Sud global avec la contribution de talents et de compétences locaux. Les solutions d’IA qui négligent les contextes régionaux risquent de renforcer les dynamiques de dépendance semblables aux pratiques d’aide humanitaire du passé.

Un exemple réussi est celui de Lepala AILien externe, une compagnie d’IA sud-africaine qui a développé le premier petit modèle linguistique multilingue du continent, intitulé InkubaLM. Lepala défend l’idée que les langues africaines comportent des contextes culturels et régionaux, un aspect que les IA généralistes ont du mal à faire valoir.

Les compagnies de technologies commencent à prendre conscience de ce besoin. En février 2025, Microsoft, par exemple, s’est lancé dans un tour de l’IA à Lagos, au NigeriaLien externe, pour promouvoir son engagement en faveur du développement de compétences numériques. L’initiative vise à fournir une expertise en IA à un million de Nigérians d’ici 2026, pour leur permettre l’intégrer l’IA dans leurs entreprises et développer leurs propres aptitudes à l’IA. L’investissement dans des compétences locales et dans des modèles d’IA implantés localement est une approche industrielle intelligente pour les compagnies de tech. Les systèmes bâtis localement s’intègrent plus facilement dans les marchés locaux et reflètent mieux les normes régionales, les valeurs et les perspectives.

La collaboration entre des ingénieurs spécialisés en IA et des professionnels des droits humains est la clé pour parvenir à des solutions qui tiennent compte des contextes sensibles. Des initiatives telles que la collaboration de l’ETH Zurich avec le Comité international de la Croix-Rouge (CICR)Lien externe, la IA Skills Coalition de l’Union internationale des télécommunications (UIT) des Nations unies, l’initiative de la Plateforme de Genève sur les droits humainsLien externe (GHRP) sur les outils de traçage des droits humains encouragent les approches interdisciplinaires en vue d’une exploitation de l’IA à visée humanitaire et tournée vers les droits. Le sommet IA For Good de juillet 2025 vise à rassembler les principaux acteurs clés afin de veiller à ce que l’IA soit en mesure de lutter contre les inégalités et apporter des solutions en matière de surveillance des droits humainsLien externe.

Traduit de l’anglais par Pauline Grand d’Esnon/dbu

Plus

En conformité avec les normes du JTI

Plus: SWI swissinfo.ch certifiée par la Journalism Trust Initiative

Vous pouvez trouver un aperçu des conversations en cours avec nos journalistes ici. Rejoignez-nous !

Si vous souhaitez entamer une conversation sur un sujet abordé dans cet article ou si vous voulez signaler des erreurs factuelles, envoyez-nous un courriel à french@swissinfo.ch.