Intelligence artificielle et démocratie directe sont-elles compatibles?

Selon les uns, l’intelligence artificielle est un danger pour la démocratie. Les autres l’envisagent comme une opportunité. Algorithmes, Big Data: voici comment experts et expertes lisent ces réalités à l’aune de l’expérience suisse.

Tous les trois mois, la Suisse vote. Les débats qui précèdent les référendums sont âpres. Sur Internet, le ton est souvent dur. Insultes, haine pure et même menaces de mort ne sont pas rares. C’est un problème pour la démocratie, explique Sophie Achermann, directrice d’Alliance F, la principale association faîtière féminine du pays.

«Les discussions dures, mais objectives sont importantes. Mais la haine en ligne contrarie la diversité des opinions, selon Sophie Achermann. Les gens ont peur de ce type de messages et préfèrent ne pas s’exprimer.» Avant la votation sur l’initiative sur les pesticides et l’eau potable en 2021, par exemple, plusieurs politiciennes ont reçu tant de courriels haineux qu’elles ne souhaitent plus apparaître en public, assure la directrice. Le phénomène n’est pas proprement suisse. Partout dans le monde, politiciens et politiciennes sont de plus en plus attaqués et menacés en ligne, les femmesLien externe et les minorités surtout.

Alliance F a donc développé un algorithme contre les discours de haine. Cet algorithme est baptisé «Bot DogLien externe», puisqu’à l’image d’un chien, il repère les messages haineux sur les réseaux sociaux et marque les posts. Une équipe de volontaires répond à l’ensemble des messages au cas par cas. L’idée est que la haine en ligne ne reste pas sans réponse et que la discussion puisse se poursuivre de façon objective.

À ce stade, Bot Dog est en phase de test. Mais les premiers essais sont concluants. Des chercheuses et chercheurs de l’EPFZ et de l’Université de ZurichLien externe ont accompagné le projet. Leur constat: les réponses qui en appellent à la compassion envers les personnes visées par des messages de haine s’avèrent particulièrement efficaces. Des phrases comme «Votre post est très douloureux pour les juives et les juifs» tendent à inciter les autrices et auteurs de discours haineux à s’excuser ou à supprimer leur message.

En juillet, le Bot Dog devrait être mis en ligne officiellement. Tout un chacun peut participer au projet, explique Sophie Achermann. Soit en évaluant les commentaires tout en aidant l’algorithme à reconnaître plus précisément les commentaires porteurs de haine. Ou en répondant aux messages haineux repérés par ce dernier.

Une collaboration entre algorithmes et humains

Le Bot Dog n’est qu’un exemple de la manière dont l’intelligence artificielle (AI) peut renforcer la démocratie. Dirk Helbing, professeur en sciences sociales computationnelles à l’EPFZ, souligne l’immense potentiel d’une démocratie numérique. Il pense au budget participatif, qui permet à des citoyennes et citoyens de décider ensemble à quoi le ménage financier de leur ville ou leur commune doit être consacré.

Dans le quartier zurichois de Wipkingen, cette approche est testée grandeur nature. Sur une plateforme numérique, résidentes et résidents ont opté pour des jardins urbains et un festival de streetfood, ces projets recevant chacun 40’000 francs d’argent des impôts.

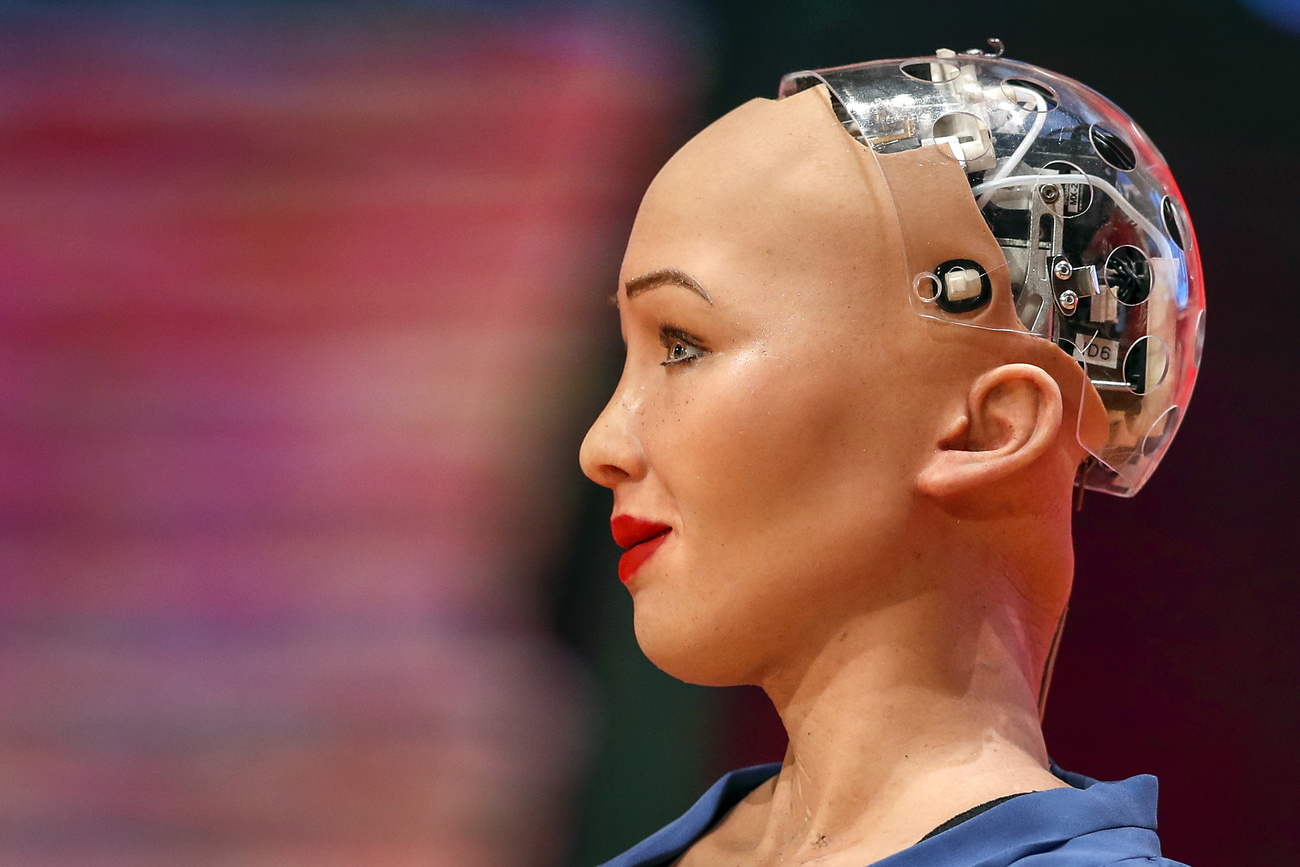

Dans le domaine de la démocratie numérique, les idées fourmillent. Villes et régions de la planète pourraient par exemple se mettre en réseau et s’affronter dans le cadre d’une compétition destinée à identifier les meilleures solutions en matière d’économie durable, de réduction des émissions de CO2 ou de cohabitation paisible. Solutions et données seraient accessibles à toutes et tous en open source et pourraient servir de base à des modèles d’IA. «Je pense que nous nous dirigeons vers une sorte de société numérique participative», estime Dirk Helbing. Soit une coopération entre IA et humains, comme pour Bot Dog, où un algorithme et des volontaires combattent ensemble la haine en ligne.

Le potentiel de l’IA au profit de la démocratie directe est immense, selon ce spécialiste. Mais les applications axées sur les données «présentent également un fort potentiel de destruction pour les formes de société démocratiques fondées sur l’État de droit et les droits humains», prévient-il.

Pas tout rose non plus

Pourquoi? Parce que les algorithmes déterminent toujours plus les informations que nous recevons, les produits qui nous sont présentés et à quel prix. Ils définissent ce que nous voyons du monde et les problèmes auxquels nous donnons du poids. Ce qui fait que notre pensée politique et notre comportement électoral s’en trouvent influencés, explique Dirk Helbing.

La campagne présidentielle de Donald Trump de 2016 en est une bonne illustration. Son équipe a utilisé des algorithmes de Big Data pour personnaliser les contenus destinés à son groupe cible. «Nous les avons bombardés de blogs, de sites Internet, d’articles, de vidéos, de pub jusqu’à ce qu’ils voient le monde comme nous le voulions. Jusqu’à ce qu’ils votent pour notre candidat», expliquera ensuite Brittany Kaiser dans le documentaire de Netflix «The Great Hack». Brittany Kaiser travaillait alors pour la firme Cambridge Analytics, laquelle a siphonné 87 millions de profils Facebook avant l’élection, déclenchant un des plus grands scandales à ce jour en matière de données.

Les électrices et électeurs ont également été ciblés lors de la seconde campagne présidentielle de Barack Obama en 2012. L’équipe du président a maximisé sa collecte de données et envoyé un message personnalisé à chacun et chacune des électeurs et électrices.

Il n’est pas possible de dire avec certitude quelle a été la part de ces méthodes de campagne basées sur l’IA dans le succès des candidats. Mais Dirk Helbing et ses collèguesLien externe voient en elles un grand danger. La combinaison du ciblage et du nudging avec le Big Data lié à nos comportements, nos sentiments et nos intérêts pourrait conduire à un État totalitaire, dit surtout craindre Dirk Helbing. En psychologie, le terme de nudging renvoie au moyen d’inciter les gens à faire quelque chose ou à les pousser dans une direction voulue.

Campagnes électorales

Toute IA requiert une chose: des données. Plus elle en a à disposition, mieux elle fonctionne. En Suisse, la protection des données et de la vie privée est un bien précieux. Les méthodes observées lors des campagnes électorales américaines y seraient-elles possibles? Les partis suisses ont-ils la latitude d’aborder le corps électoral au moyen du microtrageting?

À l’Université de Zurich, Lucas Leemann travaille sur la mesure de l’opinion publique à l’aide de l’apprentissage automatique. Il n’y croit pas. La situation suisse n’est pas comparable à celle des États-Unis, selon lui. Les données brutes utilisées lors des campagnes américaines n’existent pas en Suisse. «Ils avaient un point de données pour quasiment chaque citoyen et citoyenne. Rien à voir avec ce qui est disponible en Suisse.»

Durant ses études, Lucas Leemann a brièvement travaillé pour une entreprise de mode aux États-Unis. Il y avait accès non seulement à la base de données de la clientèle – noms adresses et dates de naissance. Mais pour chacune et chacun, il pouvait connaître le revenu annuel estimé, le nombre d’enfants, le modèle de voiture, la qualité de locataire ou de propriétaire du domicile.

«Aux États-Unis, on peut facilement acheter ces données; elles sont également utilisées à des fins politiques. En Suisse, à ma connaissance, ce genre de données ne sont pas ou pas encore utilisées dans les campagnes politiques.»

Pas encore? Pourra-t-on bientôt se les offrir en Suisse aussi? Dirk Helbing assure en tout cas que la datafication du monde est bien plus avancée que ne le pensent la plupart des gens.

Le spécialiste de l’EPFZ cite l’exemple du Centre for Cybersecurity du Forum économique mondial (WEF) basé à Genève, auquel participent des firmes de toute la planète – Amazon, MasterCard, Huawei Technologies… «Une quantité extrêmement importante de données y sont collectées», indique Dirk Helbing. Les données rassemblées sont entre autres utilisées avec la bénédiction de l’ONU pour la mise en œuvre de l’Agenda 2030 pour le développement durable.

«Cela part sans doute d’une bonne intention. Mais la question se pose de savoir comment tout cela sera mis en œuvre et tout ce qu’il sera en plus possible de faire avec ces données. Le nombre de firmes impliquées est tel que le risque est bien réel que les intérêts commerciaux prennent le pas sur ceux de la société.»

Davantage de transparence

Éviter que l’IA ne devienne une menace pour la démocratie passe par la mise en place dès maintenant de lois et régulations, préviennent les expertes et experts.

Mais pour établir des règles qui marchent, il faut connaître le fonctionnement exact des algorithmes. C’est là qu’est le problème. Une plateforme comme Facebook est une boîte noire, explique Anna Mätzener, directrice de AlgorithmWatch Suisse. «Nous ne savons pas comment les algorithmes fonctionnent dans le détail. Nous ne savons pas non plus exactement quelles données sont collectées et sur qui.»

L’IA, qui assure la curation des contenus en matière de médias sociaux, est un secret bien gardé. Pour découvrir comment l’algorithme agit sur les campagnes électorales, AlgorithmWatch a lancé un projet de recherche en collaboration avec la Süddeutsche ZeitungLien externe. Elles ont demandé à des centaines de volontaires de mettre des données sur leur fil d’actualité Instagram avant les élections législatives allemandes de 2021. Les volontaires ont dû s’abonner aux profils de tous les partis. Un plug-in installé sur le navigateur a enregistré où et comment le contenu de ces profils apparaissait dans les fils d’actualité des utilisateurs et utilisatrices et transmis ces informations à AlgorithWatch.

L’analyse a montré que les contenus de l’Alternative für Deutschland (AfD) arrivaient plus haut dans le fil d’actu d’Instagram que ceux des autres partis. Pourquoi? La recherche n’a pas réussi à répondre.

Mais Meta (anciennement Facebook), propriétaire d’Instagram, n’a semble-t-il guère apprécié cette recherche. Le groupe a menacé AlgorithmWatch de prendre «des mesures plus formelles» si le projet n’était pas abandonné. L’échange de données s’est donc interrompu prématurément.

«Tant que ce type de recherches n’est pas possible, constate Anna Mätzener, nous ne pouvons pas nous prononcer de manière fondée sur l’influence que les contenus curatés par l’IA sur les plateformes ont sur la société. Et en particulier sur la formation des opinions politiques, donc très directement, sur la démocratie.»

Plus

(Traduction de l’allemand: Pierre-François Besson)

En conformité avec les normes du JTI

Plus: SWI swissinfo.ch certifiée par la Journalism Trust Initiative

Vous pouvez trouver un aperçu des conversations en cours avec nos journalistes ici. Rejoignez-nous !

Si vous souhaitez entamer une conversation sur un sujet abordé dans cet article ou si vous voulez signaler des erreurs factuelles, envoyez-nous un courriel à french@swissinfo.ch.