L’intelligence artificielle est-elle réellement si futée?

Les ordinateurs prennent toujours plus de décisions à notre place. A-t-on tout intérêt à les laisser faire? Une équipe de l’institut de recherche suisse Idiap montre en quoi l’intelligence des machines tient dans une large mesure de l’illusion.

Les machines pensent-elles? C’est la question qui ouvre le plus fameux articleLien externe du mathématicien britannique Alan Turing. Publié en 1950, il jette les bases de la manière de concevoir et de définir l’intelligence artificielle (IA). Pour répondre à la question, Turing invente le «jeu d’imitation», utilisé aujourd’hui encore pour juger de l’intelligence d’une machine.

Ce jeu, connu plus tard sous le nom de «test de Turing», implique trois joueurs. Le joueur A est un homme, la joueuse B une femme et le ou la joueuse C, assumant le rôle de l’interrogateur-trice, est de l’un ou l’autre sexe. L’interrogateur-trice ne voit pas les deux autres joueur et joueuse et pose une série de questions écrites afin de déterminer laquelle des deux personnes est l’homme et laquelle est la femme. Le but de l’homme est de tromper l’interrogateur-trice, en donnant des réponses fallacieuses. La femme doit au contraire favoriser son identification.

Imaginons maintenant que le joueur A soit remplacé par un ordinateur. Turing écrit que si l’interrogateur-trice n’est pas capable de distinguer un ordinateur d’une personne, l’ordinateur doit être considéré comme une entité intelligente, se montrant cognitivement similaire à un humain.

Septante ans plus tard, les résultats du test continuent à surprendre. «Jamais aucun système d’intelligence artificielle, je dis bien aucun, n’a passé le premier test de Turing», constate Hervé Bourlard, qui dirige l’institut de recherche Idiap, spécialisé dans l’intelligence artificielle et cognitive.

Plus

La machine et la morale

Ni artificiel ni intelligent

Tombé en désuétude à partir des années 1970 – considéré alors comme démodé et ridicule – le terme d’intelligence artificielle est redevenu tendance dans les années 1990, «pour des raisons publicitaires, marketing et commerciales», explique Hervé Bourlard, également professeur d’ingénierie électrique. «Mais, ajoute-t-il, sans réels progrès autres que sur le plan de la puissance des modèles mathématiques.»

Le spécialiste est sceptique à l’égard de cette notion d’intelligence artificielle et de la manière actuelle de l’utiliser. Pour lui, l’«intelligence artificielle» ne correspond à aucune réalité, sachant qu’aucun système ne reflète la moindre intelligence humaine. Même un bébé de deux ou trois mois parvient à faire ce dont aucune machine IA ne se sera jamais capable.

Un simple exemple pour l’illustrer. Prenons un verre d’eau posé sur une table. Un enfant sait très bien que, renversé, le verre sera vide. «C’est pourquoi il aime le renverser. Aucune machine au monde n’est à même de saisir cette différence», explique Hervé Bourlard.

Le constat vaut aussi en matière de bon sens, une capacité humaine que les machines ne peuvent pas – et selon le scientifique – ne pourront jamais imiter.

L’intelligence est dans les données

L’IA, cela dit, est bien implantée dans les entreprises de nombreux secteurs et contribuent toujours plus aux processus décisionnels dans des domaines comme les ressources humaines, l’assurance, le prêt bancaire et bien d’autres encore.

En analysant les comportements humains sur Internet, les machines apprennent qui nous sommes et ce que nous aimons. Les moteurs de recommandation filtrent ensuite les informations les moins pertinentes et, sur les médias sociaux, nous conseillent films à voir, nouvelles à consommer, habits possiblement à notre goût.

Mais cela ne rend pas pour autant intelligente l’intelligence artificielle, assure Hervé Bourlard. Celui qui dirige Idiap depuis 1996 préfère parler d’apprentissage automatique. Trois éléments, selon lui, donnent sa force à l’IA: la puissance de calcul, les modèles mathématiques et les vastes et omniprésentes bases de données.

Les ordinateurs toujours plus puissants et la numérisation de l’information ont permis d’améliorer fortement les modèles mathématiques. Internet et ses bases de données sans fins ont fait le reste, poussant toujours plus loin les capacités des systèmes d’IA.

A l’Idiap, le public découvre comment l’AI fonctionne et ce qu’elle est capable de faire:

L’Idiap souhaite démontrer au grand public à quel point les données sont cruciales pour les systèmes d’IA. Et ce, à travers un certain nombre de démonstrations, présentées à partir du 1er avril prochain au Musée de la mainLien externe à Lausanne.

Le public pourra notamment examiner la manière dont la technologie basée sur l’IA, cachée dans nos appareils photo et nos smartphones, peut améliorer significativement la qualité des images à faible résolution. Ou, au contraire, la détériorer, en fonction des données sur la base desquelles elle aura été entrainée.

Ce n’est pas un processus aisé: il requiert des données de qualité en quantité qui doivent être annotées, ou «étiquetées», par un humain (une opération qui n’est pas entièrement manuelle) pour les rendre compréhensibles pour une machine.

«Nous n’avons pas affaire à quelque chose qui a une vie en soi, mais à un système alimenté en données», rappelle Michael Liebling, en charge du groupe de bioimagerie computationnelle de l’Idiap.

Cela ne signifie pas que l’IA soit parfaitement sûre. Les limites des machines dépendent de celles des données. Ce qui, selon Michael Liebling, devrait nous inciter à bien identifier l’endroit où se situe le vrai danger.

«Le danger se trouve-il réellement dans une machine de science-fiction prenant le contrôle du monde? Ou dans la manière dont nous distribuons et annotons les données? Personnellement, je pense que la menace réside dans la façon dont les données sont gérées plutôt que dans les machines elles-mêmes», plaide le responsable.

Plus

Pour une intelligence artificielle dotée de valeurs européennes

Besoin de plus de transparence

Les géants de la technologie comme Google et Facebook sont parfaitement conscients de la puissance des modèles alimentés par des quantités massives de données. Ils ont bâti leurs activités grâce à eux. Cet aspect, ainsi que l’automatisation de certaines tâches humaines, sont les éléments suscitant le plus d’inquiétude au sein de la communauté scientifique.

Ancien de la recherche chez Google, Timnbit Gebru a du reste été congédié pour avoir critiqué les modèles linguistiques à la fois vastes et impénétrables qui sous-tendent le moteur de recherche le plus utilisé au monde.

La limite des modèles d’apprentissage automatique est qu’ils ne font pas preuve – du moins pas encore – d’une capacité de raisonnement égale à la nôtre. Ils sont capables de fournir des réponses, pas d’expliquer pourquoi ils sont arrivés à telle ou telle conclusion.

«Il faut absolument les rendre transparents et compréhensibles pour un public humain», estime André Freitas, qui dirige le groupe de recherche Reasoning & Explainable AI à l’Idiap. Son team est d’ailleurs en train de concevoir des modèles capables d’expliquer leurs cheminements déductifs.

Ici, l’objectif est de transformer les algorithmes complexes et le jargon technique en des notions compréhensibles et accessibles. Alors que les applications de l’IA tendent à imprégner nos vies, André Freitas a cette recommandation: «Confronté à un système d’IA, mettez-le au défi de s’expliquer lui-même».

Plus

Qu’advient-il lorsque Google joue avec l’éthique?

Illusions d’intelligence

L’IA est souvent décrite comme le moteur des technologies actuelles. Elle suscite tout naturellement excitation et attentes élevées. Les ordinateurs utilisant des modèles de réseaux neuronaux, inspirés par le cerveau humain, montrent leur efficacité dans des domaines impensables jusqu’ici. «Cela nous a fait croire que l’IA deviendrait aussi intelligente que nous et qu’elle résoudrait tous nos problèmes», note Lonneke van der Plas, à la tête du groupe Computation, cognition et langage de l’Idiap.

Et la scientifique d’illustrer les capacités de plus en plus avancées d’outils linguistiques comme les assistants virtuels ou les instruments de traduction automatique. «Ils nous laissent sans voix et nous pensons que si un ordinateur parvient à se mesurer à quelque chose d’aussi complexe, il doit bien y avoir de l’intelligence.»

Les outils linguistiques peuvent nous imiter, les modèles sous-jacents étant capables d’apprendre des motifs à partir de vastes volumes de textes. Mais en comparant par exemple les capacités d’un assistant virtuel (à commande vocale) à celles d’un enfant lorsqu’il évoque un avion en papier, on voit vite que l’outil a besoin de beaucoup plus de données pour se mettre au niveau de l’enfant – et il aura du mal à appréhender les savoirs ordinaires comme le sens commun. «On se trompe facilement, mais sembler humain n’implique pas forcément l’existence d’une intelligence humaine», explique Lonneke van der Plas.

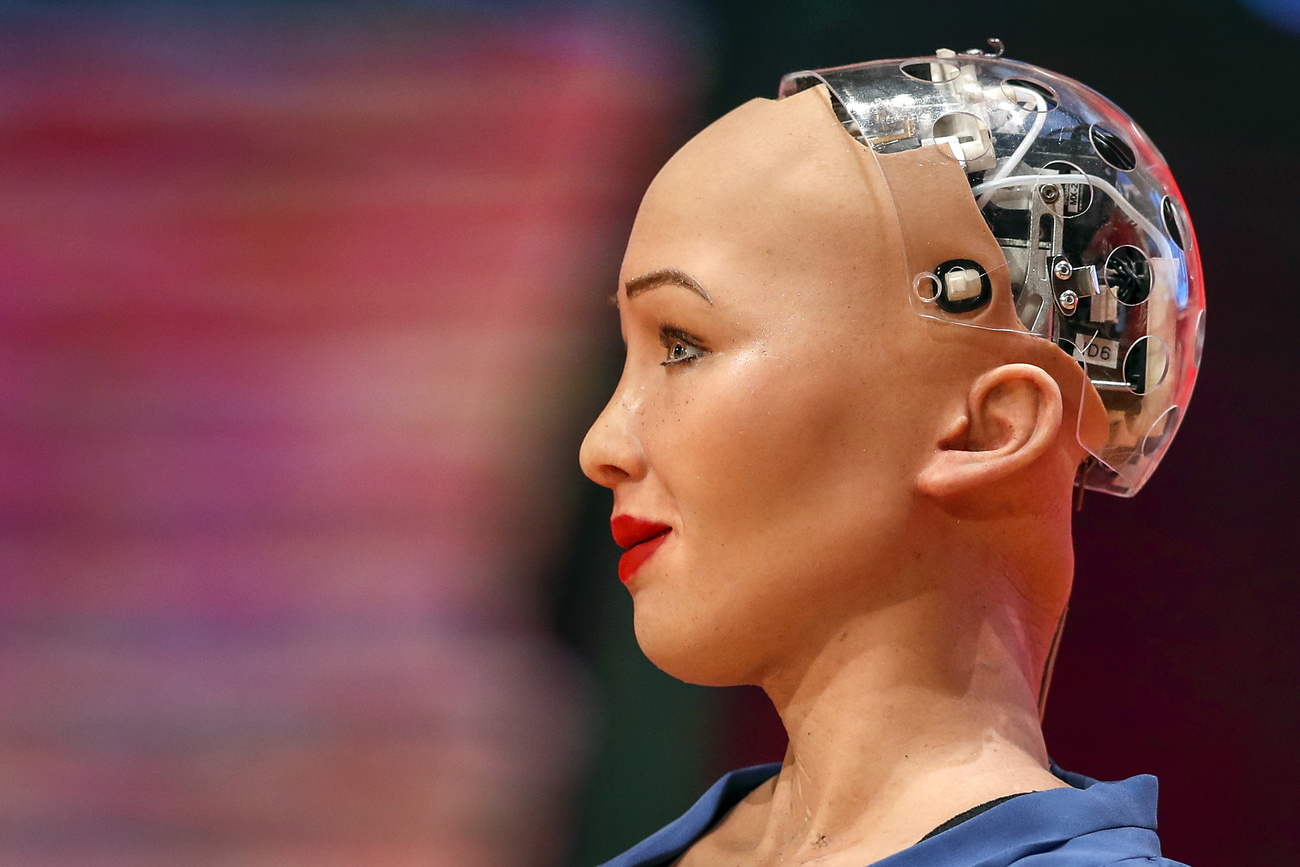

Après tout, Turing le disait déjà il y a 70 ans: il est inutile d’essayer d’humaniser une «machine pensante» au moyen de corrections esthétiques. Ce n’est pas la couverture du livre qui détermine sa valeur intrinsèque.

Plus

(Traduction de l’italien: Pierre-François Besson)

En conformité avec les normes du JTI

Plus: SWI swissinfo.ch certifiée par la Journalism Trust Initiative

Vous pouvez trouver un aperçu des conversations en cours avec nos journalistes ici. Rejoignez-nous !

Si vous souhaitez entamer une conversation sur un sujet abordé dans cet article ou si vous voulez signaler des erreurs factuelles, envoyez-nous un courriel à french@swissinfo.ch.