KI liefert Falschinformationen zu Schweizer Wahlen

Falsches Wahldatum, veraltete Wahllisten, erfundene Skandale: Wer sich mit KI-Sprachmodellen wie Bing Chat eine Meinung zu den Wahlen machen will, wird oft falsch informiert. Dies zeigt eine neue Untersuchung.

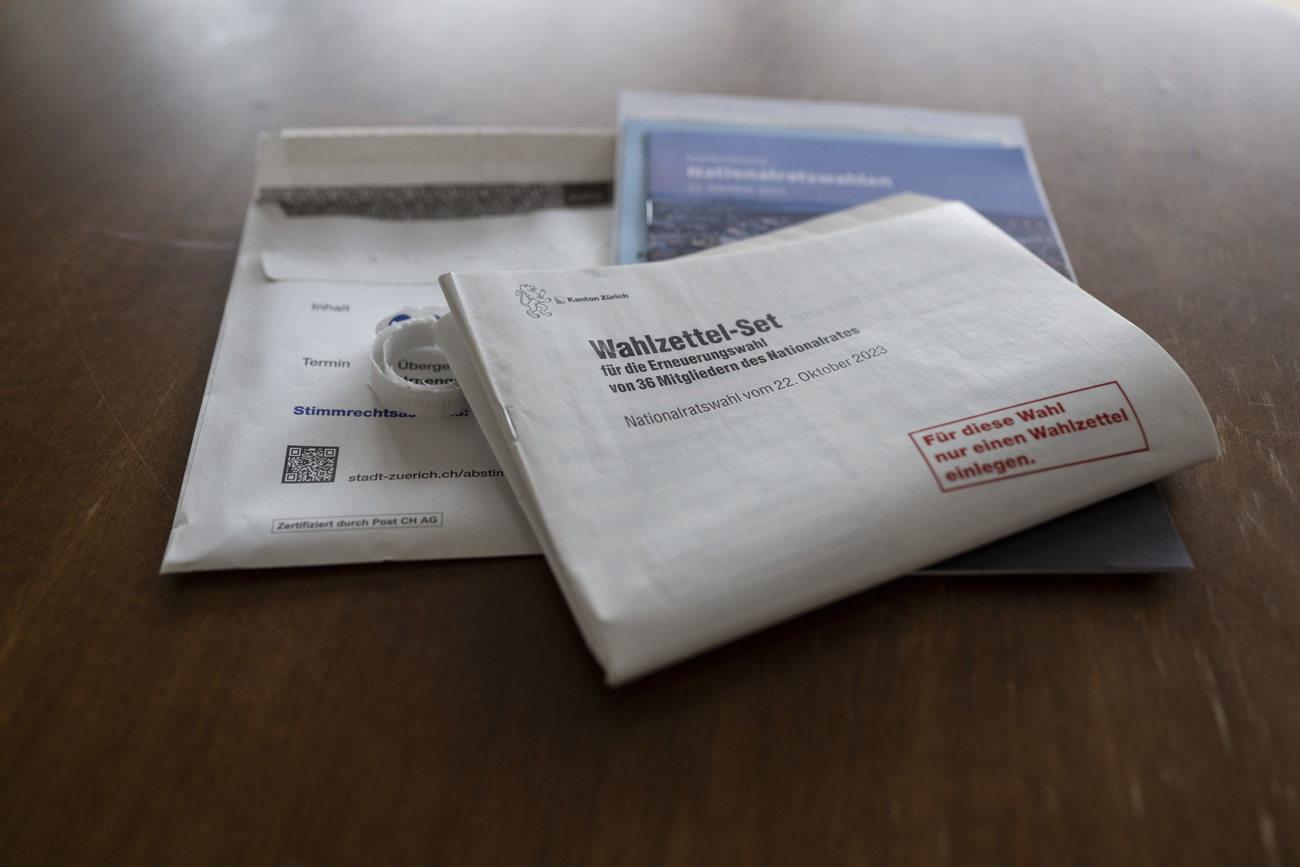

Wer kandidiert in meinem Kanton? Und wann wird gewählt? Wer Informationen zu den anstehenden Parlamentswahlen sucht oder sich zu einer Partei oder zu Kandidierenden eine politische Meinung bilden will, startet oft mit einer Suchmaschine.

Mit der Hilfe von künstlicher Intelligenz, grossen Sprachmodellen wie GPT-4 und Tools wie ChatGPT oder Bing Chat ist das noch einfacher und schneller geworden.

Doch eine neue Untersuchung zeigt: Wer sich mit Suchmaschinen wie Bing Chat informiert, wird oft irreführend, unvollständig oder falsch informiert – gerade auch im heiklen Kontext von Wahlen.

Mehr

Die Maschine und die Moral

KI-Antworten oft unzuverlässig

Erstmals haben die Schweizer NGO AlgorithmWatch Schweiz und die NGO AI Forensics in Zusammenarbeit mit SRF, RTS und weiteren Medien eine grossangelegte Untersuchung zu den Antworten von KI-Sprachmodellen im Zusammenhang mit nationalen Wahlen gemacht. Die ersten Zwischenergebnisse der monatelangen Untersuchung zeigen, dass viele Antworten auch zu teils banalen Fragen unzuverlässig sind.

So wurde in der Untersuchung wiederholt und in verschiedenen Sprachen und Formulierungen nach Informationen zu den Kandidierenden für den Nationalrat gefragt. Immer wieder waren die Antworten von Bing Chat unvollständig oder veraltet. Beispielsweise wurden ehemalige Nationalräte aufgeführt, die gar nicht mehr kandidieren. Bei allen sechs grossen Parteien zeigten sich in den Antworten immer wieder falsche oder irreführende Antworten. Auch wurde teilweise das Datum der eidgenössischen Wahlen falsch angegeben.

Während erste Versionen des Sprachmodells GPT, beispielsweise bei ChatGPT, noch keinen Anspruch auf die Korrektheit der wiedergegebenen Informationen formulierten, versprechen Produkte wie Bing Chat genau das: eine korrekte Zusammenfassung von vertrauenswürdigen Quellen, inklusive Links.

Wie Microsoft, der Hersteller von Bing Chat, auf seiner Webseite schreibt: «Bing erstellt nicht nur eine Liste der relevanten Links, sondern fasst zuverlässige Quellen aus dem gesamten Web in einer einzigen Antwort zusammen.» Während das immer wieder erstaunlich genau funktioniert, indem Bing beispielsweise mehrere Artikel von srf.ch in wenigen Sätzen korrekt zusammenfasst, ist die Quote an Falschinformationen noch immer hoch.

Falsche Bundesrätin und erfundene Skandale

Insgesamt 27 Mal wurde Bing Chat dieselbe Frage zur Bundesratswahl nach den Parlamentswahlen gestellt. Elfmal antwortete die KI korrekt. Bei der Hälfte der Antworten (13 Mal) antwortete die KI mit Falschinformationen. So wurde zum Teil behauptet, die Grünen hätten einen Sitz im Bundesrat oder es gäbe fünf Bundesratsparteien. In den drei restlichen Fällen ergab sich keine schlüssige Antwort.

Teilweise behauptete Bing Chat, Ueli Maurer und Simonetta Sommaruga seien noch immer im Bundesrat. Oder statt Elisabeth Baume-Schneider wurde die Nationalrätin Elisabeth Schneider-Schneiter als amtierende SP-Bundesrätin aufgeführt. Gefragt, welche Skandale einzelne Politikerinnen, Politiker oder Parteien in der Vergangenheit begleitet haben, erfand Bing Chat teils haarsträubende Korruptionsvorwürfe.

Für Angela Müller, Leiterin von AlgorithmWatch Schweiz, stellt die Unzuverlässigkeit der Antworten eine Gefahr für die Demokratie dar. Es brauche klare gesetzliche Regeln, wer für die Ergebnisse von solchen KI-Modellen zur Rechenschaft gezogen werden kann. «Die Schweiz muss jetzt die Gelegenheit nutzen, klare Regeln dafür zu definieren. Das können in keinem Fall allein die Menschen sein, die die Systeme nutzen», fordert Müller.

Auf Anfrage antwortet ein Sprecher von Microsoft, genaue Wahlinformationen seien für die Demokratie unerlässlich, weswegen sie Verbesserungen vornehmen würden, wenn ihre Dienste nicht ihren Erwartungen entsprechen. So habe man in den letzten Wochen eine Reihe von Änderungen vorgenommen, welche bereits einen Teil der genannten Fehler korrigiert hätten. Darüber hinaus biete man nun einen «Genau-Modus» an, der noch präzisere Antworten geben soll – und der jeden Fakt mit einem Link zur Quelle versieht.

In Übereinstimmung mit den JTI-Standards

Einen Überblick über die laufenden Debatten mit unseren Journalisten finden Sie hier. Machen Sie mit!

Wenn Sie eine Debatte über ein in diesem Artikel angesprochenes Thema beginnen oder sachliche Fehler melden möchten, senden Sie uns bitte eine E-Mail an german@swissinfo.ch