Google und die Ethik der Künstlichen Intelligenz: Eine Entlassung wirft Fragen auf

Tech-Giganten wie Google sind sich der Macht der von ihnen vorangetriebenen Künstlichen Intelligenz (KI) nicht vollständig bewusst. Das zumindest behaupten Wissenschaftlerinnen und Wissenschaftler in der Schweiz, die in dieser Sparte tätig sind. Die jüngste Entlassung einer Ethikexpertin bei Google wirbelte viel Staub auf. Denn dieser Schritt stellt in Frage, ob ein Moralkodex rund um KI wirklich zu den obersten Prioritäten der technologischen Grossunternehmen gehört.

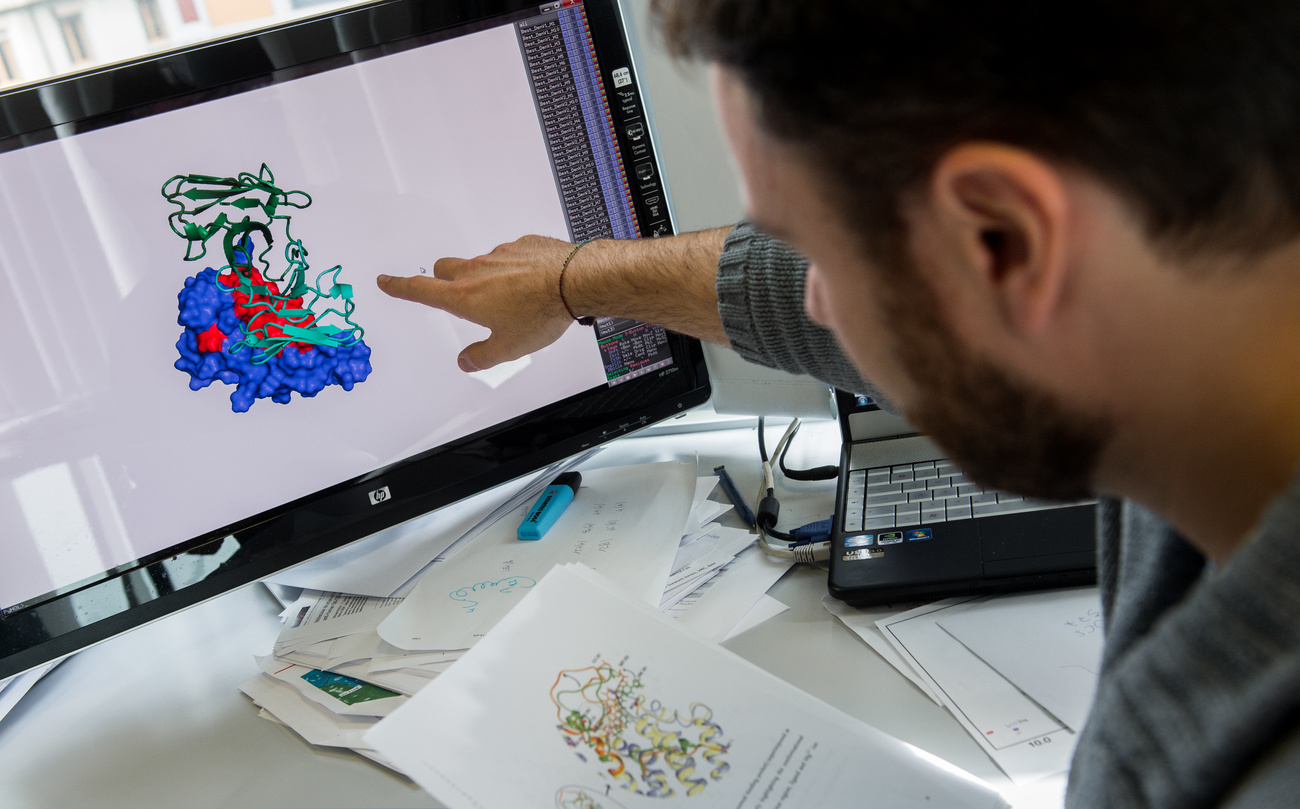

«Die Algorithmen, an denen wir arbeiten, sind eine Angelegenheit von öffentlichem Interesse, nicht von persönlichen Vorlieben», schrieb El Mahdi El Mhamdi auf Twitter. Er ist der einzige Mitarbeiter von «Google Brain» in Europa, der im Ethik-Team für Künstliche Intelligenz (KI) mitarbeitet.

Damit kritisierte er die fristlose Entlassung seiner Chefin Timnit Gebru im Dezember 2020. Google Brain ist eine Forschungseinheit von Google, das daran arbeitet, die Funktionsweise eines normalen menschlichen Gehirns mithilfe von Deep-Learning-Systemen zu erfassen und zu verbessern.

Mehr

Die Maschine und die Moral

Gebru gilt als eine der besten Forscherinnen in Sachen KI und war Vize-Chefin der Google-Arbeitsgruppe über Ethik in der Künstlichen Intelligenz (KI). In einem gemeinsam mit anderen Wissenschaftlern verfassten Artikel warnte sie vor den ethischen Gefahren in der KI-Textsoftware, welche die Grundlage von Googles Suchmaschine und damit die Basis für dessen Geschäft bilden.

Geboren wurde Timnit Gebru 1982 in Addis Abeba (Äthiopien) als Tochter eritreischer Eltern. Während des Krieges zwischen Äthiopien und Eritrea kam sie mit 15 Jahren als Flüchtling in die USA.

Sie studierte Informatik an der Stanford University und promovierte im Bereich Computer Vision am Stanford Artificial Intelligence Laboratory.

Ihre Doktorarbeit über die Verwendung von grossflächigen öffentlichen Bildern zur Durchführung soziologischer Analysen machte sie einer grösseren Öffentlichkeit bekannt. Die New York Times und der Economist berichteten darüber.

Ihren wissenschaftlichen Durchbruch erreichte sie mit der Gemeinschaftspublikation von Forschungsergebnissen, welche die Ungenauigkeit und Diskriminierung von Gesichtserkennungssystemen gegenüber Frauen und farbigen Menschen aufzeigen.

Im Jahr 2018 arbeitete Gebru für Microsoft Research, bevor Google sie als Co-Leiterin für den Aufbau des Teams für Ethik in der KI engagierte. Im Dezember 2020 löste Google ihren Arbeitsvertrag fristlos auf.

Sie warnte, dass diese Sprachmodelle riesige Textmengen im Internet analysieren, die zumeist aus der westlichen Welt stammen. Diese geografische Verzerrung berge unter anderem das Risiko, dass rassistische, sexistische und beleidigende Sprache aus dem Web in den Datenbanken von Google lande und vom System reproduziert werde.

Doch diese Arbeit über rassistische und geschlechterspezifische Vorurteile von Textsoftware mit Künstlicher Intelligenz missfiel ihrem Arbeitgeber. Google forderte sie auf, den Beitrag zurückzuziehen. Sie weigerte sich. Und verlor ihren Job.

"Google’s short-sighted decision to fire and retaliate against a core member of the Ethical AI team makes it clear that we need swift and structural changes if this work is to continue…1\https://t.co/ojaCydyS6fExterner Link

— Timnit Gebru (@timnitGebru) December 17, 2020Externer Link

Auch andere Forschende haben die Risiken einer unkontrollierten Entwicklung von KI-Systemen untersucht und Schwachstellen aufgezeigt.

Alexandros Kalousis, Professor für Data Mining und maschinelles Lernen an der Fachhochschule Westschweiz (HEV-SO), gibt zu bedenken: «KI ist allgegenwärtig und macht rasante Fortschritte; dennoch ist den Entwicklern von KI-Tools oft nicht wirklich bewusst, wie sich diese verhalten werden, wenn sie in komplexen realen Situationen eingesetzt werden.» Und fügt an: «Die Erkenntnisse über schädliche Konsequenzen kommt oft erst im Nachhinein, wenn sie überhaupt kommen.»

Wtf @GoogleExterner Link @GoogleAIExterner Link??

— Lê Nguyên Hoang (Science4All) (@le_science4all) February 28, 2021Externer Link

Before deploying any larger language models, are you confident that such a dangerous misinformation, probably ubiquitous in your training dataset, will not be repeated by your algorithms?

How does firing your ethics team help you make "responsible AIs"? https://t.co/9Fw8bOHonCExterner Link

Der Fall von Timni Gebru zeigt zudem auf, dass Forschende, die Folgen der Technologien kritisch unter die Lupe nehmen, von ihren eigenen Unternehmen nicht unbedingt geschätzt werden. «Timnit Gebru wurde von Google eingestellt, um sich mit KI-Ethik zu beschäftigen, und wurde gefeuert, weil sie sich mit KI-Ethik beschäftigte.

Das zeigt auf, wie sehr dem Unternehmen diese ethischen Fragen am Herzen liegen…», ironisiert Anna Jobin, Wissenschaftlerin am Humboldt-Institut für Internet und Gesellschaft in Berlin und Expertin für Ethik neuer Technologien. «Wie kann Google selbst je ethischer werden, wenn sogar eine in der Öffentlichkeit bekannte Spezialistin für Ethik der KI auf diese Art und Weise gefeuert wird?», fragt Jobin.

If a company cannot even pretend to care about its internal "Ethical AI" co-leader, how much do you think they care about the rest of us?

— Dr. Anna Jobin (@annajobin) December 9, 2020Externer Link

In the wake of Google's outing of @timnitgebruExterner Link, my two cents on #AIethicsExterner Link #BigTechExterner Link #IStandWithTimnitExterner Link: https://t.co/xzxlaNwPvCExterner Link

Ein gestürztes Symbol

Gebru war ein Symbol für eine neue Generation von weiblichen und schwarzen Führungskräften in der Tech-Welt, einer Welt, die von weissen Männern dominiert wird. Zusammen mit ihrer Kollegin Margaret Mitchell, die im Februar von dem Unternehmen entlassen wurde, hatte sie ein multikulturelles Team aufgebaut, um eine ethische und inkludierende Entwicklung von Googles KI-Systemen zu fördern.

Nachdem Google seine ethischen KI-Prinzipien in einem Leitfaden dargelegt hatte, beschloss das Unternehmen 2019, seine interne Governance-Struktur zu vervollständigen. Zu diesem Zweck wurde unter dem Namen «Advanced Technology External Advisory Council» (ATEAC) ein unabhängiger Beirat gegründet, der die Entwicklung der künstlichen Intelligenzsysteme des Unternehmens beaufsichtigen sollte.

«Diese Gruppe wird sich mit einigen der komplexesten Herausforderungen von Google befassen, die unter unsere KI-Prinzipien fallen – beispielsweise die Gesichtserkennung und Fairness beim maschinellen Lernen. Die Gruppe soll unterschiedliche Sichtweisen einbringen, um unsere Arbeit zu unterstützen. Wir freuen uns darauf, uns mit den ATEAC-Mitgliedern auszutauschen», schrieb Kent Walker, Vizepräsident der Abteilung Global Affairs, in Googles Blog.

Trotz dieser guten Vorsätze wurde dieser Beirat weniger als zwei Wochen nach Aufnahme seiner Arbeit wieder abgeschafft. Der Grund war die Ernennung von zwei umstrittenen Vorstandsmitgliedern. Einer galt als Konservativer mit «Anti-Trans-, Anti-LGBTQ- und Anti-Immigranten-Einstellung». Das zweite Mitglied trat in der Folge selbst zurück.

Anna Jobin warnt sogar davor, «dass sich ‹ethische KI› als unethische Kraft entpuppen kann, als rein kosmetische Etikette, um einen Geschäftsgang zu verschleiern, der in Wirklichkeit in einem Konflikt mit moralischen Grundsätzen des Unternehmens steht.»

Dieser Fall könne eintreten, wenn ein Problem nicht adäquat behandelt werde und die zuständigen Teams keine echte Handlungsfähigkeit hätten. Ähnlich wie beim «Green Washing», bei dem Unternehmen Umweltrichtlinien anpreisen, in Wahrheit aber nicht danach handeln, könnte man von «Ethics washing» sprechen – also von «ethischer Reinwaschung».

Burak Emir, ein leitender Software-Ingenieur, der seit 13 Jahren für Google in Zürich arbeitet, stellte nach der Entlassung von Timnit Gebru den Sinn und Zweck der Ethikforschung des Unternehmens in Frage.

«Wozu haben wir eine Ethik-Abteilung, wenn man nur schöne Dinge sagen kann?», fragt sich der Ingenieur. «Wenn das Ziel einer solchen Abteilung darin besteht, nur nette und wohlwollende Forschungsergebnisse zu publizieren, ist diese Art von Erkenntnisgewinn wenig nützlich. Wir brauchen hingegen mehr Transparenz.»

It took me a while (sorry), but I read up on available info & came around to think that @timnitgebruExterner Link's reaction makes sense. The demands formulated here are reasonable, and research leadership has to move to regain trust.https://t.co/2Wc3ImG0g7Externer Link#ISupportTimnitExterner Link #BelieveBlackWomenExterner Link

— Burak Emir (@burakemir) December 6, 2020Externer Link

Solidarität auch aus der Schweiz

Viele Forschende haben sich mit Timnit Gebru solidarisiert, darunter auch einige, die in der Schweiz leben und arbeiten. In Zürich befindet sich das grösste Forschungszentrum von Google ausserhalb der USA. Es beschäftigt sich unter anderem mit maschinellem Lernen und künstlicher Intelligenz.

Burak Emir ist einer von mehr als 2600 Mitarbeitenden des Unternehmens, die eine Petition zugunsten von Gebru unterzeichnet haben und den Umgang des Unternehmens mit der Abteilung für Ethik in der KI in Frage zu stellen.

Google bestreitet, dass Gebru habe «zensiert» werden sollen. Die Kommunikationsabteilung von Google Schweiz verweist auf Anfrage auf die offiziellen Stellungnahmen von Führungskräften des Unternehmens in diesem Fall. Eine dieser Aussagen stammte von Jeff Dean, dem Leiter von Google KI.

Seiner Meinung nach hat die von Gebru mitverfasste Forschungsarbeit nicht den internen Qualitätsanforderungen entsprochen. Das Unternehmen habe im Übrigen nicht ihr gekündigt, sondern sie habe gekündigt und das Unternehmen ihre Kündigung akzeptiert. Gebru hingegen behauptet, sie habe nie eine Kündigung eingereicht.

I understand the concern over Timnit’s resignation from Google. She’s done a great deal to move the field forward with her research. I wanted to share the email I sent to Google Research and some thoughts on our research process.https://t.co/djUGdYwNMbExterner Link

— Jeff Dean (@JeffDean) December 4, 2020Externer Link

I was fired by @JeffDeanExterner Link for my email to Brain women and Allies. My corp account has been cutoff. So I've been immediately fired 🙂

— Timnit Gebru (@timnitGebru) December 3, 2020Externer Link

Roberta Fischli von der Universität St. Gallen hat die Petition zur Unterstützung von Gebru ebenfalls unterzeichnet. Ihrer Meinung nach hat diese Affäre dem Image von Google innerhalb der Ethik- und KI-Gemeinschaft geschadet. Fischli glaubt, dass Interessenkonflikte unvermeidlich sind, wenn man in einem Forschungsprojekt bestehende Praktiken innerhalb eines Unternehmens in Frage stellt. Ihrer Meinung nach bestand von Anfang an ein gewisses Risiko.

«Theoretisch mögen die meisten Unternehmen kritische Forschende. Aber in der Praxis führt es ungewollt zu einem Interessenkonflikt, wenn diese beginnen, ihren eigenen Arbeitgeber zu kritisieren», sagt sie.

Fischli merkt zudem an, dass Forschende, die tiefgreifend zur KI-Ethik arbeiten wollen, oft keine grosse Wahl in Bezug auf einen Arbeitsplatz hätten. Sie landeten in privaten Unternehmen, weil dort die meisten Ressourcen vorhanden seien. «Dann versuchen sie, bestimmte Abläufe besser zu verstehen und diese von innen heraus zu verändern, was nicht immer gut geht.»

Der Web-Gigant Google hat nach der Entlassung von Timnit Gebru seine Geschäfte scheinbar ungestört weitergeführt, aber es scheint sich doch etwas zu tun. Eine Gruppe von Mitarbeitenden in den USA gründete im Januar die erste Gewerkschaft in der Geschichte eines grossen multinationalen Technologieunternehmens, die «Alphabet Workers Union». In der Folge gründeten Google-Mitarbeitende auf der ganzen Welt ein globales Gewerkschaftsbündnis in zehn Ländern, darunter Grossbritannien und die Schweiz.

Hard to understate the importance of this against the background of @timnitGebruExterner Link’s forced departure from #GoogleExterner Link’s AI Ethics team. Time to take ethics, diversity and labor law – and your own corporate slogan seriously, Google! #ISupportTimnitExterner Link https://t.co/H0AORkHKE0Externer Link

— Roberta Fischli (@leonieclaude) December 3, 2020Externer Link

Die Grenzen der Datenausbeutung

Doch der Einfluss von Google und der so genannten GAFA-Gruppe (Akronym für Google, Amazon, Facebook und Apple) reicht weit über die eigenen Büros hinaus. Was diese Tech-Giganten tun und planen, diktiert auch die globale akademische Forschungsagenda.

«Es ist schwer, in grossen akademischen Einrichtungen und Instituten Forschungsprojekte zu finden, die nicht mit grossen Tech-Unternehmen verbandelt sind oder sogar von ihnen finanziert werden», meint Alexandros Kalousis von der Fachhochschule Westschweiz.

Angesichts dieses Einflusses hält er es für entscheidend, dass es unabhängige und «unkonventionelle» Stimmen gibt, die auf die Gefahren der unkontrollierten Datenausbeutung durch die Tech-Giganten hinweisen.

«Das ist das grosse Problem in unserer Gesellschaft», sagt Kalousis. Diskussionen über Ethik könnten manchmal eine Ablenkung von dieser allgegenwärtigen Kontrolle durch die «Tech-Riesen» sein.

Aber kann die Forschung so unabhängig sein, wie sie sein sollte, um die Risiken eines grossflächigen Einsatzes von KI-Technologien objektiv aufzuzeigen und zu hinterfragen? Nicht wirklich, so scheint es.

Das Problem geht über Google hinaus und betrifft alle Unternehmen auf dem Markt, die KI-Systeme ohne Regeln und ohne Grenzen einsetzen. Für uns bedeutet das, dass die Technologie diktiert, was ethisch akzeptabel ist und was nicht. Und das prägt unser Leben und unsere Denkweise.

In Übereinstimmung mit den JTI-Standards

Diskutieren Sie mit!