L’ondata di disinformazione negli Stati Uniti mette in allarme la democrazia diretta svizzera

Gli Stati Uniti sono alle prese con un'ondata senza precedenti di contenuti falsi generati dall'intelligenza artificiale in vista delle elezioni presidenziali. Ma nemmeno la democrazia diretta svizzera ne è immune. Al contrario, il Paese alpino è vulnerabile di fronte alle stesse tattiche di disinformazione che minacciano l’elettorato di tutto il mondo.

“La Svizzera è molto vulnerabile perché se il popolo riceve informazioni sbagliate, probabilmente prenderà decisioni sbagliate”, sostiene Touradj Ebrahimi, professore al Politecnico federale di Losanna ed esperto di deepfake.

Perché ci concentriamo sulle “repubbliche sorelle” Svizzera e USA?

Il 5 novembre la popolazione statunitense voterà per un nuovo presidente o – per la prima volta – per una presidente donna.

Sia Kamala Harris che Donald Trump hanno dichiarato che si tratta di un’elezione fatidica per il futuro del sistema politico e della democrazia.

La Svizzera e gli Stati Uniti un tempo si sono plasmati a vicenda.

In questo momento, abbiamo analizzato la storia comune dei due Paesi e abbiamo visto come il passato fraterno continui ad avere un impatto sul presente.

L’esperto sostiene che le democrazie dirette, dove i cittadini e le cittadine hanno un ruolo di primo piano nella definizione delle decisioni politiche, saranno quelle che soffriranno di più a causa della disinformazione e dei contenuti falsi generati con l’aiuto dell’intelligenza artificiale (IA). Questo vale per la Svizzera e per la maggior parte degli Stati americani, dove non solo i rappresentanti eletti ma anche la cittadinanza prende decisioni importanti.

La campagna elettorale presidenziale in corso negli Stati Uniti dimostra quanto l’IA possa inquinare il dibattito politico. Nel corso dei mesi ne abbiamo viste e sentite di tutti i colori: immagini di Kamala Harris ritratta come una dittatriceCollegamento esterno a una convention comunista, messaggi audioCollegamento esterno con la voce di Joe Biden che chiede agli elettori e alle elettrici di non votare, video di Elon Musk e Donald Trump in abiti cool che ballano impeccabilmente su una musica anni ’70.

Questi sono solo alcuni dei deepfake – contenuti audiovisivi falsi generati con l’IA – che circolano online su piattaforme social come X (ex Twitter).

pic.twitter.com/CaH0yXMO0kCollegamento esterno

— Donald J. Trump (@realDonaldTrump) August 15, 2024Collegamento esterno

L’obiettivo è generare disinformazione e manipolare l’opinione pubblica con grande impatto e poco sforzo. Sono infatti milioni le persone che hanno visualizzato, dato un like e ripostato questi deepfake. La situazione è talmente preoccupante negli Stati Uniti che almeno 20 StatiCollegamento esterno hanno approvato norme contro i video e gli audio falsi, e il Dipartimento di sicurezza nazionale ha messo in guardiaCollegamento esterno dai rischi dell’IA per le elezioni presidenziali. Recentemente, lo stato della California ha firmato una delle leggi più severeCollegamento esterno d’America contro i deepfake politici.

La Svizzera, invece, è in ritardo nella legislazione. Mentre l’UE ha regolamentato i deepfakeCollegamento esterno nella legge europea sull’intelligenza artificiale, il Governo svizzero ha dichiaratoCollegamento esterno l’anno scorso di non ritenere necessaria una normativa specifica contro i contenuti generati e manipolati artificialmente.

Ma nonostante gli sforzi legislativi, né gli Stati Uniti né le più grandi democrazie del mondo sono state risparmiate da video, foto e notizie false nell’anno elettorale che ha portato il maggior numero di persone nella storia – almeno quattro miliardi – alle urne.

L’escalation della disinformazione generata dall’IA non ha ancora raggiunto il suo picco: in futuro vedremo sempre più contenuti “sintetici”, ovvero creati artificialmente, prevede Ebrahimi. E man mano che la tecnologia diventerà più sofisticata, sarà sempre più difficile distinguerli da ciò che è reale.

Gli esperti e le esperte con cui abbiamo parlato concordano nel ritenere che questi sono i tre motivi principali per cui la democrazia svizzera non dovrebbe sottovalutare il pericolo delle informazioni false alimentate dalla tecnologia:

1. I motori di ricerca e i chatbot mostrano informazioni distorte e non corrette

Organizzazioni non profit e gruppi di ricerca hanno già messo in guardia dai pericoli e dai limiti dei software e degli algoritmi di IA per la democrazia svizzera. L’ONG svizzera Algorithm Watch CH ha analizzatoCollegamento esterno le risposte del Chatbot di Microsoft all’interno del motore di ricerca Bing prima delle elezioni federali svizzere dell’ottobre 2023. L’organizzazione ha scoperto che un terzo delle risposte relative alle elezioni conteneva errori fattuali e che l’IA era arrivata persino a inventare scandaliCollegamento esterno su alcune personalità politiche.

“I chatbot di IA generativa integrati nei motori di ricerca possono essere fuorvianti, perché le persone fanno affidamento sulle informazioni raccolte attraverso questi browser”, afferma Angela Müller, direttrice di Algorithm Watch CH.

Ma anche i motori di ricerca sul web possono essere ingannevoli. Un libro biancoCollegamento esterno pubblicato dalle università di Berna e Zurigo ha rilevato che il motore di ricerca più utilizzato in Svizzera, Google, dà visibilità in maniera diseguale a certe fonti di informazione e punti di vista più o meno critici su un argomento a seconda della lingua di ricerca (tedesco, francese o italiano).

Prima della votazione popolare sulla legge per la protezione del clima del giugno 2023, ad esempio, i ricercatori e le ricercatrici hanno riscontrato che Google ha privilegiato le informazioni provenienti da partiti più critici nei confronti della legge in risposta alle ricerche in lingua tedesca rispetto a quelle in italiano e francese.

“In una democrazia multilingue già polarizzata come la Svizzera, questi risultati dovrebbero preoccuparci”, afferma Mykola Makhortykh, uno dei ricercatori autori del libro bianco. Makhortykh lancia l’allarme sul fatto che non ci sia trasparenza sul funzionamento degli algoritmi di ricerca e dei software di intelligenza artificiale e che, nonostante le promesse, le grandi aziende tecnologiche non riescano a creare sistemi efficaci per combattere le fake news e la polarizzazione.

2. La disinformazione generata dall’IA sta rendendo il panorama mediatico meno affidabile

Secondo Makhortykh, gli attuali sistemi di IA consentono anche di creare e diffondere la disinformazione in modo più rapido e semplice. Sempre più siti di notizie imitano media autorevoliCollegamento esterno o tradizionali, ma in realtà sono pieni di contenuti generati automaticamente dall’IA, spesso errati e talvolta completamente inventati.

Tali notizie riempiono le pagine delle principali piattaforme di social media, che sono responsabili di oltre il 60% della disinformazione che circola in Svizzera secondo un sondaggioCollegamento esterno condotto dal fög.

Anche se solo una piccola parteCollegamento esterno della popolazione legge le notizie generate dall’intelligenza artificiale, queste possono essere così ben fatte che per le persone è più difficile identificarle ed evitare le fake news. Una recente indagine dell’OCSE ha classificato le svizzere e gli svizzeri tra i meno capaci di riconoscere la disinformazione.

“Se le news generate da giornalisti in carne e ossa e dall’IA si somigliano, è davvero pericoloso”, afferma Karsten Donnay, professore di comportamento politico e media digitali all’Università di Zurigo. Le persone potrebbero sentirsi ingannate e perdere fiducia nel sistema mediatico nel suo complesso, aggiunge.

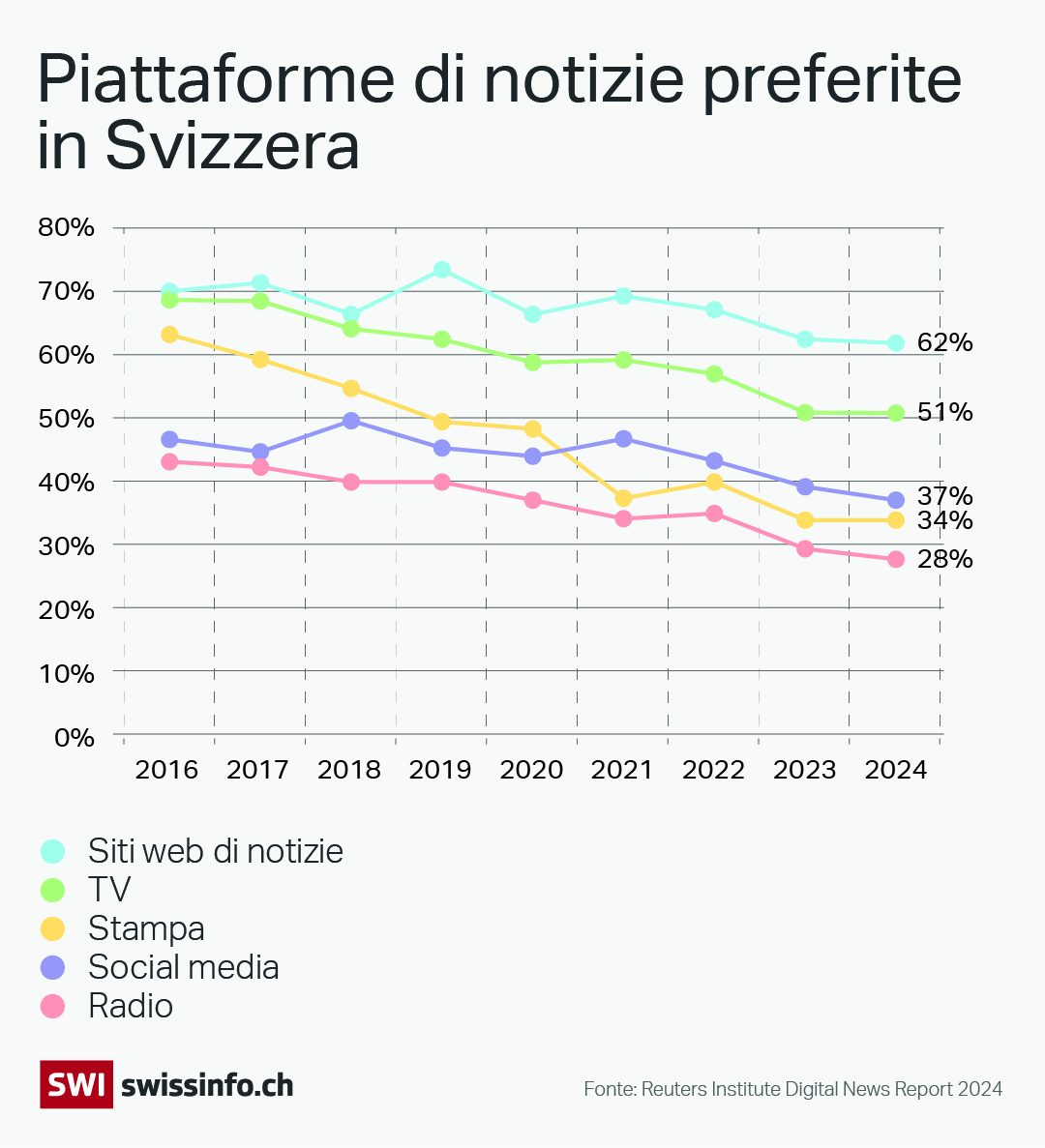

Questo ecosistema ha già portato la popolazione svizzera a cambiare il modo in cui si informa. Gli ultimi dati pubblicati nel Reuters Digital News ReportCollegamento esterno mostrano che la principale fonte di informazione del Paese sono i siti di notizie online. I canali tradizionali e più affidabili come la televisione, la carta stampata e la radio rimangono importanti, ma dal 2016 hanno subito un calo significativo.

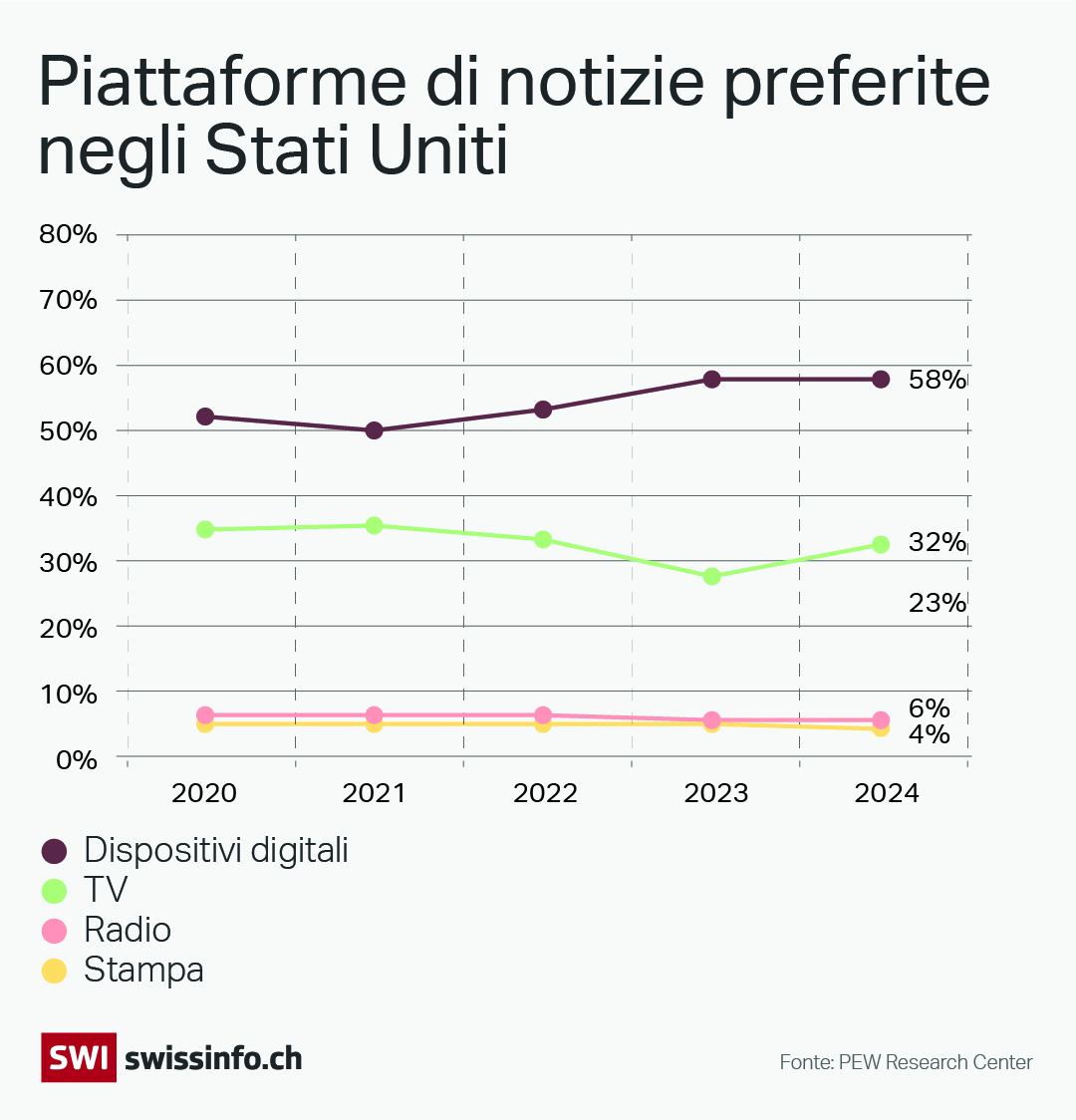

Uno dei motivi è che le persone sono bombardate da notizie e si sentono esauste, si legge nel rapporto. Di conseguenza, gli svizzeri e le svizzere sono sempre meno interessati a essere informati, il che fa parte di una tendenza globale. La Svizzera, tuttavia, ha registrato un cambiamento meno estremo rispetto ad altre democrazie, come gli Stati Uniti, dove la popolazione è quasi sul punto di abbandonare le piattaforme mediatiche tradizionali.

Ma questo non rende più probabile che la Svizzera riesca a minimizzare i rischi dell’IA, dice Donnay. Il professore ritiene che i motori di ricerca e i chatbot continueranno a guadagnare terreno come fonti di informazione.

“Le persone li useranno sempre di più e non sappiamo davvero dove questo porterà”, sottolinea. Tuttavia, Donnay ritiene che non sia troppo tardi per mettere dei paletti, in modo da garantire che anche le fonti di informazione non giornalistiche rispettino determinati standard.

3. Le tecnologie di IA generativa sono incredibilmente persuasive

Finora è stato difficile dimostrare l’effetto della disinformazione generata dall’IA sulla popolazione.

“Non si tratta di un fenomeno di massa. La disinformazione circola in una nicchia”, afferma Fabrizio Gilardi, professore di analisi politica all’Università di Zurigo. Gilardi asserisce che la disinformazione è sempre esistita e le ricerche più importanti dimostrano che ha un’influenza molto minore di quanto si pensi. “L’intelligenza artificiale non cambierà la situazione in modo sostanziale”, afferma.

Studi indipendentiCollegamento esterno condotti in collaborazione con Meta (la società madre di Facebook) durante le elezioni presidenziali statunitensi del 2020 hanno dimostrato che la disinformazione che circolava sui social media non ha avuto effetti significativi sulle attitudini e sui comportamenti delle persone e non ha aumentato la polarizzazione.

Ma la situazione potrebbe cambiare con l’avvento di piattaforme interattive di intelligenza artificiale come ChatGPT. Una ricercaCollegamento esterno effettuata negli Stati Uniti su circa 900 persone dal Politecnico federale di Losanna ha dimostrato che ChatGPT è molto abile nel plasmare le nostre opinioni.

“La capacità persuasiva dei modelli di intelligenza artificiale generativa è così elevata che potrebbero influenzare le elezioni”, afferma Francesco Salvi, uno degli autori dello studio. Salvi e il suo team hanno dimostrato che ChatGPT-4 ha l’82% di probabilità in più rispetto a un essere umano di far cambiare idea a una persona.

Quando è in possesso di informazioni personali su un utente, ChatGPT-4 può generare messaggi personalizzati e più persuasivi. Si tratta di un fenomeno senza precedenti, anche tenendo conto di altri casi celebri di disinformazione, come quello di Cambridge Analytica, che nel 2018 usò illegalmente i dati personali di milioni di utenti di Facebook per influenzarli politicamente.

“Siamo di fronte a un potenziale caso Cambridge Analytica all’ennesima potenza. E sono convinto che stia già accadendo”, sostiene Salvi.

A cura di Benjamin von Wyl e Veronica De Vore

In conformità con gli standard di JTI

Altri sviluppi: SWI swissinfo.ch certificato dalla Journalism Trust Initiative

Potete trovare una panoramica delle discussioni in corso con i nostri giornalisti qui.

Se volete iniziare una discussione su un argomento sollevato in questo articolo o volete segnalare errori fattuali, inviateci un'e-mail all'indirizzo italian@swissinfo.ch.