Intelligenza artificiale e democrazia diretta: una convivenza è possibile?

Alcune persone considerano l'intelligenza artificiale un pericolo per la democrazia, altre la ritengono una grande opportunità. Ricercatori ed esperte spiegano l'uso di algoritmi e big data in Svizzera.

Ogni tre mesi in Svizzera si vota. Prima degli appuntamenti alle urne i dibattiti sono accesi, soprattutto su internet i toni diventano talvolta molto aspri. Le offese, le espressioni di odio e persino le minacce di morte non sono una rarità. È un problema per la democrazia, osserva Sophie Achermann, direttrice di Alliance F, la più grande organizzazione femminile svizzera.

“È importante avere delle discussioni dure ma oggettive. L’odio su internet però impedisce la pluralità di opinioni”, afferma Achermann. “Le persone hanno paura dei messaggi di odio e preferiscono non esprimersi.” Prima della votazione sulle iniziative popolari sui pesticidi e sull’acqua potabile, per esempio, alcune politiche hanno ricevuto un tale numero di minacce da non voler più esprimersi pubblicamente, osserva. Non si tratta certo di un fenomeno esclusivamente svizzero: sempre più spesso politiche e politici in tutto il mondo sono insultati e minacciati online. DonneCollegamento esterno e minoranze sono prese di mira in modo particolare.

Per questo Alliance F ha sviluppato un algoritmo contro i messaggi che incitano all’odio. L’algoritmo si chiama Bot DogCollegamento esterno, perché funziona come un segugio che cerca i discorsi offensivi e violenti e segnala i relativi post. Un gruppo di volontari e volontarie risponde poi a ogni singolo messaggio. L’idea è che l’odio in rete non debba rimanere senza risposta e che la discussione possa essere riportata su binari oggettivi.

Bot Dog si trova ancora in una fase sperimentale. I primi test sono incoraggianti: ricercatrici e ricercatori del Politecnico federale (ETH) e dell’Università di Zurigo hanno seguito il progetto pilota e hanno constatato che le risposte hanno successo soprattutto quando fanno appello alla solidarietà emotiva con le vittime dei messaggi di odio. Frasi come “il vostro post è molto doloroso per le ebree e gli ebrei” hanno indotto gli autori di espressioni d’odio a scusarsi e a cancellare i messaggi.

Bot Dog sarà messo online ufficialmente in luglio. Chiunque abbia voglia può partecipare al progetto, dice Achermann, valutando i commenti e aiutando così l’algoritmo a distinguere meglio i commenti offensivi e violenti, oppure rispondendo ai messaggi d’odio.

Collaborazione tra esseri umani e algoritmi

Bot Dog è solo un esempio di come l’intelligenza artificiale (IA) possa contribuire a irrobustire la democrazia. Dirk Helbing, professore di Computational Social Sciences del Politecnico di Zurigo, è convinto dell’immenso potenziale della democrazia digitale. Pensa ai bilanci partecipativi, in cui le cittadine e i cittadini decidono insieme come debba essere speso il budget della loro città o del loro comune.

Nel quartiere zurighese di Wipkingen questa possibilità è già stata sperimentata. La popolazione ha optato per orti urbani, uno skatepark e un festival del cibo di strada. Ogni progetto è sostenuto dall’erario pubblico con 40’000 franchi.

“Le persone hanno paura dei messaggi di odio e preferiscono non esprimersi.”

Sophie Achermann, Alliance F

Altra idea per la democrazia digitale: città e regioni di tutto il mondo si potrebbero mettere in rete e competere per le migliori soluzioni nell’ambito dell’economia sostenibile, della riduzione del CO2 o della convivenza pacifica. Una specie di olimpiade delle città, insomma. I progetti e i relativi dati sarebbero liberamente accessibili e potrebbero fornire la base per modelli di IA.

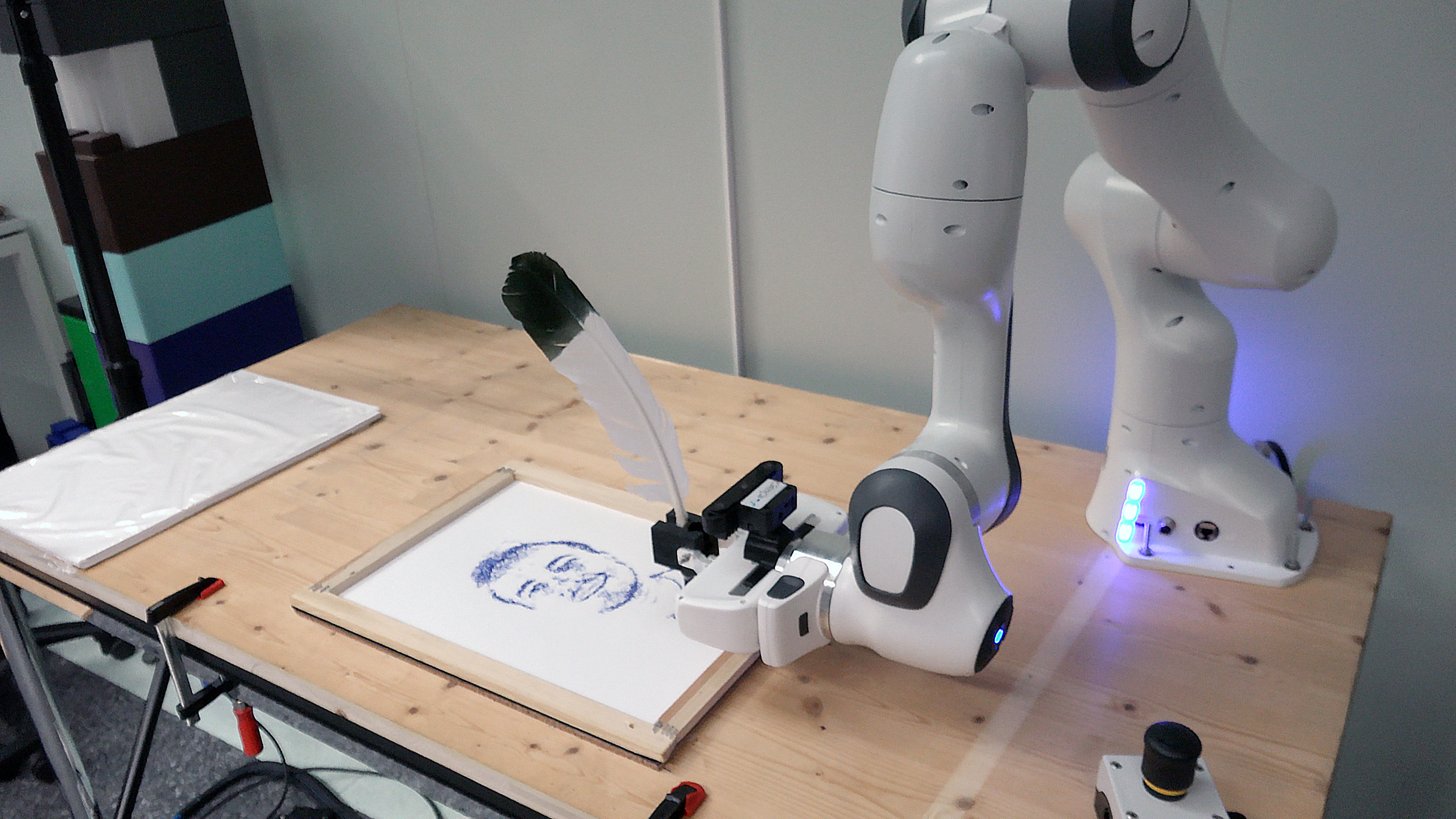

“Credo che andiamo verso una sorta di società della partecipazione digitale”, dice Helbing, imperniata su una collaborazione tra esseri umani e IA. Come nel caso di Bot Dog, dove un algoritmo e persone volontarie lottano insieme contro l’odio in rete.

Il potenziale dell’IA per la democrazia diretta sarebbe immenso. Ma applicazioni che ricorrono solo all’utilizzo di grandi quantità di dati “sono anche potenzialmente distruttive per le forme di società basate sulla democrazia, sullo stato di diritto e sui diritti umani”, ammonisce Helbing.

Non tutto positivo

Il problema è che gli algoritmi decidono sempre più spesso quali informazioni riceviamo, quali prodotti ci vengono mostrati e quale prezzo siamo tenuti a pagare. Determinano ciò che vediamo del mondo e quali problemi consideriamo importanti. In questo modo anche le nostre opinioni politiche e il nostro comportamento elettorale sono soggetti a influenza, aggiunge Helbing.

È il caso della campagna elettorale di Donald Trump per le presidenziali statunitensi nel 2016, quando il suo team ha fatto ampio uso di algoritmi basati sui big data per far arrivare contenuti personalizzati al suo pubblico target. “Li abbiamo bombardati con blog, pagine web, articoli, video, pubblicità finché hanno cominciato a vedere il mondo nel modo che volevamo noi. E hanno votato i nostri candidati”, rivela Brittany Kaiser nel documentario di Netflix The Great Hack, dedicato al suo lavoro durante la campagna.

Kaiser lavorava per l’azienda Cambridge Analytica, la quale prima delle elezioni presidenziali negli Stati Uniti si è impadronita dei dati privati di 87 milioni di profili Facebook, dando vita a uno dei più grandi scandali legati all’uso di dati.

Altri sviluppi

La macchina e la morale

Anche durante la seconda campagna presidenziale di Barack Obama nel 2012 l’elettorato è stato contattato in modo mirato. Il team di Obama ha raccolto più dati possibile e ha inviato a ogni elettore ed elettrice un messaggio personalizzato.

È però difficile affermare con sicurezza in che misura questi metodi basati sull’IA abbiano influito sul risultato dei candidati. Helbing e i suoi colleghiCollegamento esterno considerano tuttavia questo approccio alle campagne elettorali un grande pericolo. Soprattutto la combinazione tra approccio personalizzato e forme sottili di incitamento (nudging) improntati su un ampio uso di dati relativi al nostro comportamento, ai nostri sentimenti e ai nostri interessi potrebbero condurre a esiti totalitari, mette in guardia Helbing. Nudging è un concetto mutuato dalla psicologia e indica l’uso di strumenti che animano le persone a fare certe cose e le spingono in una determinata direzione.

Campagne elettorali basate sull’IA in Svizzera

Un’intelligenza artificiale ha bisogno soprattutto di una cosa: i dati. E più ne ha, meglio funziona. In Svizzera la protezione dei dati e la sfera privata sono un bene prezioso. Sarebbe possibile applicare i metodi statunitensi a una campagna elettorale elvetica? I partiti svizzeri potrebbero rivolgersi alle elettrici e agli elettori utilizzando il metodo del cosiddetto microtargeting?

Lucas Leemann, che all’Università di Zurigo si occupa tra le altre cose di come misurare l’opinione pubblica attraverso sistemi di apprendimento automatico (machine learning), pensa di no. In Svizzera la situazione non è a suo avviso paragonabile a quella statunitense. Ciò dipende anche dal fatto che dati grezzi paragonabili a quelli usati nelle campagne di Trump e Obama in Svizzera non ci sono. “Avevano a disposizione dati per quasi ogni cittadina e ogni cittadino degli USA. In Svizzera le cose stanno in modo completamente diverso”, sostiene.

Durante i suoi studi Leemann ha lavorato brevemente per un’azienda di moda negli Stati Uniti. In quella funzione non solo aveva accesso alla banca dati con nome, indirizzo e data di nascita dei e delle clienti, ma poteva anche ottenere informazioni sul loro reddito annuo stimato e sul numero dei loro figli e scoprire che automobile guidavano e se vivevano in affitto o erano proprietari della loro abitazione.

“Negli USA questi dati si possono semplicemente comprare e vengono utilizzati anche per scopi politici. In Svizzera dati simili, per quanto ne so, non vengono utilizzati per campagne politiche o perlomeno non è ancora il caso”, dice.

L’accento è posto sul “non ancora”? Presto anche in Svizzera si potrà comprare questo tipo di dati? Secondo il professor Helbing del Politecnico di Zurigo la riduzione del mondo in forma di dati è molto più avanzata di quanto la maggior parte delle persone pensi.

Come esempio cita il Center for Cybersecurity del Forum economico mondiale (WEF), con sede a Ginevra, a cui partecipano aziende di tutto il mondo, tra cui Amazon, MasterCard e Huawei Technologies. In quel contesto viene raccolto un numero “estremamente alto di dati”, afferma Helbing. I dati sono utilizzati con la benedizione delle Nazioni Unite, per mettere in pratica tra le altre cose l’Agenda 2030 sullo sviluppo sostenibile.

“Sarà anche per uno scopo condivisibile, ma ci si può chiedere come sia perseguito e quali altri applicazioni siano possibili a partire dagli stessi dati”, osserva Helbing. “Poiché sono coinvolte così tante aziende, c’è il rischio che gli interessi commerciali prevalgano su quelli sociali”.

Più trasparenza

Per evitare che l’IA diventi un pericolo per la democrazia, occorre sviluppare rapidamente leggi e regolamenti, ammoniscono esperti ed esperte.

Ma per elaborare regole efficaci bisogna sapere come funzionano esattamente gli algoritmi. E qui casca l’asino. Piattaforme come Facebook sono un buco nero, dice Anna Mätzener, direttrice di AlgorithmWatch Svizzera. “Non conosciamo nel dettaglio il modo di lavorare degli algoritmi. Non sappiamo neppure esattamente quali dati vengano raccolti.”

L’IA che cura i contenuti sulle reti sociali è un segreto ben custodito. Per scoprire l’effetto dell’algoritmo sulle campagne elettorali AlgorithmWath ha lanciato insieme al quotidiano tedesco Süddeutsche Zeitung un progetto di ricercaCollegamento esterno. Hanno chiesto a centinaia di volontari di fornire dati sulla timeline del loro conto Instagram prima delle elezioni politiche tedesche del 2021. I volontari dovevano abbonare profili di tutti i partiti. Un plug-in registrava la comparsa di questi profili nei loro newsfeed e inviava i risultati a AlgorithmWatch.

L’analisi ha dimostrato che i contenuti del partito di destra radicale Alternative für Deutschland (AfD) finivano molto più in alto nei newsfeed di quelle degli altri partiti. La ricerca non ha però potuto stabilire perché.

Meta (ex Facebook), a cui appartiene anche Instagram, non ha apprezzato la ricerca. L’azienda ha minacciato AlgorithmWatch di “avviare misure più formali” nel caso in cui il progetto non fosse abbandonato. L’analisi dei dati è stata interrotta di conseguenza prima del previsto.

“Finché questo tipo di ricerche non è possibile, non possiamo fare affermazioni fondate sull’influsso dei contenuti delle piattaforme curati dall’IA sulla società e in particolare sulla formazione dell’opinione politica e quindi sulla democrazia”, nota Mätzener.

Altri sviluppi

Traduzione dal tedesco: Andrea Tognina

In conformità con gli standard di JTI

Altri sviluppi: SWI swissinfo.ch certificato dalla Journalism Trust Initiative

Potete trovare una panoramica delle discussioni in corso con i nostri giornalisti qui.

Se volete iniziare una discussione su un argomento sollevato in questo articolo o volete segnalare errori fattuali, inviateci un'e-mail all'indirizzo italian@swissinfo.ch.