Как феномен ChatGPT ставит нас в тупик

Интуитивная программа ChatGPT уже наделала паники в рядах журналистов, программистов и учителей средних школ. Звучат знакомые опасения, мол, через 20 лет не будет ничего и будет одно «сплошное телевидение», то есть один сплошной искусственный интеллект. Да, этот новый инструмент значительно облегчает сетевой поиск и анализ найденного в интернете материала. Но человек все равно остается в центре всего, хотя ясно, что кое-какие привычные алгоритмы и структуры повседневности придется поменять.

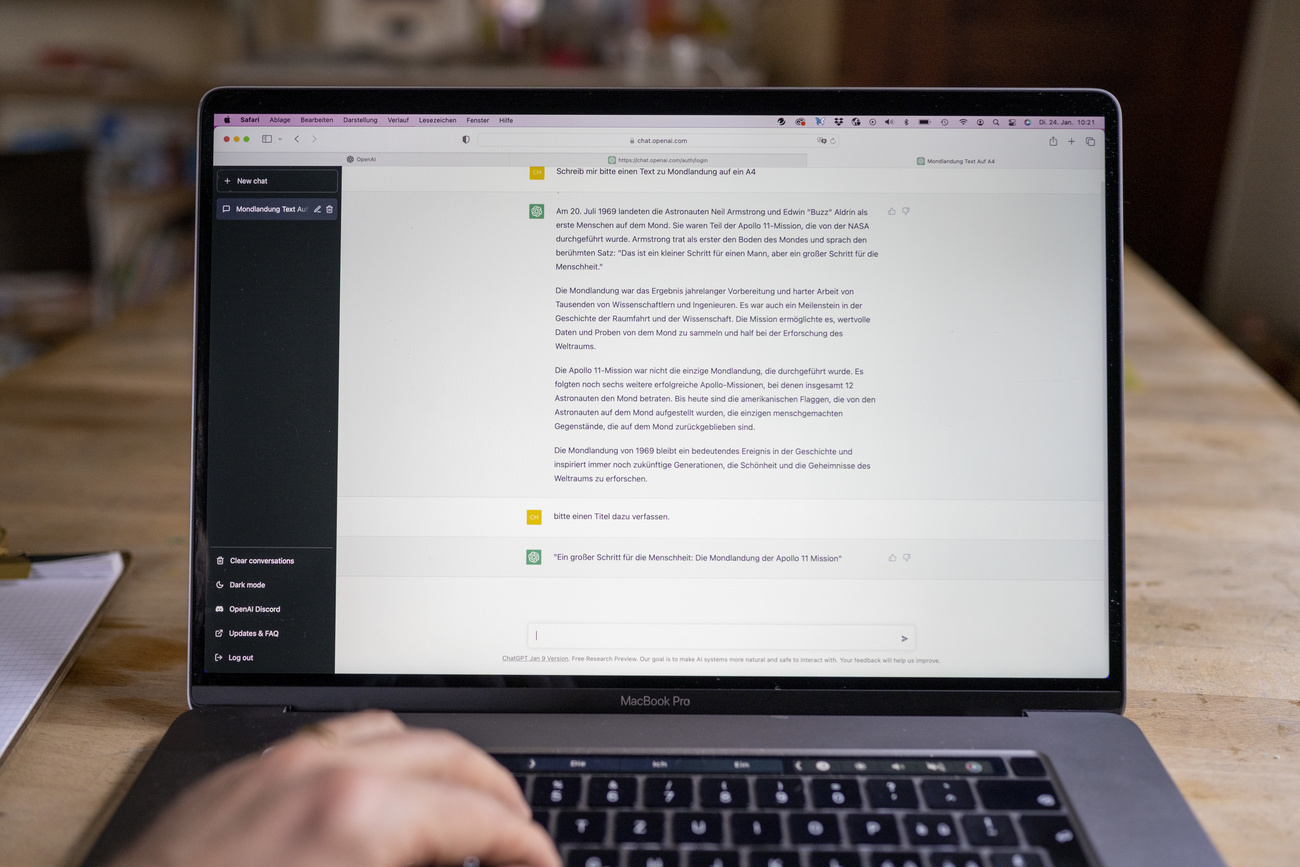

У него уже есть вроде бы ответы на все вопросы, он может написать вам книгу, разработать программный код или даже написать стихотворение в стиле Бориса Пастернака (насколько талантливы такие стихи, судите сами — см. ниже). Придуманная компанией OpenAI программа, по мнению многих, ознаменовала собой приход эры искусственного интеллекта (ИИ) на массовый рынок, хотя до потенциала человеческого мозга ей еще очень далеко.

Unsurprisingly, after the pre-mature release of #ChatGPTВнешняя ссылка, and the race to the bottom in terms of safety caused by Microsoft, Google or Facebook, GPT-4 is out.

— El Mahdi El Mhamdi | mastodon.social/@elmahdi (@L_badikho) March 14, 2023Внешняя ссылка

It claims to "solve" a physics @polytechniqueВнешняя ссылка entry exam. This will make it harder to calm down the hype in France… pic.twitter.com/dG47v4Rr8NВнешняя ссылка

А пока вокруг чат-бота ChatGPT начался настоящий хайп. В последние четыре месяца швейцарские печатные СМИ посвящали ему в среднем 10 статей в день (если верить информации швейцарского банка данных smd.ch). А если добавить сюда радио, телевидение, онлайн-СМИ и социальные сети, то можно сказать, что редко какой продукт получает такую стартовую рекламную кампанию — причем совершенно бесплатно. Комментарии и оценки лихорадочно кидаются из одной крайности в другую: для одних это провозвестник будущего, другие указывают на все те ляпы и глупости, которые допускает (пока?) эта программа.

Показать больше

Искусственный интеллект и «три закона роботехники» из Швейцарии

Тут же появились и новые луддиты: 29 марта 2023 года примерно одна тысяча экспертов из сферы высоких технологий обратилась к компаниям и правительствам мира с просьбой заморозить разработку этого формата ИИ на шесть месяцев, ссылаясь на «серьезные риски для человечества». Среди них были Стив Возняк, один из основателей компании Apple, и даже Элон Маск, один из инвесторов компании OpenAI, разработавшей ChatGPT. Буквально через три дня в Италии было принято решение заблокировать доступ сайту чат-бота, 27 марта 2023 года Европол, европейское агентство уголовной полиции, в своем отчете выразило обеспокоенность по поводу возможного использования потенциала ChatGPT киберпреступниками, а в России из-за ее агрессии ChatGPT в принципе недоступен.

Показать больше

«Искусственный интеллект не убережет банки от недальновидных шагов»

Но насколько в самом деле этот чат-бот опасен для нас? На первый взгляд, ничего нового тут нет. С голосовыми ассистентами Siri, Cortana или OK Google мы все уже знакомы. Его до предела простой интерфейс и манера общаться в тоне сдержанной вежливости не обещают никаких проблем. Но для начала нам нужно все-таки рассмотреть, что представляет собой эта машина и прежде всего чем она не является.

Электронный мозг? Вовсе нет!

Когда его спрашивают напрямую о том, что есть такое ChatGPT, то этот чат-бот отвечает совершенно честно: это есть всего лишь «большая языковая модель, разработанная компанией OpenAI на основе архитектуры Generative Pre-trained Transformer. Она обучена на огромном количестве текстовых данных понимать естественный язык и генерировать связные ответы на заданные вопросы или темы. ChatGPT может использоваться в различных задачах обработки естественного языка, таких как генерация текста, ответ на вопросы, автоматический перевод и многие другие» (курсивом даны оригинальные ответы самой программы с минимальной стилистической правкой).

Показать больше

Правительства и бизнес не остановят гонку за ИИ

В ответ на вопрос, чем эта программа отличается от человеческого мозга, программа поясняет, что «ChatGPT может обрабатывать информацию гораздо быстрее, чем человеческий мозг, будучи в состоянии хранить и использовать большие объемы данных. Однако мозг человека способен на значительно большее количество задач и видов деятельности, необходимых для жизнедеятельности и адаптации в реальном мире. Программа ChatGPT не обладает сознанием и эмоциями, в отличие от человеческого мозга. Человек может чувствовать, мыслить, анализировать и принимать решения, основанные на личных убеждениях и опыте, что не доступно для компьютера».

Показать больше

Искусственный разум и новые экологичные источники энергии

То есть эмоционального интеллекта, самосознания, вдохновения, творческого мышления и способности принимать самостоятельные решения у программы нет, а все по одной простой причине: архитектура искусственного интеллекта не имеет ничего общего с архитектурой мозга. Именно об этом, по сути, и говорится в написанной Джеффом Хокинсом в соавторстве с Сандрой Блейксли в 2005 году книге On intelligence (Times Books, Henry Holt and Co. ISBN 0-8050-7456-2). Если кто не знает: американский компьютерный инженер Джефф Хокинс является изобретателем концепции некогда знаменитых карманных компьютеров и коммуникаторов под управлением операционной системы Palm OS, предвестников нынешних смартфонов.

Сейчас он работает в области нейробиологи и возглавляет компанию Numenta, занимающуюся разработкой искусственного интеллекта. Одна из ключевых идей данной книги заключается в том, что мозг человека создает своего рода хранилища информации, сотни тысяч «регистрационных карточек», которые постоянно перезаписывают и актуализируют свои данные на основании новых вводных, получаемых посредством органов чувств. А вот ИИ не имеет ни глаз, ни ушей, и питается он только предоставленными ему данными, которые остаются фиксированными и не развиваются. Все решения и варианты ответов, которые дает ИИ, являются результатом вероятностной оценки с учетом имеющихся больших объемов данных.

Он даже не знает, что такое кошка

Джефф Хокинс иллюстрирует свои выкладки очень простыми примерами. Например, ИИ, который маркирует изображения, способен распознать кошку. Но он не знает, что это животное, что у него есть хвост, ноги и легкие, что некоторые люди предпочитают кошек собакам, или что кошка мурлычет, или что она может линять. Другими словами, машина знает о кошках гораздо меньше, чем пятилетний ребенок. Почему? Потому что ребенок уже видел в своей жизни реальную кошку, он гладил ее, слышал, как она мурлычет, и вся эта информация обогатила «карту кошки» в его мозгу.

Показать больше

ИИ выходит из-под (демократического) контроля

А что делает ChatGPT? Он полагается исключительно на наборы слов и на вероятность того, что одни слова обычно чаще встречаются рядом друг с другом, чем другие. Все это более 70 лет назад было предсказано еще Аланом Тьюрингом, великим британским математиком, заложившим основы компьютерной науки. В 1950 году в статье «Вычислительные машины и разумВнешняя ссылка» Алан Тьюринг указал, что если мы хотим создать машину, которая способна мыслить, то совершенно недостаточно будет запрограммировать ее на то, чтобы она делала выводы из больших массивов данных. Чтобы действительно заслужить свое название, то есть стать хоть и искусственным, но интеллектом, программа должна получить способность рассуждать с помощью метода индукции, т.е. приходить к общему, отталкиваясь от конкретного частного случая. А вот до этого нам еще очень и очень далеко.

Рашид Геррауи (Rachid GuerraouiВнешняя ссылка) возглавляет лабораторию распределенных вычислений в Швейцарском федеральном технологическом институте в Лозанне (EPFL). «Распределенные вычисления» — это проблематика, связанная с проблемой объединения нескольких компьютеров для решения одной общей проблемы. Вместе со своим коллегой Ле Нгуен Хоангом, который ведет на платформе Youtube франкоязычный канал Science4AllВнешняя ссылка, он опубликовал в 2020 году монографию «Тьюринг на пляже — ИИ в шезлонгеВнешняя ссылка», обещая, что после ее прочтения «вы больше никогда не будете смотреть на компьютер по-старому».

С точки зрения Рашида Геррауи, одним из основных рисков, связанных с ChatGPT, является «излишняя самоуверенность. По большей части всё то, что, что он говорит, является правдой, или, по крайней мере, это так хорошо написано, что звучит абсолютно правдиво. Но он также регулярно совершает очень значительные ошибки. Поэтому не стоит слепо полагаться только на программу. К сожалению, не у всех у нас есть навыки критического мышления, которые позволяют подвергать сомнению то, что говорит машина — особенно когда она говорит это четко, без орфографических и грамматических ошибок. Еще одна опасность, которую я вижу, заключается в том, что эта технология как бы снимает в людей ответственность. Однако вопрос остается: кто является источником информации, полученной от чат-бота, кто несет за неё ответственность? Пока это не совсем ясно».

Показать больше

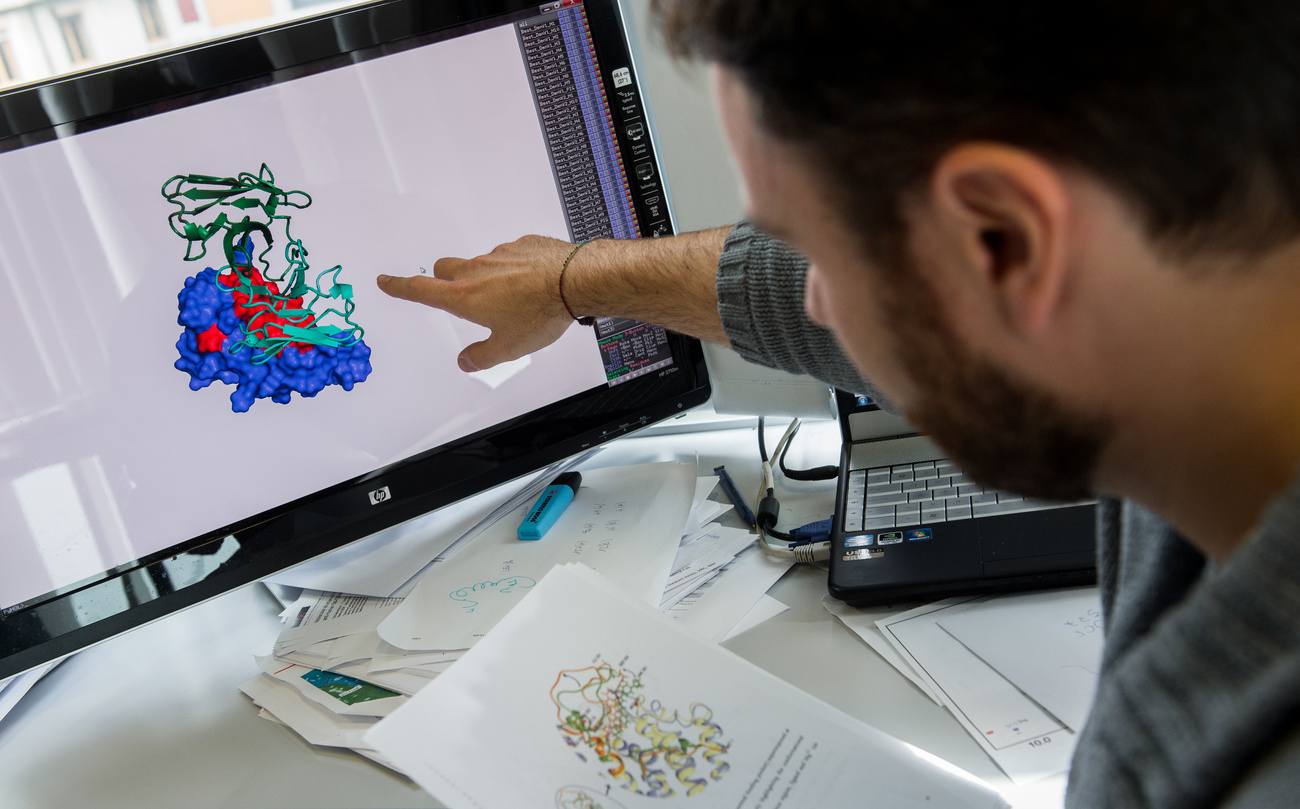

Как искусственный интеллект помогает создавать вакцины

Заменит ли ChatGPT журналистов, писателей и даже учителей? «Пока нет, но некоторые профессии могут сильно измениться. Учитель или журналист все равно будет отвечать, только теперь уже за перепроверку и перекрестную проверку источников, потому что машина будет выдавать текст, который выглядит правдоподобно, и в большинстве случаев все это будет соответствовать действительности. Но нам все равно придется все проверять и перепроверять по десять раз».

Как нам отрегулировать ИИ?

«Проблемой применительно к ИИ является не его производительность, а вопросы управления, менеджмента, правового регулирования и перепроверки результатов», — утверждает Эль Махди Эль Мхамди, бывший докторант EPFL, а ныне профессор математики и информатики в Политехническом институте Парижа. Этот вуз (фр. École Polytechnique) является учебным заведением по подготовке инженеров, был основан французскими учёными Гаспаром Монжем и Лазаром Карно в 1794 году.

Показать больше

Контакты без касаний: как искусственный интеллект создает новую реальность

В 2019 году Эль Махди Эль Мхамди опубликовал — также вместе с Ле Нгуен Хоангом — монографию Le fabuleux chantier — rendre l’intelligence artificielle robustement bénéfique («Страна чудес, или Как заставить искусственный интеллект работать на вас», перевод заголовка наш, — прим. ред.), в которой, в частности, рассматриваются опасности, связанные с так называемыми рекомендательными алгоритмами, позволяющими социальным сетям предлагать контент, который должен якобы заинтересовать Вас в соответствии с Вашим профилем. С точки зрения Эль Мхамди, влияние этих алгоритмов на процесс возникновения «информационного хаоса» еще предстоит оценить по достоинству.

Чат бот ChatGPT не делает никакого различия между описанием полета ласточек над полем тюльпанов и педофилией. Для него все эти ситуации являются просто информацией, поэтому разработчики ИИ должны научить машину, у которой нет ценностей, совести или морали, распознавать, что допустимо, а что нет. В январе 2023 года американский журнал Time рассказал о том, как компания OpenAI передала эту проблему на аутсорсинг калифорнийской компании Sama, которая сама в свою очередь решала задачу маркировки всего того, на что бывает способен человек, включая изнасилования, пытки, зоофилию и педофилию, на базе своего филиала в Найроби.

Сотрудники занимались этим всего за два доллара в час, и понятно, что не сойти от этого с ума было очень сложно. Компания Sama предоставила своим кенийским сотрудникам психологическую поддержку, но, по словам некоторых из них, согласившихся поговорить с журналом Time на условиях анонимности, предпринятых шагов было далеко недостаточно. Затем контракт между OpenAI и Sama был расторгнут, а сам ChatGPT, когда его напрямик спрашивают об этом не самом гламурном сюжете, начинает упорно уходить от ответа: «извините, но как языковая модель, я не имею доступа…, я не в состоянии…, я не могу предоставить информацию…, у меня нет возможности…».

«По моему мнению, ChatGPT не только переоценен с точки зрения рынка. Его раннее и быстрое превращение в общедоступный инструмент безответственно и опасно. Когда я вижу, с каким безоговорочным энтузиазмом люди берут его в свои руки, я задаюсь вопросом, чему мы научились со времен скандалов, связанных, например с массовым сбором частных данных компанией Cambridge Analytica или с распространением шпионских программ типа Pegasus».

Эль Мхамди признает, что ChatGPT может быть очень хорошим рабочим инструментом, но указывает, что все то, что лежит в его основе, «является результатом достижений тысяч ученых за последнее десятилетие, а также огромных инженерных ресурсов, не говоря уже о дешевом труде малооплачиваемых кенийцев. Истинный гений компании OpenAI заключается не в научных основах, на которые опирается ChatGPT, а в удачном маркетинге, делегированном самой аудитории». И в самом деле: видели ли Вы когда-нибудь или где-нибудь рекламу ChatGPT?

Читайте дальше:

Показать больше

Как программа ChatGPT пришла в школы и вузы Швейцарии

В соответствии со стандартами JTI

Показать больше: Сертификат по нормам JTI для портала SWI swissinfo.ch

Обзор текущих дебатов с нашими журналистами можно найти здесь. Пожалуйста, присоединяйтесь к нам!

Если вы хотите начать разговор на тему, поднятую в этой статье, или хотите сообщить о фактических ошибках, напишите нам по адресу russian@swissinfo.ch.