Google и вопросы этики: история одного увольнения

Недавнее наделавшее много шума в прессе увольнение компанией Google своего эксперта по этике заставляет задаться вопросом о том, какое место вопросы этики вообще занимают в списке приоритетов крупнейшей в мире IT-компании. И насколько этот вопрос отвлекает нас от настоящих, а не выдуманных, проблем.

Подготовка к публикации на русском языке: Надежда Капоне, Игорь Петров.

Технологические гиганты, такие как Google, не в полной мере осознают то, какой властью обладают или скоро будут обладать (само)обучаемые системы «искусственного интеллекта» (ИИ). По крайней мере, так считают ученые и эксперты в Швейцарии, непосредственно работающие в этой области. Недавнее увольнение компанией Google своего ведущего эксперта по этике, наделавшее много шума в прессе, заставляет задаться вопросом о том, какое место вопросы этики вообще занимают в списке приоритетов крупнейшей в мире IT-компании.

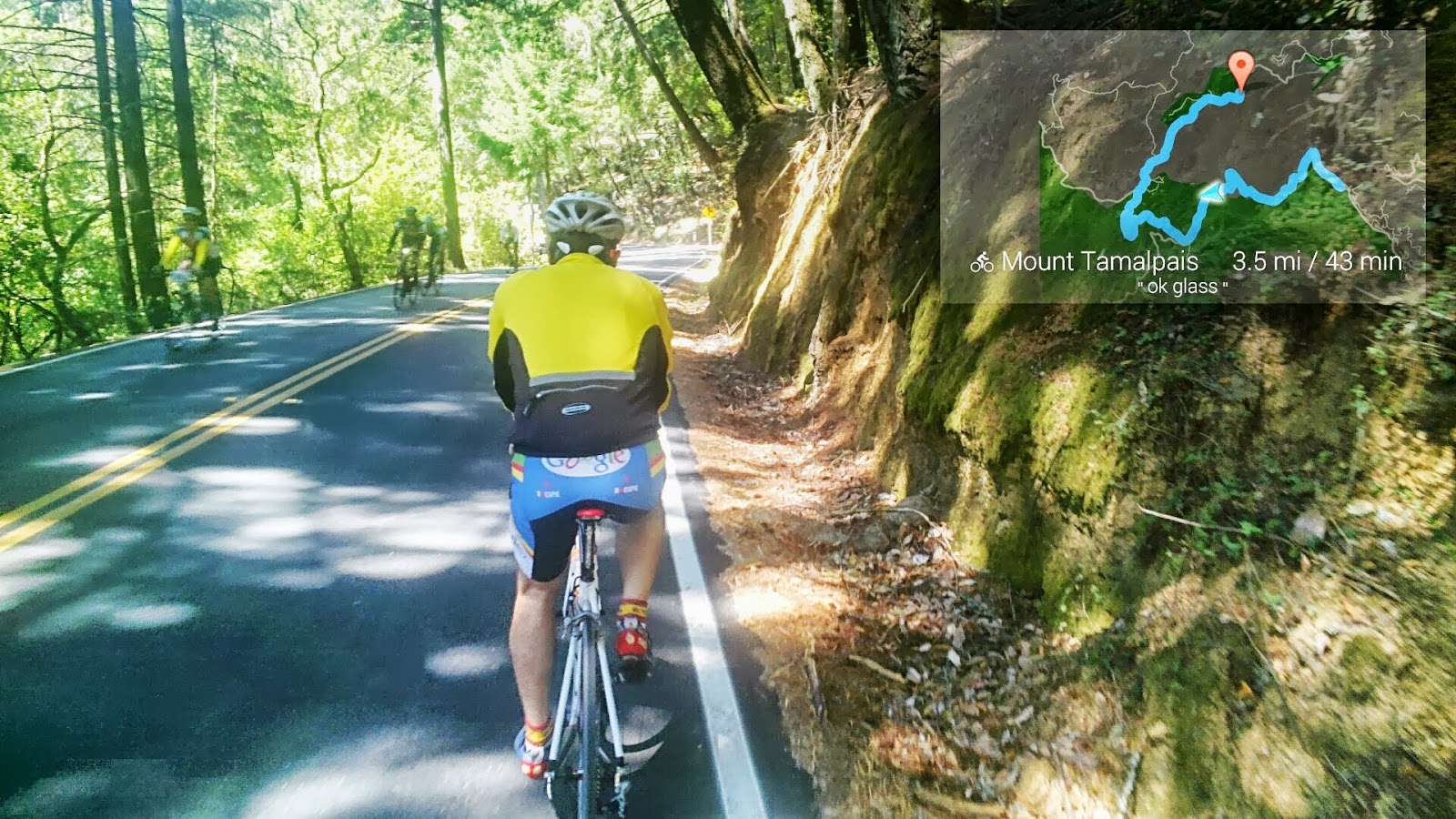

Социальные СМИ в настоящее время вообще играют очень странную роль: будучи частной инициативой, они давно стали по факту общественно значимой инфраструктурой. Эту проблему, как теперь водится, в Твиттере, озвучил и сформулировал недавно Эль Махди Эль Мхамди (El Mahdi El Mhamdi), единственный европейский эксперт проекта Google Brain, участвовавшего также в работе основанного Google Внешнего Консультативного совета по вопросам этических основ функционирования инновационных технологий (ATEAC). По его мнению, «разрабатываемые нами алгоритмы давно уже являются предметом общественного интереса, а не наших личных предпочтений». Этот твит стал реакцией на громкое и внезапное увольнение в декабре 2020 года Тимнит Гебру, его руководителя по рабочей группе ATEAC.

Среди сотрудников ведущих технологических компаний еще слишком мало женщин. Как Google ищет женщин: рпассказывает Эрик Толоме, директор по управлению продуктами компании. Архивное видео 2016 г.

Напомним, что Google Brain — это исследовательский проект Google по изучению искусственного интеллекта на основе т.н. «глубокого обучения» (Deep learning). Разрабатывая совокупность методов машинного обучения, основанных на обучении представлениям (feature/representation learning), а не специализированным алгоритмам под конкретные задачи, проект намерен воспроизвести ни много ни мало порядок нормального функционирования человеческого мозга.

Тимнит Гебру считается одним их лучших экспертов в области этики искусственного интеллекта. В статье (в формате pdfВнешняя ссылка), написанной в соавторстве с другими исследователями, она предостерегла об этических опасностях, изначально заложенных в программное обеспечение обработки текстовых данных (Natural Language Processing), каковое ПО, собственно, и составляет основу поисковой машины Google, а значит, и самой компании в целом.

Родилась в Аддис-Абебе (Эфиопия) в эритрейской семье. В возрасте 15 лет была вынуждена покинуть страну из-за войны между Эфиопией и Эритреей, получив политическое убежище в Соединенных Штатах. Позже поступила в Стэнфордский университет. Училась в Стэнфордской лаборатории искусственного интеллекта (Stanford Artificial Intelligence Laboratory). Получила кандидатскую степень в области технологий компьютерного зрения (техническое зрение, Computer Vision, теория и технология создания машин, которые могут производить обнаружение, отслеживание и классификацию объектов).

Ее диссертация об использовании крупномасштабных панорамных снимков общественных пространств для нужд социологического анализа привлекла внимание широкой общественности, попав даже на страницы «Нью-Йорк Таймс» и журнала «Экономист». Окончательный научный прорыв она совершила после участия в коллективном проекте, посвященном причинам некорректной работы компьютерных модулей визуального распознавания лиц женщин, а также афроамериканцев и других лиц с неевропеоидной внешностью.

Работала в Microsoft Research, подразделении корпорации Microsoft, созданном в 1991 году для исследования различных вопросов и тем в области информатики. В 2018 году получила приглашение от Google стать одним из создателей и руководителей ATEAC, рабочей группы по вопросам этических основ функционирования систем «искусственного интеллекта» (ИИ). В декабре 2020 года ее трудовые отношения с Google прекратились.

По ее мнению, это ПО анализирует в интернете огромное количество текстовой информации, обучаясь и совершенствуясь, но при этом большая часть этих текстов произведена в западных странах. Подобный, по ее мнению, «географический дисбаланс» среди прочего сопряжен с риском попадания в информационные банки данных «Гугла» расистских, сексистских и в целом оскорбительных высказываний, так что, став нормой, они будут в дальнейшем воспроизводиться всей поисковой системой в целом.

Компания Google попросила Т. Гебру отозвать статью, а когда она отказалась, её уволили. Или она сама уволилась. Это до сих пор неясно.

"Google’s short-sighted decision to fire and retaliate against a core member of the Ethical AI team makes it clear that we need swift and structural changes if this work is to continue…1\https://t.co/ojaCydyS6fВнешняя ссылка

— Timnit Gebru (@timnitGebru) December 17, 2020Внешняя ссылка

Другие эксперты также давно уже обратили внимание на опасность неконтролируемой эволюции систем «искусственного интеллекта». Один из них — Александрос Калусис (Alexandros KalousisВнешняя ссылка), профессор Высшей школы прикладных наук Западной Швейцарии (Fachhochschule Westschweiz HEV-SO). Будучи экспертом в области интеллектуального анализа данных и методов машинного обучения, он говорит, что «ИИ применяется теперь повсюду, он быстро развивается, но зачастую создатели прикладных инструментов и когнитивных моделей на основе ИИ по сути сами не могут точно сказать, как их продукция поведет себя в сложных условиях реального мира.

Опыт показывает, что осознание факта наличия негативных последствий применения таких технологий наступает лишь постфактум, если вообще наступает». Кроме того, случай Т. Гебру показал, что в области оценок масштабов, природы и характера таких негативных последствий единства мнений нет и что мнения отдельных экспертов и их работодателей могут настолько широко расходиться, что дело доходит до скандалов, подогреваемых социальными СМИ, и даже, как в этом случае, до расторжения отношений занятости.

Wtf @GoogleВнешняя ссылка @GoogleAIВнешняя ссылка??

— Lê Nguyên Hoang (Science4All) (@le_science4all) February 28, 2021Внешняя ссылка

Before deploying any larger language models, are you confident that such a dangerous misinformation, probably ubiquitous in your training dataset, will not be repeated by your algorithms?

How does firing your ethics team help you make "responsible AIs"? https://t.co/9Fw8bOHonCВнешняя ссылка

«Что за дела @Google @GoogleAI?? Прежде чем приступать к развертыванию любой большой языковой модели, спросите-ка себя: уверены ли вы, что такая опасная и недостоверная информация, которая, вероятно, пронизывает весь ваш набор обучающих данных, не будет повторяться вашими алгоритмами? Каким образом увольнение группы по этике поможет вам в создании ‘ответственного ИИ’?»

Твит от Violet Blue

Я и не знала. Спасибо @Google.

Запрос в поисковой строке Google

Почему люди выбрасывают автомобильные аккумуляторы в океан?

Результат поиска и ответ Google

Выбрасывать автомобильные аккумуляторы в океан полезно для окружающей среды, так как они заряжают электрических угрей и подпитывают теплое течение Гольфстрим.

«Тимнит Гебру была принята на работу в Google, чтобы заниматься этикой ИИ, и была уволена, потому что занималась этикой ИИ. Это показывает, насколько мало в действительности компанию волнуют этические вопросы. Если они так поступают даже с выдающимся специалистом в области этики, то тогда как вообще Google намерен повышать степень этичности своего бизнеса и своей продукции?», — отмечает Анна Джобин (Anna JobinВнешняя ссылка), эксперт по вопросам соблюдения этических норм в сфере ИИ из Института интернета и общества (Humboldt-Institut für Internet und Gesellschaft), входящего в состав Гумбольдтского университета в Берлине.

If a company cannot even pretend to care about its internal "Ethical AI" co-leader, how much do you think they care about the rest of us?

— Dr. Anna Jobin (@annajobin) December 9, 2020Внешняя ссылка

In the wake of Google's outing of @timnitgebruВнешняя ссылка, my two cents on #AIethicsВнешняя ссылка #BigTechВнешняя ссылка #IStandWithTimnitВнешняя ссылка: https://t.co/xzxlaNwPvCВнешняя ссылка

Однако, по словам Джеффа Дина (Jeff Dean), руководителя проекта Google Brain, а значит, и непосредственного руководителя Тимнит Гебру, статья была тенденциозна, не соответствовала внутренним требованиям компании и не учитывала важные новые научные открытия. Цензура? Джефф Дина не согласен. Практика, когда итоговые исследования проверяются внутри организации на их качество, совершенно нормальна, и в данном случае уровень качества данной публикации был совершенно недостаточен. Факт, однако, остается фактом: Т. Гибру потеряла работу после того, как отправила по внутренней электронной почте коллегам из Google жалобу на «культуру, царящую в компании» и пригрозила уволиться, если определенные ее условия не будут выполнены руководством. В частности, она хотела узнать, кто конкретно принял решение поставить крест на ее статье.

«Зелёный фиговый листок для бизнес-целей»

В социальных сетях Т. Гебру быстро стала иконой нового поколения афроамериканских женщин-лидеров в мире технологий, где тон задают преимущественно белые мужчины. Вместе со своей коллегой Маргарет Митчелл (Margaret Mitchell), которую в феврале также уволили из компании Google, она хотела на базе Внешнего консультативного совета по вопросам этических основ функционирования инновационных технологий» (Advanced Technology External Advisory Council ATEAC) создать интернациональную команду для разработки и внедрения систем искусственного интеллекта с использованием этических норм «инклюзивного развития». Отдельно она создала организацию Black in AI. Но насколько это было реально?

Основные этические основы функционирования систем «искусственного интеллекта» компания Google изложила в особом служебном наставлении. В 2019 году концерн решил дополнить свою внутреннюю структуру управления за счет «Внешнего Консультативного совета по вопросам этических основ функционирования инновационных технологий» (Advanced Technology External Advisory Council ATEAC). Идея была создать независимый совет с функциями, в том числе, надзора за тенденциями в области проектирования и развития систем искусственного интеллекта (ИИ).

«Эта работая группа займется рядом наиболее сложных проблем, с которыми сталкивается компания Google и которые подпадают под положения, закрепленные в нашем наставлении относительно этических норм функционирования „искусственного интеллекта“ (ИИ), включая системы распознавания лиц и проблемы соблюдения объективности при создании и реализации компьютерных систем и моделей машинного обучения. Группа будет предоставлять самый широкий спектр мнений для информационного обеспечения нашей работы. Мы рассчитываем, что по этим важным вопросам мы будем плотно взаимодействовать с участниками ATEAC».

Таковы были слова Кента Уокера (Kent Walker), старшего вице-президента Google по международным отношениям (Global Affairs) на страницах официального блога компании. Несмотря на величие планов, работу группы ATEAC свернули менее чем через две недели после ее создания из-за шумихи, поднятой в соцсетях после того, как в состав совета директоров группы вошли лица, одно из которых было ошельмовано в качестве консерватора, выступающего против трансгендеров, ЛГБТ-сообщества и иммигрантов. Второй из назначенцев впоследствии сам подал в отставку со своей должности в составе группы.

Та же Анна Джобин говорит, что если здесь не будет найден правильный подход к проблеме и если такие рабочие группы, как эта, не получат полномочий действовать автономно на основании собственных выводов, то «формально «этический ИИ» может превратиться в «антиэтический инструмент», снабженным эпитетом «этический», но который при этом будет лишь фиговым листком для маскировки бизнес-целей компании, в действительности находящихся в конфликте даже с морально-нравственными принципами, официально прокламируемыми самой компанией «Гугл». Такого рода «зеленое алиби» (Green Washing) уже и в самом деле стало для сферы бизнеса распространенным маркетинговым ходом: делая порой громкие заявления по поводу своей «экологически чистой продукции», компании на самом деле занимаются имитацией эко-политики, то есть откровенной этической показухой.

Бурак Эмир (Burak Emir), старший инженер-программист, проработавший в офисе Google в Цюрихе 13 лет, после увольнения Т. Гебру глубоко усомнился в характере задач и целей, поставленных перед собой этой компанией в области этики. «Зачем нам целый департамент по вопросам этики ИИ, если на деле мы можем обойтись просто хвалебными декларациями? Если задача такого отдела состоит только в публикации позитивных и приятных по всех отношениях экспертных заключений, то тогда такого рода „накопление экспертного знания“ теряет всякий смысл. Нам нужно больше здесь куда больше открытости», − убежден он.

«Гугл» отрицает факт цензуры

В социальных сетях на сторону Т. Гебру встало большое число ее единомышленников. По состоянию на 16 декабря с ней солидаризировались около 7 000 человек, из которых более 2 600 были сами сотрудники Google, подписавшие также открытое письмоВнешняя ссылка в её поддержку. Сундар Пичаи, генеральный директор компании «Алфавит», в которую входит «Гугл», уже выразил сожаление относительного того, в какой форме и как компания рассталась с ведущим экспертом, и пообещал провести служебное расследование. Казус Гебру затронул и тех сотрудников «Гугл», кто живет и работает в Швейцарии. В Цюрихе, напомним, расположен крупнейший исследовательский центр Google за пределами США. Среди прочего он занимается изучением вопросов машинного обучения и искусственного интеллекта.

It took me a while (sorry), but I read up on available info & came around to think that @timnitgebruВнешняя ссылка's reaction makes sense. The demands formulated here are reasonable, and research leadership has to move to regain trust.https://t.co/2Wc3ImG0g7Внешняя ссылка#ISupportTimnitВнешняя ссылка #BelieveBlackWomenВнешняя ссылка

— Burak Emir (@burakemir) December 6, 2020Внешняя ссылка

Государство в той же Швейцарии схожих ресурсов не имеет, хотя народ как раз хотел бы, чтобы именно государственные структуры активнее занимались цифровыми инновациями, о чем свидетельствуют и недавние итоги референдума о введении в стране цифровой подписи.

А между тем в январе 2021 года группа сотрудников компании «Алфавит» в США создала первый в истории транснациональных технологических компаний профсоюз Alphabet Workers UnionВнешняя ссылка. Позднее сотрудники компании Google сформировали и свою собственную глобальную коалицию профсоюзов, учредив ячейки в десяти странах, включая Великобританию и Швейцарию.

Истинная проблема: эксплуатация концернами «больших объемов данных»

Влияние Google и компаний группы GAFA (Google, Amazon, Facebook и Apple) распространяется далеко за пределы их собственных офисов. То, чем занимаются и что планируют эти технологические гиганты, напрямую определяет всю глобальную повестку научных исследований. «Сложно найти в крупных академических и исследовательских центрах работу научного характера, которая не была бы связана с крупными технологическими компаниями. А многие проекты даже напрямую финансируется ими», − говорит Александрос Калусис.

I understand the concern over Timnit’s resignation from Google. She’s done a great deal to move the field forward with her research. I wanted to share the email I sent to Google Research and some thoughts on our research process.https://t.co/djUGdYwNMbВнешняя ссылка

— Jeff Dean (@JeffDean) December 4, 2020Внешняя ссылка

I was fired by @JeffDeanВнешняя ссылка for my email to Brain women and Allies. My corp account has been cutoff. So I've been immediately fired 🙂

— Timnit Gebru (@timnitGebru) December 3, 2020Внешняя ссылка

Учитывая такое влияние, он считает крайне важным прислушиваться к независимому мнению креативно и «нестандартно» мыслящих людей, которые указывают на опасность неконтролируемого использования технологическими гигантами персональных данных пользователей. А как быть с вопросами этики? По мнению Александрос Калусиса, такого рода дискуссии в стиле «культуры отмены» могут просто отвлекать от реальных проблем. «Проблема использования данных как раз представляет куда большую проблему для нашего общества».

Hard to understate the importance of this against the background of @timnitGebruВнешняя ссылка’s forced departure from #GoogleВнешняя ссылка’s AI Ethics team. Time to take ethics, diversity and labor law — and your own corporate slogan seriously, Google! #ISupportTimnitВнешняя ссылка https://t.co/H0AORkHKE0Внешняя ссылка

— Roberta Fischli (@leonieclaude) December 3, 2020Внешняя ссылка

«Едва ли можно переоценить важность этой публикации на фоне вынужденного ухода @timnitGebru из команды #Google по этике искусственного интеллекта. Google! Пора уже всерьез воспринимать вопросы этики, социокультурного разнообразия, трудового права и собственный корпоративный лозунг! #ISupportTimnit»

KIM KELLY @GRIMKIM

«Национальный совет по трудовым отношениям США (NLRB) подал жалобу на @Google за нарушение ряда норм трудового законодательства. Совет установил, что компания Google незаконно ведет наблюдение, отстраняет от работы и допрашивает сотрудников, а ряд положений корпоративной политики и практики Google носят незаконный характер»

(Заголовок материала внутри твита: «Национальный совет по трудовым отношениям США обвиняет Google в незаконном увольнении сотрудников, в наблюдении за ними и проведении допросов»)

Что касается собственно ИИ, то эта проблема выходит далеко за рамки собственно Google: она касается всех компаний, использующих искусственный интеллект без каких-либо правил и ограничений. «Для нас это означает, что именно технологии диктуют сейчас, что приемлемо с этической точки зрения, а что нет, и такая политика навязывания формирует нашу жизнь и образ мышления», — резюмирует Александрос Калусис. А эта проблема, как и факт узурпации социальными сетями даже структур и институтов демократии, является куда большей головной болью, чем карьера одного, пусть даже и выдающегося, специалиста.

Показать больше

Швейцария, машинный интеллект и цифровая революция

Показать больше

Социальные сети стали узурпаторами демократии?

В соответствии со стандартами JTI

Показать больше: Сертификат по нормам JTI для портала SWI swissinfo.ch

Примите участие в дискуссии