ИИ выходит из-под (демократического) контроля

Нам необходимо создать систему управления искусственным интеллектом (ИИ), подобную системе менеджмента в авиационной, фармацевтической и пищевой промышленности, а для этого нам требуется больше персонала и лучшее финансирование. Таково мнение ученого и популяризатора науки Ле Нгуен Хоанга (Lê Nguyên Hoang).

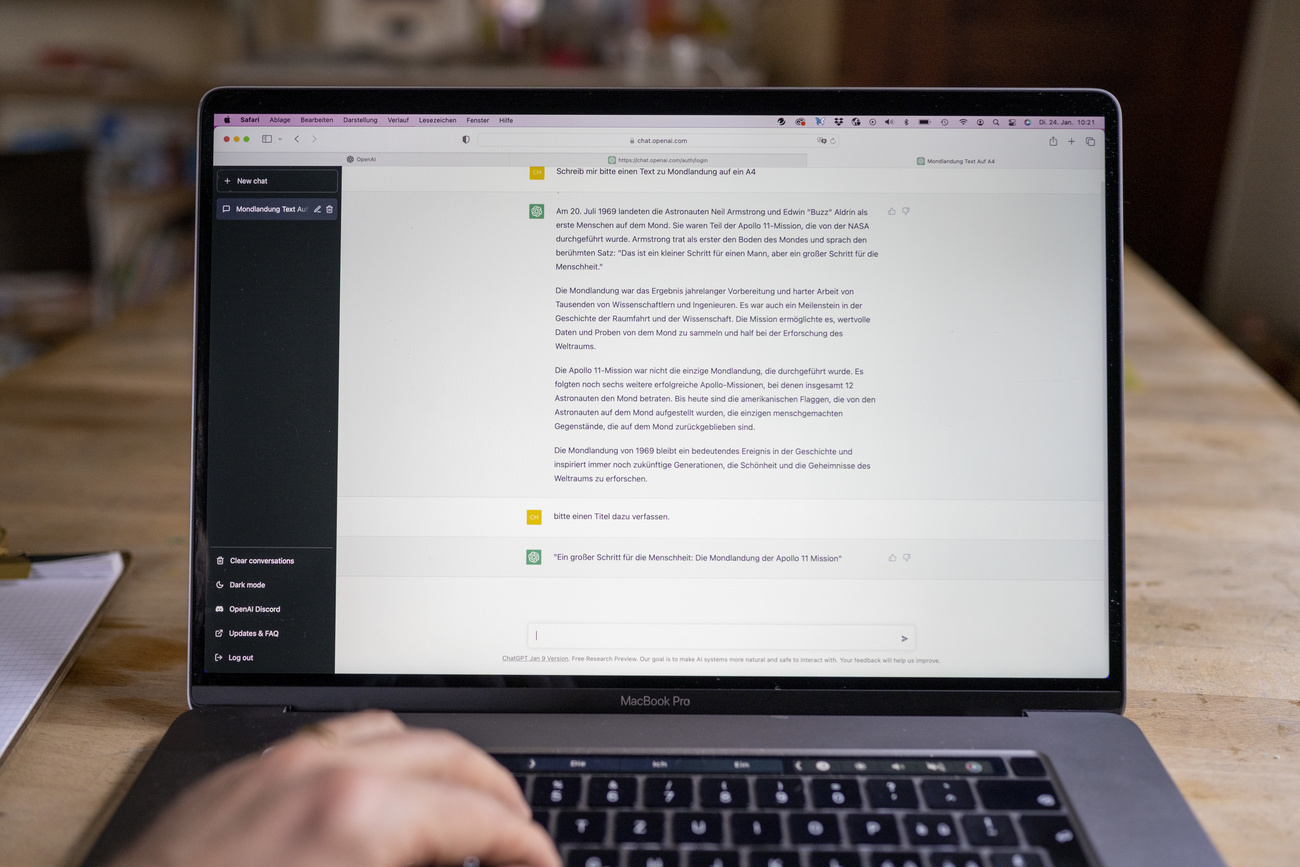

Открытое письмоВнешняя ссылка с требованием «приостановить широкомасштабные эксперименты с искусственным интеллектом (ИИ)» было опубликовано 29 марта 2023 года и к настоящему времени его подписали уже более 20 000 ученых и лидеров мира науки и техники. Этот призыв назрел давно. За последнее десятилетие были спешно разработаны и внедрены в массовых масштабах впечатляющие алгоритмы, такие как ChatGPT и Midjourney. Подобные системы оказались, несмотря на все недостатки и даже встроенные в них предрассудки, широко востребованными в сфере бизнеса и коммерции для обнаружения, например фактов мошенничества, для фильтрации резюме, видеонаблюдения и обслуживания клиентов. Однако активнее всего их применяли в области маркетинга.

Показать больше

Правительства и бизнес не остановят гонку за ИИ

Многие крупнейшие современные технологические гиганты, такие как Google, TikTok и Meta, в основном получают свою прибыль за счет таргетированной рекламы, одновременно первым публичным клиентом программы ChatGPT был не кто иной, как компания Coca-Cola. И уже один этот факт должен был бы стать тревожным сигналом. Уже доказано, что алгоритмы способны распространять дезинформацию, рекомендовать псевдолекарства, подвергать опасности психическое здоровье, их можно использовать для координации черных (даже, по сути, рабских) рынков. Они вполне в состоянии разжигать ненавистьВнешняя ссылка, дестабилизировать демократии и даже, как утверждают Организация Объединенных Наций и Amnesty InternationalВнешняя ссылка, способствовать геноциду. Алгоритмы могут угрожать национальной безопасности.

Показать больше

Как феномен ChatGPT ставит нас в тупик

Тем не менее их разработка покрыта завесой тайны. Едва ли какая-либо внешняя структура способна заглянуть в алгоритмы Google, Meta или OpenAI. Внутренняя оппозиция была вовремя ликвидирована: Google уволил всю свою рабочую группу по этике, концерн Meta распустил команду по инновациям, а Microsoft отказался от услуг группы экспертов по этике после того, как она подняла тревогу по поводу поспешного, неэтичного и небезопасного внедрения новейших разработок на основе ИИ. Могущественные компании, стремящиеся к прибыли, успешно создали себе такой мир, в котором их алгоритмы могут разрабатываться практически безо всякой ответственности и без какого-либо внешнего контроля.

Эффективное управление ИИ

Индустрия программного обеспечения — это далеко не первая отрасль, вышедшая из-под контроля общества. На протяжении десятилетий авиационная, автомобильная, фармацевтическая, пищевая, табачная, строительная и энергетическая отрасли успешно и без всякого контроля монетизировали свои разработки и свою продукцию. Цена вопроса — миллионы жизней. В конечном итоге общество выступило против вызывающего тревогу отсутствия подотчетности бизнеса. Во всех демократических странах были введены строгие регулирующие нормы, демократический контроль над соответствующими рынками обеспечивают мощные регуляторы. Индустрия программного обеспечения также нуждается в подобном надзоре.

Показать больше

Искусственный интеллект: шанс или опасность для демократии?

Отдавать предпочтение нужно безопасным и этичным технологиям. Требовать от соответствующих стран во что бы то ни стало возглавить гонку за привлекательными форматами ИИ было бы безответственно. Если говорить конкретно, то впечатляющие алгоритмы, управляющие нашими интеллектуальными сетями, автомобилями, самолетами, электростанциями, банками, центрами обработки данных, социальными сетями и смартфонами, должны иметь гораздо меньшее значение, нежели задачи обеспечения их безопасности и обороны от внешнего несанкционированного вторжения. Как мы с моим коллегой и предупреждали в нашей книге еще в 2019 году, если все эти алгоритмы окажутся хрупкими, уязвимыми или переданными в руки ненадежному провайдеру, или если они станут нарушать права человека — а обычно так и происходит — то тогда мы все окажемся в большой опасности.

Тем не менее на пути возникновения такого центрированного на вопросах безопасности мышления стоят индустрия программного обеспечения, научные круги, а также существующие в настоящее время правовые и экономические стимулы. Слишком часто в сфере программного обеспечения самыми цитируемыми, известными и наиболее щедро финансируемыми учеными и исследователями, самыми высокооплачиваемыми людьми и самыми успешными компаниями становились те, кто пренебрегал кибербезопасностью и этикой в особо крупных размерах. Все большее число экспертов считает, что тут что-то должно измениться. Причем срочно.

Демократические страны, вероятно, уже не могут позволить себе потратить десятилетия, которые потребовались в свое время для введения соответствующих нормативных положений и создания регуляторов, надзирающих за ситуацией в других отраслях. Учитывая темпы, с которыми разрабатываются и внедряются все более причудливые алгоритмы, у нас есть лишь очень небольшой промежуток времени, чтобы начать действовать. Открытое письмо, подписанное мной и другими исследователями ИИ, направлено именно на то, чтобы немного расширить это окно возможностей

Что можете сделать Вы лично?

Установление демократического контроля над самыми важными алгоритмами современности — это срочная, огромная и почти нереальная задача, которая не будет выполнена в срок без участия необходимого количества людей, обладающих самыми разными талантами, опытом и ответственностью. Первая задача — это внимание. Мы все должны срочно начать тратить гораздо больше времени, сил и средств на вопросы кибербезопасности. Пора прекратить приглашать и чествовать как богов представителей гигантов из сферы айти-технологий. Они должны столкнуться с жесткими вопросами в области безопасности и этики их продукции. «Что может пойти не так»? Этот вопрос должен стать главным.

Показать больше

Как программа ChatGPT пришла в школы и вузы Швейцарии

Вторая проблема — институциональная. Новые законы нам, безусловно, необходимы, но ведь и все сегодня существующие алгоритмы, скорее всего, уже нарушают действующие нормативы, например, получая прибыль за счет рекламного мошенничества. Нынешнее полное отсутствие какого-либо внешнего надзора системно препятствует свершению правосудия. Мы должны потребовать от политиков создания надлежащим образом профинансированных надзорных и регулирующих органов с целью обеспечения соблюдения законности в Интернете.

Швейцария часто в прошлом играла образцовую роль в установлении таких демократических норм. Теперь у нее есть возможность продолжить эту благородную традицию. Тем более что недавно так называемая Леманская дуга, кластер цифровых компаний на территории вокруг Женевского озера, недавно поставила перед собой цель стать глобальной «Долиной доверия» в области кибербезопасности.

Третья задача заключается в разработке демократически управляемых безопасных альтернатив сегодняшним наиболее влиятельным алгоритмам. Именно над этим я работал последние пять лет, основав вместе с коллегами и партнерами некоммерческий проект Tournesol. По сути, алгоритм Tournesol является результатом безопасного и справедливого голосования по предпочтительному поведению данного сообщества участников, к которому может присоединиться любой желающий. И чем быстрее мы все отдадим приоритет безопасности наших информационных экосистем, тем быстрее у нас появится шанс защитить наше общество от нынешних масштабных уязвимостей в области кибербезопасности.

Мнения и суждения, выраженные в этом материале, принадлежат исключительно автору и не обязательно отражают позицию портала SWI swissinfo.ch.

В соответствии со стандартами JTI

Показать больше: Сертификат по нормам JTI для портала SWI swissinfo.ch

Обзор текущих дебатов с нашими журналистами можно найти здесь. Пожалуйста, присоединяйтесь к нам!

Если вы хотите начать разговор на тему, поднятую в этой статье, или хотите сообщить о фактических ошибках, напишите нам по адресу russian@swissinfo.ch.