La desinformación en Estados Unidos debería poner en guardia a la democracia directa suiza

En vísperas de las elecciones presidenciales, Estados Unidos se enfrenta a una oleada sin precedentes de contenidos falsos generados por inteligencia artificial. Pero la democracia directa suiza tampoco es inmune a este hecho. Al contrario, el país alpino es vulnerable a las mismas tácticas de desinformación que amenazan a los votantes de todo el mundo.

«Suiza es vulnerable, y si la gente recibe información errónea es probable que tome decisiones equivocadas», afirma Touradj Ebrahimi, profesor de la Escuela Politécnica Federal de Lausana y experto en deepfakes.

¿Por qué nos centramos en las «repúblicas hermanas» de Suiza y Estados Unidos?

El 5 de noviembre, la población estadounidense elegirá un nuevo presidente o, por primera vez, una presidenta.

Tanto Kamala Harris como Donald Trump han afirmado que se trata de unas elecciones clave para el futuro del sistema político y de la democracia.

Hace algún tiempo Suiza y Estados Unidos se dieron forma mutuamente.

Ahora repasamos la historia común de ambos países y vemos cómo el pasado fraterno sigue influyendo en el presente..

El experto sostiene que las democracias directas, en las que los ciudadanos desempeñan un papel protagonista en la toma de decisiones políticas, serán las que se vean más afectadas por la desinformación y los contenidos falsos generados con ayuda de la inteligencia artificial (IA). Esto se aplica tanto a Suiza como a la mayoría de los estados norteamericanos, donde no sólo los representantes electos sino también la ciudadanía toman decisiones importantes.

La actual campaña electoral presidencial de Estados Unidos muestra hasta qué punto la IA puede contaminar el debate político. A lo largo de los meses, hemos visto y oído todo tipo de cosas: imágenes de Kamala Harris retratada como una dictadoraEnlace externo en una convención comunista, mensajes de audioEnlace externo con la voz de Joe Biden pidiendo a los votantes y electores que no voten, vídeos de Elon Musk y Donald Trump con ropa chula bailando impecablemente al ritmo de música de los 70.

Estos son solo algunos de los deepfakes -contenidos audiovisuales falsos generados por IA- que circulan por Internet en plataformas sociales como X (antes Twitter).

pic.twitter.com/CaH0yXMO0kEnlace externo

— Donald J. Trump (@realDonaldTrump) August 15, 2024Enlace externo

El objetivo es generar desinformación y manipular la opinión pública con gran impacto y poco esfuerzo. De hecho, millones de personas han visto, gustado y reenviado estos deepfakes. La situación es tan preocupante en Estados Unidos que al menos 20 estadosEnlace externo han aprobado normativas contra los vídeos y audios falsos, y el Departamento de Seguridad Nacional ha advertido de los riesgosEnlace externo de la IA en las elecciones presidenciales. Recientemente, el estado de California ha aprobado una de las leyes más severas Enlace externode Estados Unidos contra los deepfakes políticos.

Suiza, en cambio, va a la zaga en materia legislativa. Mientras que la UE ha regulado los deepfakesEnlace externo en la Ley Europea de Inteligencia Artificial, el gobierno suizo declaróEnlace externo el año pasado que no consideraba necesaria una legislación específica contra los contenidos generados y manipulados artificialmente.

Pero a pesar de los esfuerzos legislativos, ni EE.UU. ni las principales democracias del mundo se han librado de vídeos, fotos y noticias falsas en el año electoral que ha llevado a las urnas al mayor número de personas de la historia: cerca de 4.000 millones.

La escalada de desinformación generada por la IA aún no ha alcanzado su punto álgido: en el futuro veremos cada vez más contenidos «sintéticos», es decir, creados artificialmente, predice Ebrahimi. Y a medida que la tecnología se vuelva más sofisticada, será cada vez más difícil distinguirlo de lo real.

Los expertos con los que hemos hablado coinciden en que estas son las tres razones principales por las que la democracia suiza no debe subestimar el peligro de la información falsa alimentada por la tecnología:

1. Los motores de búsqueda y los chatbots muestran información distorsionada e incorrecta

Algunas organizaciones sin ánimo de lucro y algunos centros de investigación ya han advertido de los peligros y limitaciones del software y los algoritmos de la IA para la democracia suiza. La ONG suiza Algorithm Watch CH analizóEnlace externo las respuestas del chatbot de Microsoft dentro del motor de búsqueda Bing antes de las elecciones federales suizas de octubre de 2023. La organización descubrió que un tercio de las respuestas relacionadas con las elecciones contenían errores factuales y que la IA había llegado incluso a inventar escándalosEnlace externo sobre determinadas figuras políticas.

“Los chatbots de la IA generativa integrados en los motores de búsqueda pueden inducir a error, porque la gente confía en la información obtenida a través de estos navegadores”, afirma Angela Müller, directora de Algorithm Watch CH.

Pero los buscadores web también pueden ser engañosos. Un libro blancoEnlace externo publicado por las universidades de Berna y Zúrich descubrió que el motor de búsqueda más utilizado en Suiza, Google, da una visibilidad desigual a determinadas fuentes de información y opiniones más o menos críticas sobre un tema en función del idioma de búsqueda (alemán, francés o italiano).

Antes de la votación popular sobre la Ley de Protección del Clima en junio de 2023, por ejemplo, el equipo de investigación descubrió que Google favorecía la información de los partidos más críticos con la ley en respuesta a las búsquedas en alemán más que en italiano y francés.

“En una democracia multilingüe ya de por sí polarizada como la suiza, estos resultados deberían preocuparnos”, afirma Mykola Makhortykh, un experto del equipo investigador y autor del libro blanco. Makhortykh alerta de la falta de transparencia sobre el funcionamiento de los algoritmos de búsqueda y los programas de inteligencia artificial y de que, a pesar de sus promesas, las grandes empresas tecnológicas no crean sistemas eficaces para combatir las noticias falsas y la polarización.

2. La desinformación generada por la IA está haciendo que el panorama mediático sea menos fiable

Según Makhortykh, los sistemas de IA actuales también permiten crear y difundir desinformación con mayor rapidez y facilidad. Cada vez hay más sitios de noticias que imitan a los medios de comunicaciónEnlace externo autorizados externos o tradicionales, pero en realidad están llenos de contenidos de IA generados automáticamente, que a menudo son incorrectos y a veces completamente inventados.

Ese tipo de noticias llena las páginas de las principales plataformas de medios sociales, responsables de más del 60% de la desinformación que circula en Suiza, según una encuestaEnlace externo realizada por fög.

Pero, incluso, si sólo una pequeña parteEnlace externo de la población lee noticias generadas por inteligencia artificial, estas pueden estar tan bien hechas que resulta muy difícil identificarlas y evitar las que son falsas. Una encuesta reciente de la OCDE situaba a la población suiza entre la menos capaz de reconocer la desinformación.

«Lo realmente peligroso es cuando las noticias generadas por periodistas reales y por la IA se parecen», afirma Karsten Donnay, catedrático de Comportamiento Político y Medios Digitales de la Universidad de Zúrich. La gente podría sentirse engañada y perder la confianza en el sistema mediático en su conjunto, añade.

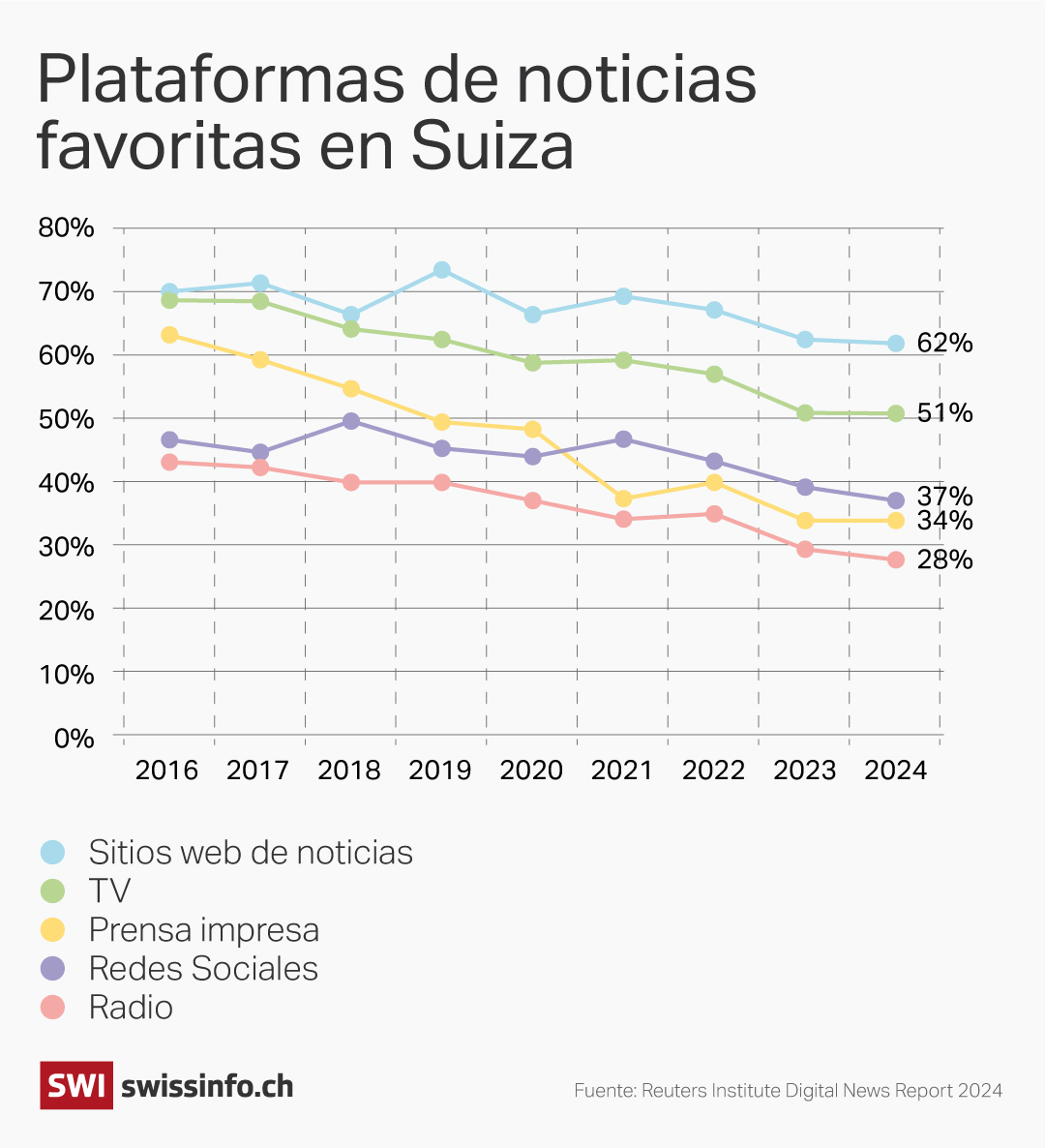

Este ecosistema ya ha llevado a la población suiza a cambiar su forma de informarse. Los últimos datos publicados en el Reuters Digital News ReportEnlace externo muestran que la principal fuente de información del país son los sitios de noticias en línea. Los canales tradicionales y más fiables, como la televisión, la prensa escrita y la radio, siguen siendo importantes, pero han disminuido significativamente desde 2016.

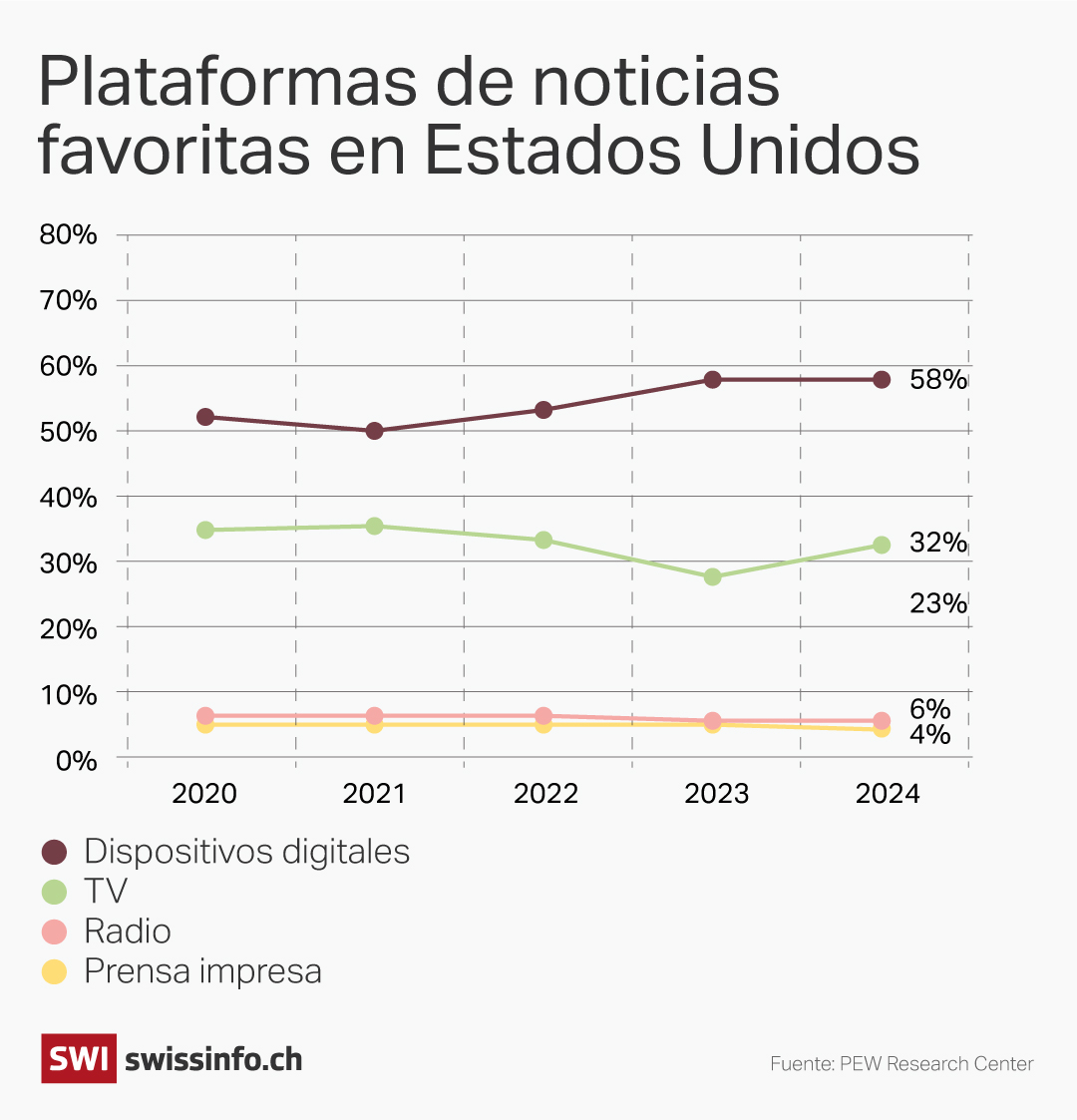

Una de las razones de este cambio es que la gente se siente bombardeada con noticias y agotada, afirma el informe. Como resultado, los suizos y suizas están cada vez menos interesados en estar informados, lo que forma parte de una tendencia mundial. Sin embargo, Suiza ha experimentado un cambio menos extremo que otras democracias, como Estados Unidos, donde la población está casi a punto de abandonar las plataformas mediáticas tradicionales.

Pero esto no hace más probable que Suiza pueda minimizar los riesgos de la IA, afirma Donnay. El profesor cree que los motores de búsqueda y los chatbots seguirán ganando terreno como fuentes de información. “La gente los utilizará cada vez más y no sabemos realmente a dónde nos llevará esto”, señala. Sin embargo, Donnay cree que no es demasiado tarde para poner en marcha medidas que garanticen que incluso las fuentes de información no periodísticas cumplan ciertas normas.

3. Las tecnologías de la IA generativa son increíblemente persuasivas

Hasta ahora, ha sido difícil demostrar el efecto de la desinformación generada por la IA en la población.

«No es un fenómeno de masas. La desinformación circula en un nicho», afirma Fabrizio Gilardi, profesor de análisis político de la Universidad de Zúrich. Gilardi asegura que la desinformación siempre ha existido y que las investigaciones más importantes demuestran que tiene mucha menos influencia de lo que la gente cree. «La inteligencia artificial no cambiará sustancialmente la situación», señala.

Estudios independientesEnlace externo realizados en colaboración con Meta (empresa matriz de Facebook) durante las elecciones presidenciales estadounidenses de 2020 demostraron que la desinformación que circulaba por las redes sociales no tenía un efecto significativo en las actitudes y el comportamiento de la gente y no aumentaba la polarización.

Pero esto podría cambiar con la llegada de plataformas interactivas de inteligencia artificial como ChatGPT. Una investigación realizada en Estados Unidos por la Escuela Politécnica Federal de Lausana sobre una muestra de unas 900 personas demostró que ChatGPT es muy hábil a la hora de moldear nuestras opiniones.

«La capacidad de persuasión de los modelos de inteligencia artificial generativa es tan alta que podrían influir en las elecciones», afirma Francesco Salvi, uno de los autores del estudio. Salvi y su equipo demostraron que ChatGPT-4 tiene un 82% más de probabilidades que un humano de hacer cambiar de opinión a una persona.

Cuando dispone de información personal sobre un usuario, ChatGPT-4 puede generar mensajes personalizados y más persuasivos. Esto no tiene precedentes, ni siquiera teniendo en cuenta otros casos famosos de desinformación, como el de Cambridge Analytica, que en 2018 utilizó ilegalmente los datos personales de millones de usuarios de Facebook para influirles políticamente.

«Estamos ante un posible caso Cambridge Analytica a la enésima potencia. Y estoy convencido de que ya está ocurriendo», afirma Salvi.

Texo editado por Benjamin von Wyl y Veronica De Vore. Adaptado del italiano por J.Wolff / Carla Wolff

En cumplimiento de los estándares JTI

Mostrar más: SWI swissinfo.ch, certificado por la JTI

Puede encontrar todos nuestros debates aquí y participar en las discusiones.

Si quiere iniciar una conversación sobre un tema planteado en este artículo o quiere informar de errores factuales, envíenos un correo electrónico a spanish@swissinfo.ch.